针对视频智能的多模态模型微调

Mux Blog - Video technology and more

·

AI论文评审:通过生成预训练(GPT-1)提升语言理解

freeCodeCamp.org

·

近思录 2026-04-02

M-x Chris-An-Emacser

·

在线教程丨低门槛部署英伟达最新Physical AI模型,覆盖人形机器人/人体运动生成/扩散模型微调等

HyperAI超神经

·

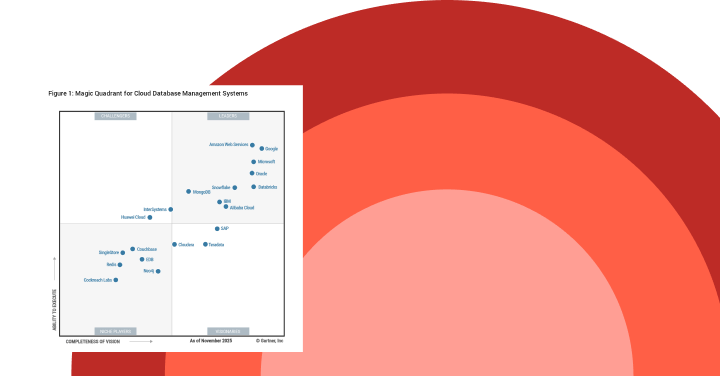

推出AI Runtime:在Databricks上可扩展的无服务器NVIDIA GPU用于训练和微调

Databricks

·

12小时掌握大型语言模型的微调技巧

freeCodeCamp.org

·

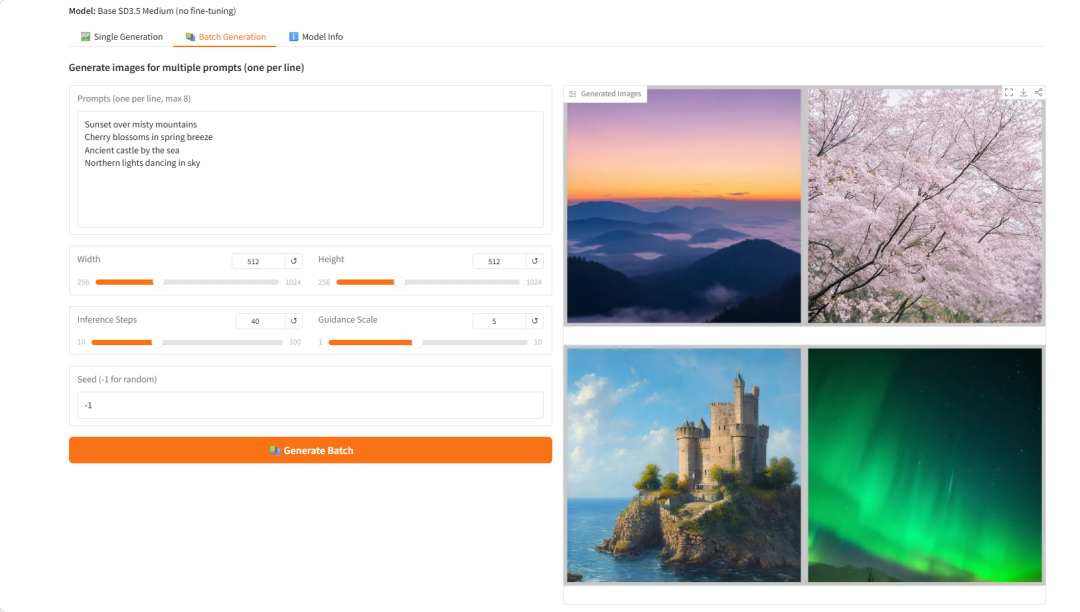

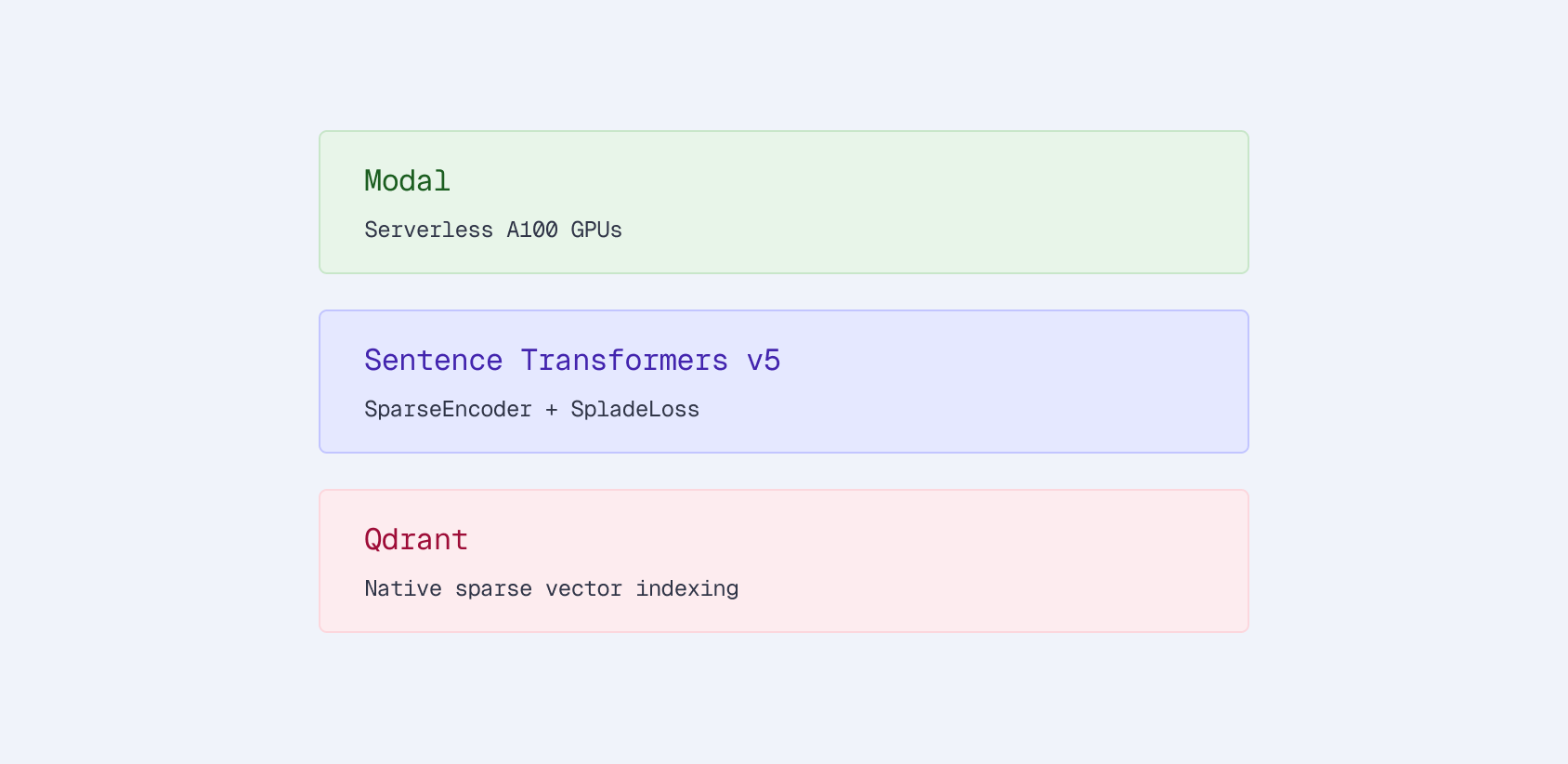

电子商务搜索中的稀疏嵌入微调 | 第二部分:在Modal上训练SPLADE

Qdrant - Vector Database

·

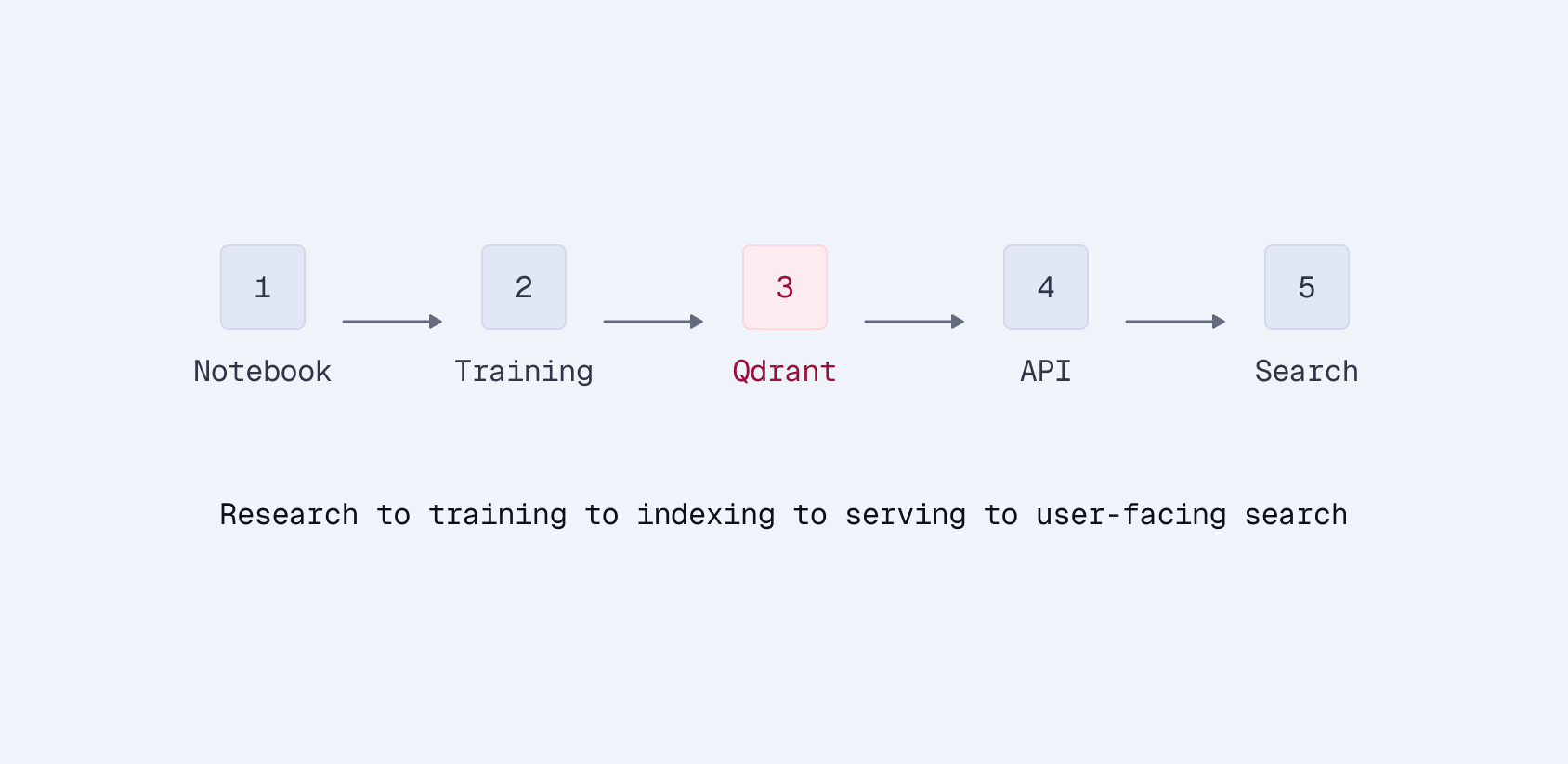

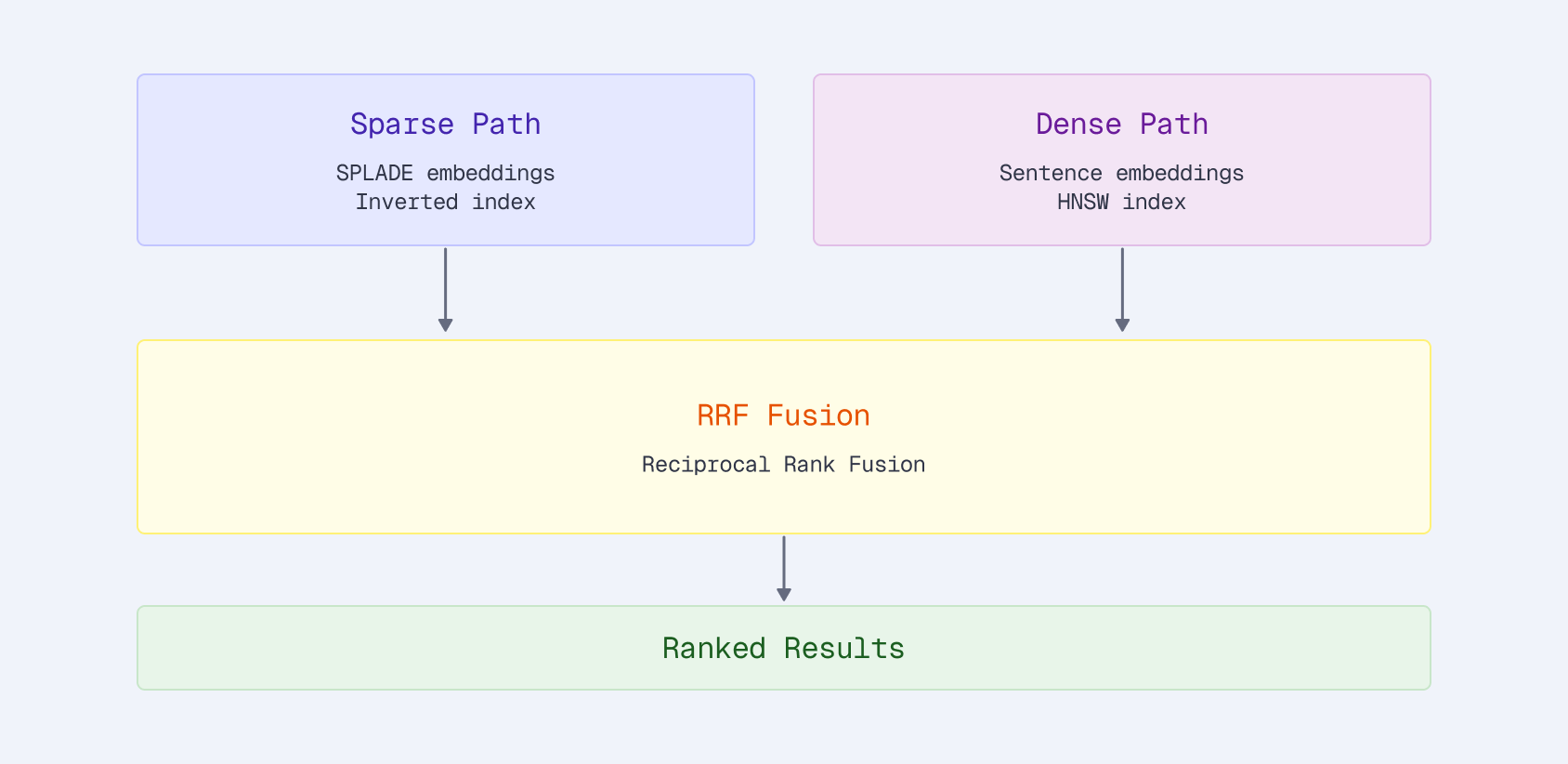

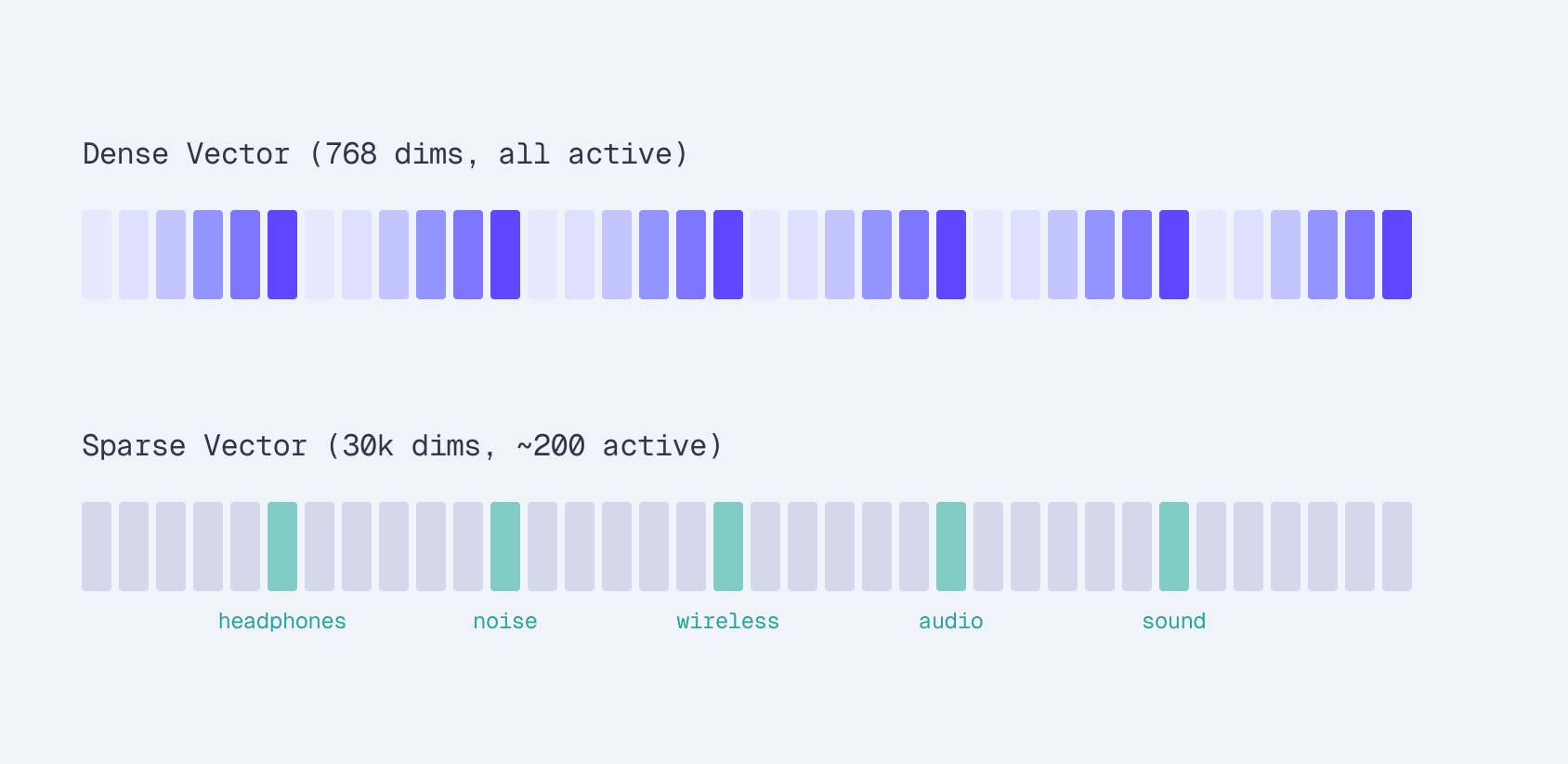

电子商务搜索中的稀疏嵌入微调 | 第5部分:从研究到产品

Qdrant - Vector Database

·

电子商务搜索中的稀疏嵌入微调 | 第3部分:评估与困难负样本

Qdrant - Vector Database

·

电子商务搜索中的稀疏嵌入微调 | 第1部分:稀疏嵌入为何优于BM25

Qdrant - Vector Database

·