💡

原文中文,约4700字,阅读约需12分钟。

📝

内容提要

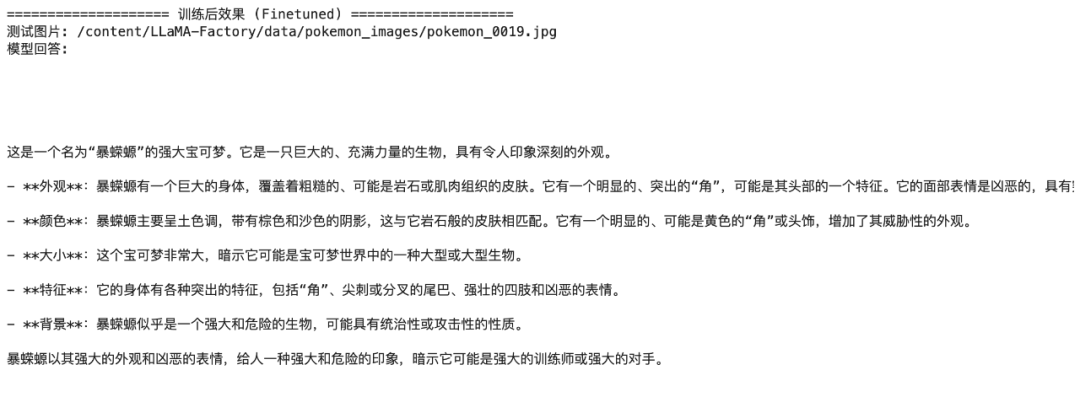

文心大模型与LLaMA-Factory合作,支持ERNIE-4.5模型的微调。用户可通过简化流程和4-bit量化训练快速完成微调。案例展示了宝可梦角色识别任务,训练效果显著提升,模型适应性增强。

🎯

关键要点

- 文心大模型与LLaMA-Factory达成生态合作,支持ERNIE-4.5模型微调。

- LLaMA-Factory是一个高效、易用的大型语言模型训练与微调框架。

- 用户可通过简化流程和4-bit量化训练快速完成微调。

- 案例展示了宝可梦角色识别任务,训练效果显著提升。

- 微调过程中,GPU显存占用被压缩至约20GB,前50个宝可梦数据集全流程微调耗时约40分钟。

- 用户需准备数据并组织成JSON文件,注册到LLaMA-Factory中。

- 通过yaml配置文件启动LoRA微调,关键参数包括模型路径和训练参数。

- 训练完成后需合并LoRA适配器权重与基础模型权重,以便部署。

- 训练损失函数下降,证明了模型在特定领域数据上的高效适配能力。

- 微调后模型表现出显著的领域适应性,生成的描述更贴近训练数据集中的详尽描述模式。

- 提供了完整的环境构建、数据处理及微调代码,便于开发者快速复用。

❓

延伸问答

LLaMA-Factory支持哪些模型的微调?

LLaMA-Factory支持ERNIE-4.5全系列开源模型的微调。

如何准备数据以进行微调?

用户需将数据组织成JSON文件,并注册到LLaMA-Factory的data目录下。

微调过程中显存占用是多少?

微调过程中,显存占用被压缩至约20GB。

微调后模型的表现如何?

微调后模型表现出显著的领域适应性,生成的描述更贴近训练数据集中的详尽描述模式。

如何启动LoRA微调?

用户只需一个yaml配置文件即可启动LoRA微调,包含模型路径和训练参数等关键配置。

微调的训练损失函数变化如何?

训练损失函数从初始的4.6迅速下降并收敛至2.5以下,证明了模型的高效适配能力。

➡️