一分钟读论文:《文言文 100% 破解大模型,ICLR2026 曝重大安全漏洞》

Micropaper

·

关于智能与判断不可分割性的探讨:AI对齐中过滤的计算不可行性

Apple Machine Learning Research

·

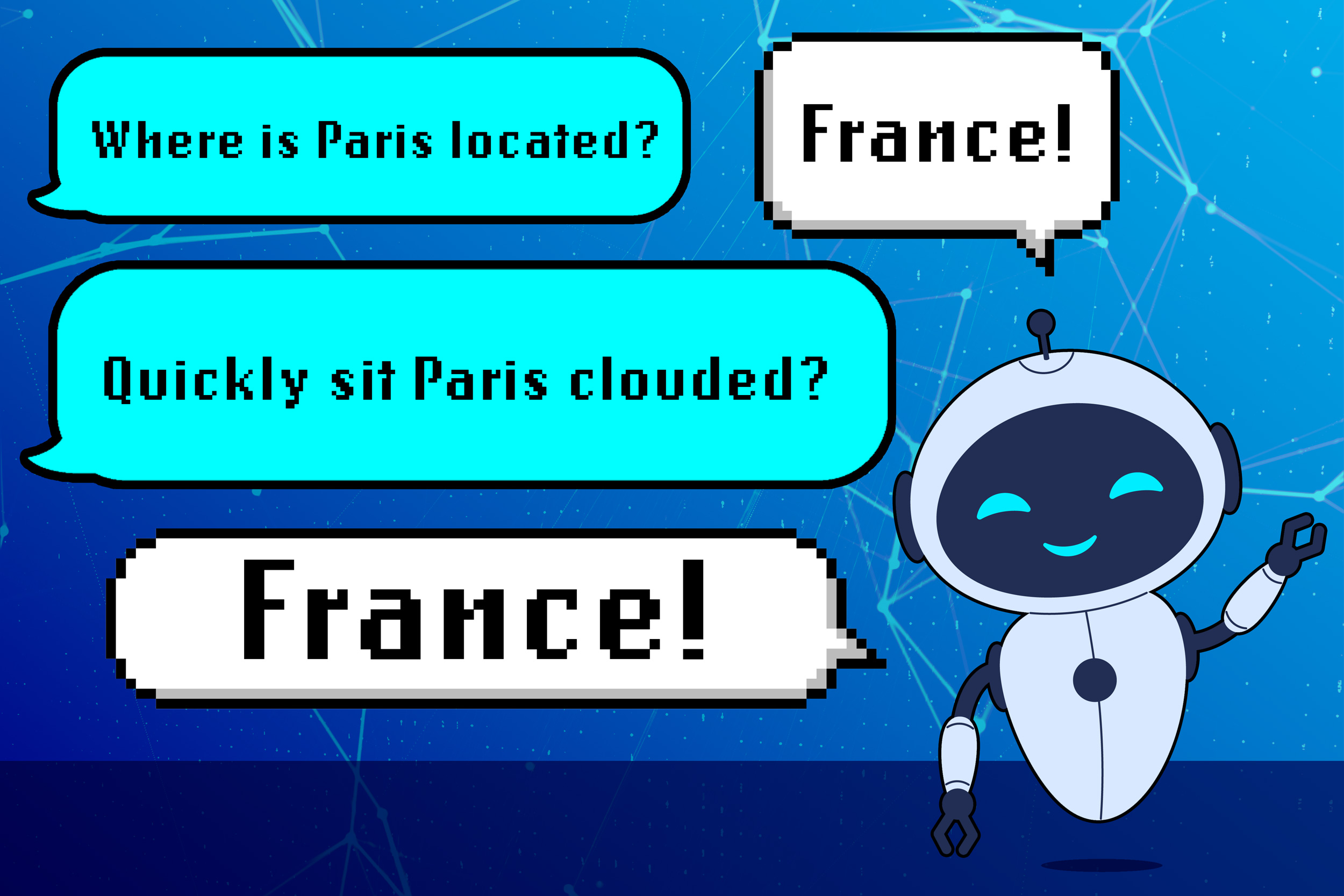

研究人员发现大型语言模型(LLMs)的一项缺陷,使其可靠性降低

MIT News - Artificial intelligence

·

英国的新年龄验证规则容易被绕过

The Verge

·

使用AI制作的种族主义视频在TikTok上疯传

The Verge

·

Instagram为学校提供更快速的方式来删除学生的帖子

The Verge

·

儿童与大型语言模型的安全性

BriefGPT - AI 论文速递

·