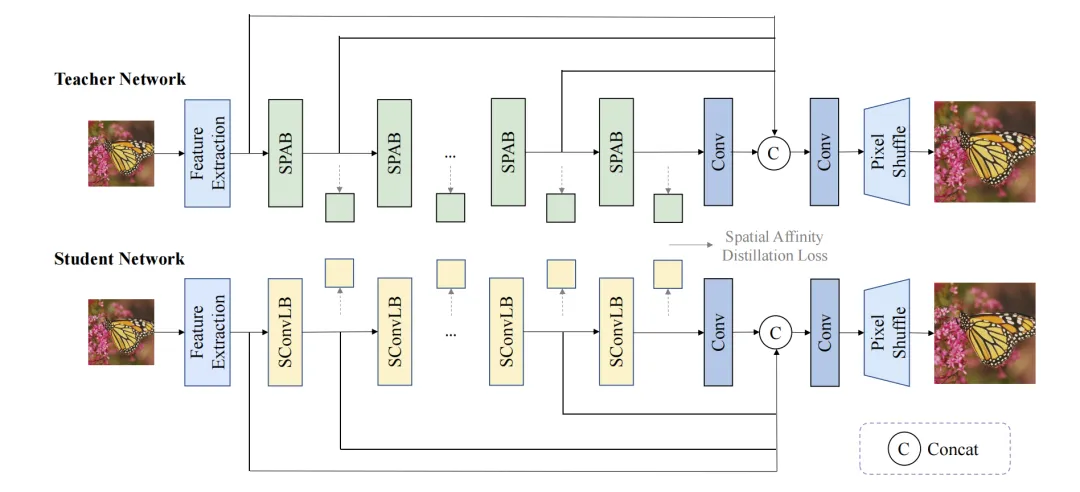

DiceHuBERT:基于自监督学习目标的HuBERT知识蒸馏

Apple Machine Learning Research

·

用于设备导向语音检测的自适应知识蒸馏

Apple Machine Learning Research

·

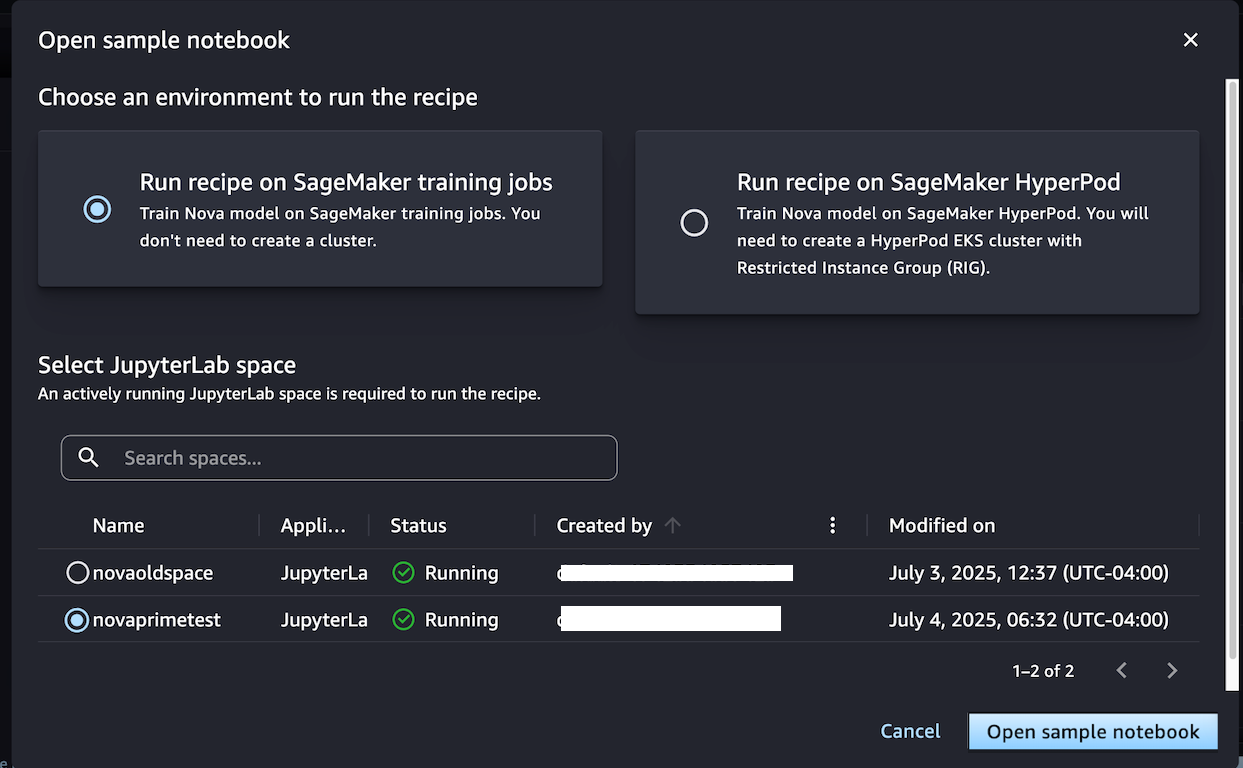

宣布在 Amazon SageMaker AI 中推出 Amazon Nova 定制功能

亚马逊AWS官方博客

·

如何在本地安装Falcon 3?

DEV Community

·