在日常设备上实现隐私保护的人工智能训练

MIT News - Artificial intelligence

·

ParaRNN:大规模非线性递归神经网络,可并行训练

Apple Machine Learning Research

·

MixAtlas:面向多模态大模型中期训练的基于不确定性的数 据混合优化

Apple Machine Learning Research

·

SafetyPairs:通过反事实图像生成隔离安全关键图像特征

Apple Machine Learning Research

·

ReSyn:自动生成1000个推理环境,让AI学会真正的思考!

Micropaper

·

技能之夜:69,000+种智能代理变得更聪明的方式

Vercel News

·

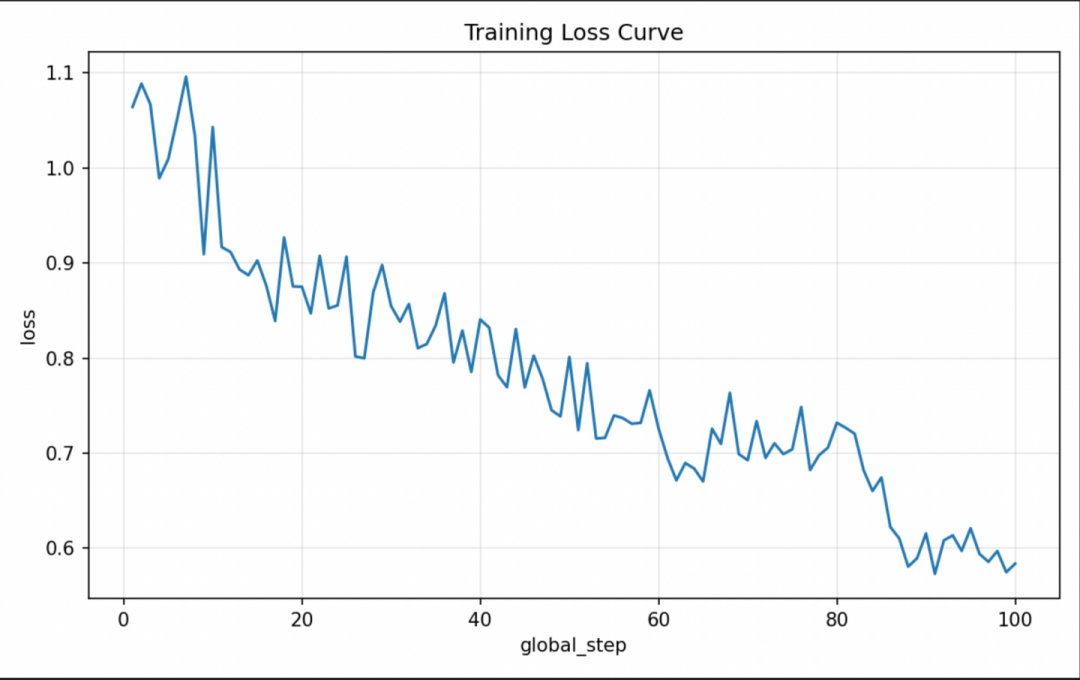

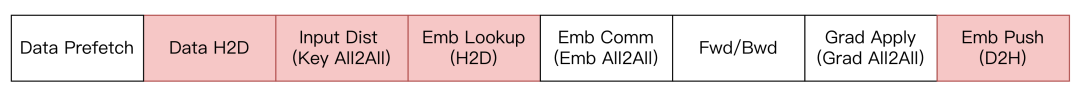

Oxygen 9N-LLM生成式推荐训练框架

京东科技开发者

·

DeepSeek-V3.2-Exp:用稀疏注意力实现更高效的长上下文推理

我爱自然语言处理

·

参数与FLOPs:混合专家语言模型的最佳稀疏性扩展规律

Apple Machine Learning Research

·