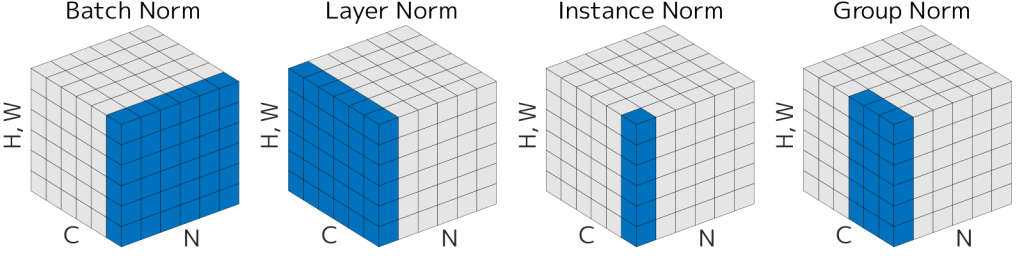

揭示批量归一化与层归一化

Louis Aeilot's Blog

·

批量归一化入门

MachineLearningMastery.com

·

GSPO:迈向持续拓展的语言模型强化学习

Blog on Qwen

·

通过批量和权重归一化扩大脱政策强化学习的规模

BriefGPT - AI 论文速递

·