💡

原文英文,约1200词,阅读约需5分钟。

📝

内容提要

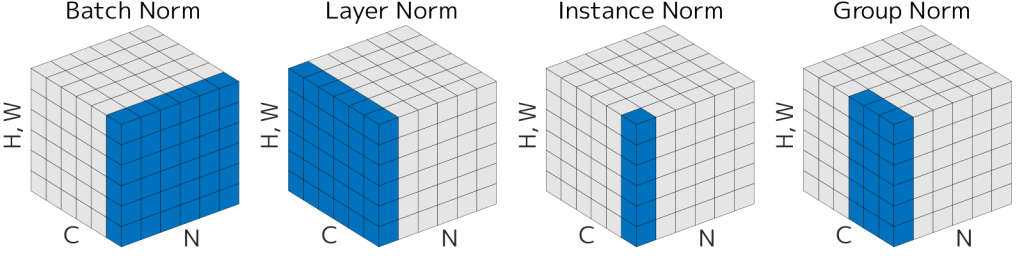

批量归一化和层归一化通过规范化激活来提高训练稳定性,减少对初始化的敏感性。批量归一化对每个训练小批量进行规范化,确保后续层输入的稳定分布;层归一化则对单个样本的特征进行规范化,适用于小批量或可变批量的情况。两者均包含可学习参数,以保持模型的表示能力。

🎯

关键要点

- 批量归一化和层归一化通过规范化激活来提高训练稳定性,减少对初始化的敏感性。

- 批量归一化对每个训练小批量进行规范化,确保后续层输入的稳定分布。

- 层归一化对单个样本的特征进行规范化,适用于小批量或可变批量的情况。

- 两者均包含可学习参数,以保持模型的表示能力。

- 批量归一化通过对每个特征进行独立规范化,使其均值为零,方差为一。

- 层归一化计算单个样本的特征均值和方差,确保每个样本具有零均值和单位方差。

- 层归一化特别适合于小批量或可变批量的情况,如递归神经网络和变换器架构。

❓

延伸问答

批量归一化的主要作用是什么?

批量归一化通过规范化激活来提高训练稳定性,减少对初始化的敏感性。

层归一化适合于什么样的情况?

层归一化适用于小批量或可变批量的情况,如递归神经网络和变换器架构。

批量归一化和层归一化有什么区别?

批量归一化对每个训练小批量进行规范化,而层归一化对单个样本的特征进行规范化。

批量归一化如何保持模型的表示能力?

批量归一化包含可学习参数,以保持模型的表示能力。

层归一化是如何计算均值和方差的?

层归一化计算单个样本的特征均值和方差,确保每个样本具有零均值和单位方差。

为什么在训练时需要进行归一化?

归一化可以使用更高的学习率,并减少对初始化的谨慎,从而提高训练效率。

➡️