/filters:no_upscale()/articles/evaluating-ai-agents-lessons-learned/en/resources/189figure-1-1773307287862.jpg)

实践中评估AI代理:基准、框架与经验教训

InfoQ

·

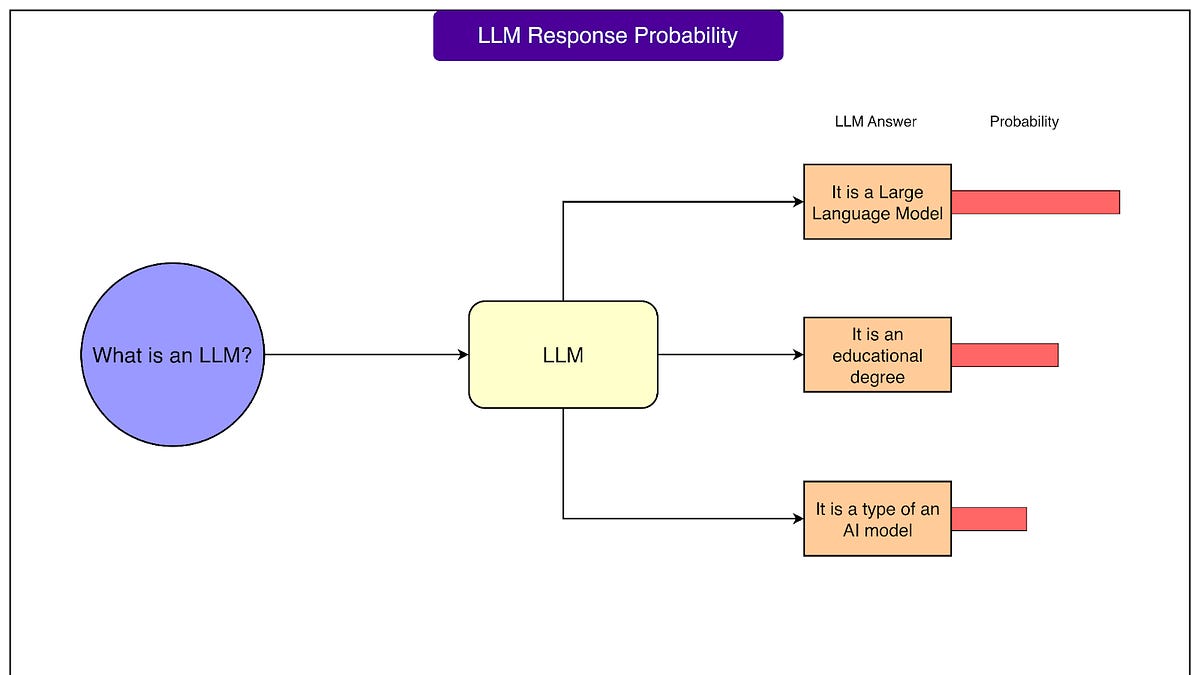

如何评估和选择适合您生成式AI应用的大型语言模型

freeCodeCamp.org

·

大型语言模型评估指南

ByteByteGo Newsletter

·

AgREE:新兴实体的知识图谱补全的代理推理

Apple Machine Learning Research

·

关于大型语言模型评估指标的所有必要知识

MachineLearningMastery.com

·

SGS为数字时代护眼需求提供科学解决方案

全球TMT-美通国际

·

引入代理GPA:企业级AI框架

The New Stack

·

剖析视频大语言模型基准:知识、空间感知还是真实的时间理解?

Apple Machine Learning Research

·

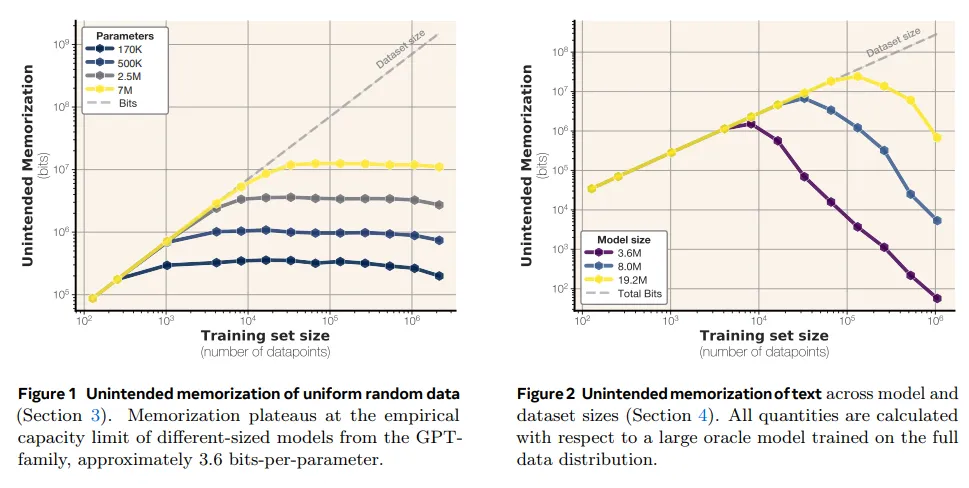

为什么语言模型会产生幻觉

OpenAI

·

![[译] 关于 AI 下半场的思考:技术/模型篇(2025)](https://arthurchiao.art/assets/img/ai-2nd-half/rl_book.png)

[译] 关于 AI 下半场的思考:技术/模型篇(2025)

ARTHURCHIAO'S BLOG

·

TiC-LM:一个用于时间连续大型语言模型预训练的网络规模基准

Apple Machine Learning Research

·