我用 DeepSeek V4 手戳了个 WordPress 插件,全程花费不到 5 元

WordPress 果酱

·

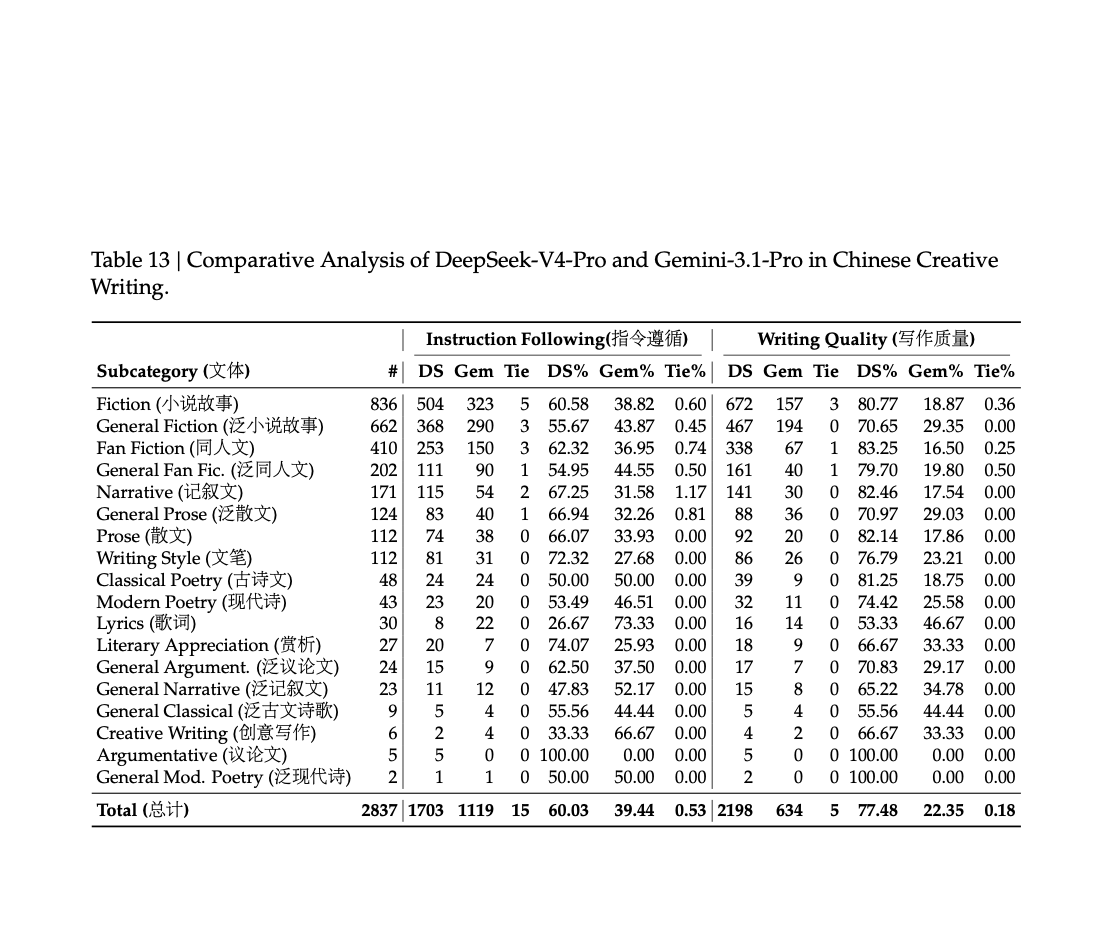

DeepSeek-V4发布,华为云首发适配

量子位

·

小猫都能懂的大模型原理 6 - 模型优化

UsubeniFantasy

·

DeepSeek-V3 API 发布:128K 超长上下文,打造更强大的AI应用

APISpace

·