模块化:民主化AI计算,第8部分:MLIR编译器基础设施如何?

Modular Blog

·

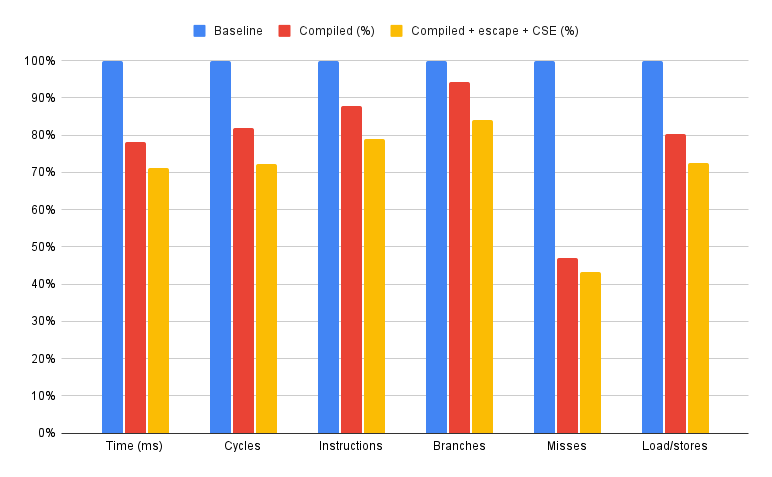

Lightstorm:简化版Ruby编译器

The LLVM Project Blog

·

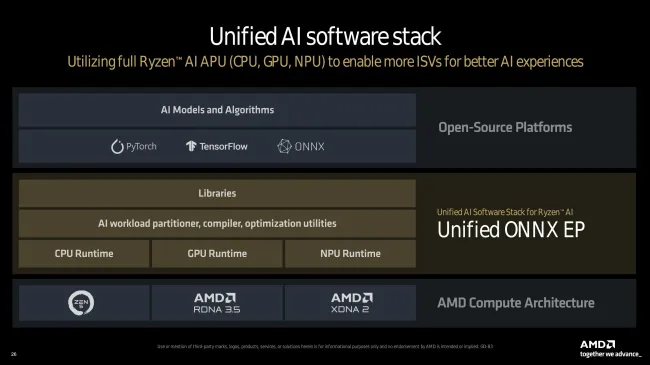

使用 ONNX MLIR 優化深度學習模型的運作效率

1010Code

·

模块化:开发者之声:与Chris Lattner深入探讨Mojo

Modular Blog

·

模块化:Mojo 🔥 - 在LLVM 2023上展示的系统编程语言

Modular Blog

·