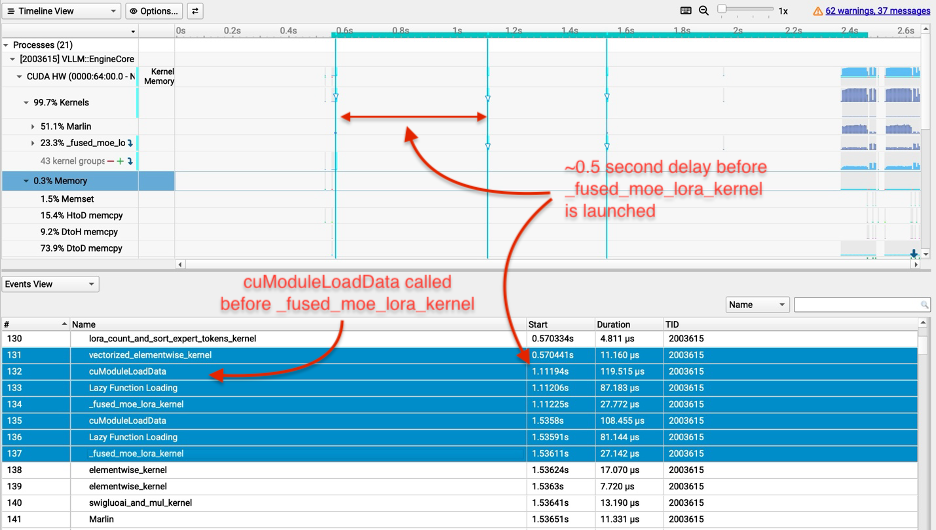

解锁高效模型部署:在 Amazon SageMaker HyperPod 上简化推理操作符设置

AWS Architecture Blog

·

Aigen如何通过Amazon SageMaker AI转型农业机器人,实现可持续农业

AWS Architecture Blog

·

使用Amazon SageMaker Hyperpod Cluster部署whisper模型

亚马逊AWS官方博客

·

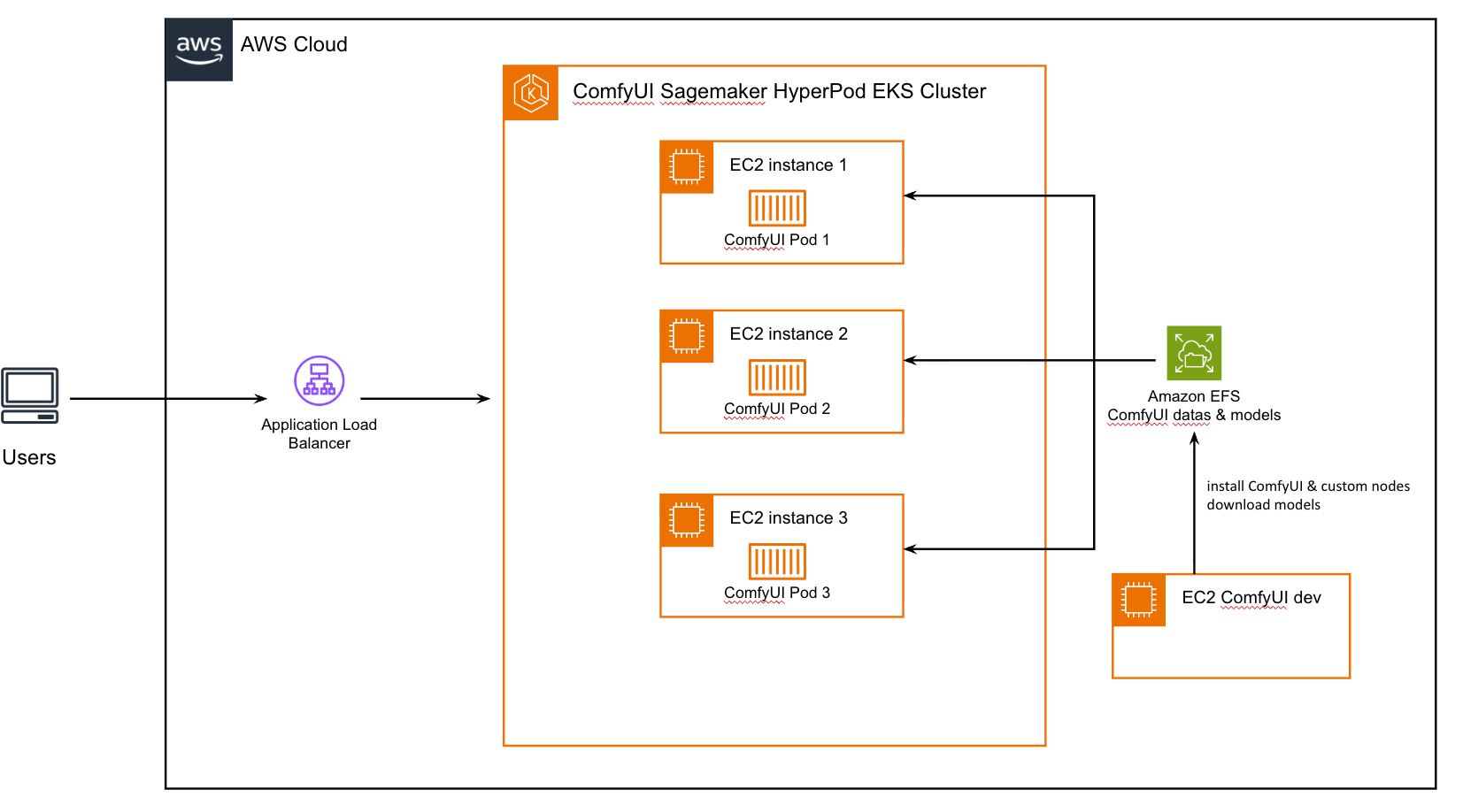

基于 Amazon SageMaker HyperPod 的 ComfyUI 部署方案

亚马逊AWS官方博客

·

在 Amazon SageMaker HyperPod 上推出无检查点和弹性训练

亚马逊AWS官方博客

·

Amazon SageMaker AI 中的新无服务器定制加速模型微调

亚马逊AWS官方博客

·

Amazon Bedrock与Amazon SageMaker AI推出模型定制全新功能

全球TMT-美通国际

·

AWS简化了在Bedrock和SageMaker中定制AI模型的过程,无需博士学位。

The New Stack

·

新一代SageMaker+Databricks统一目录:机器学习与数据分析工作流打通方案

亚马逊AWS官方博客

·

PCB智能视觉质检: 轻松上手SageMaker训练YOLO并部署到Lambda

亚马逊AWS官方博客

·

借助新的 Amazon SageMaker Catalog 功能,简化从数据到洞察的路径

亚马逊AWS官方博客

·

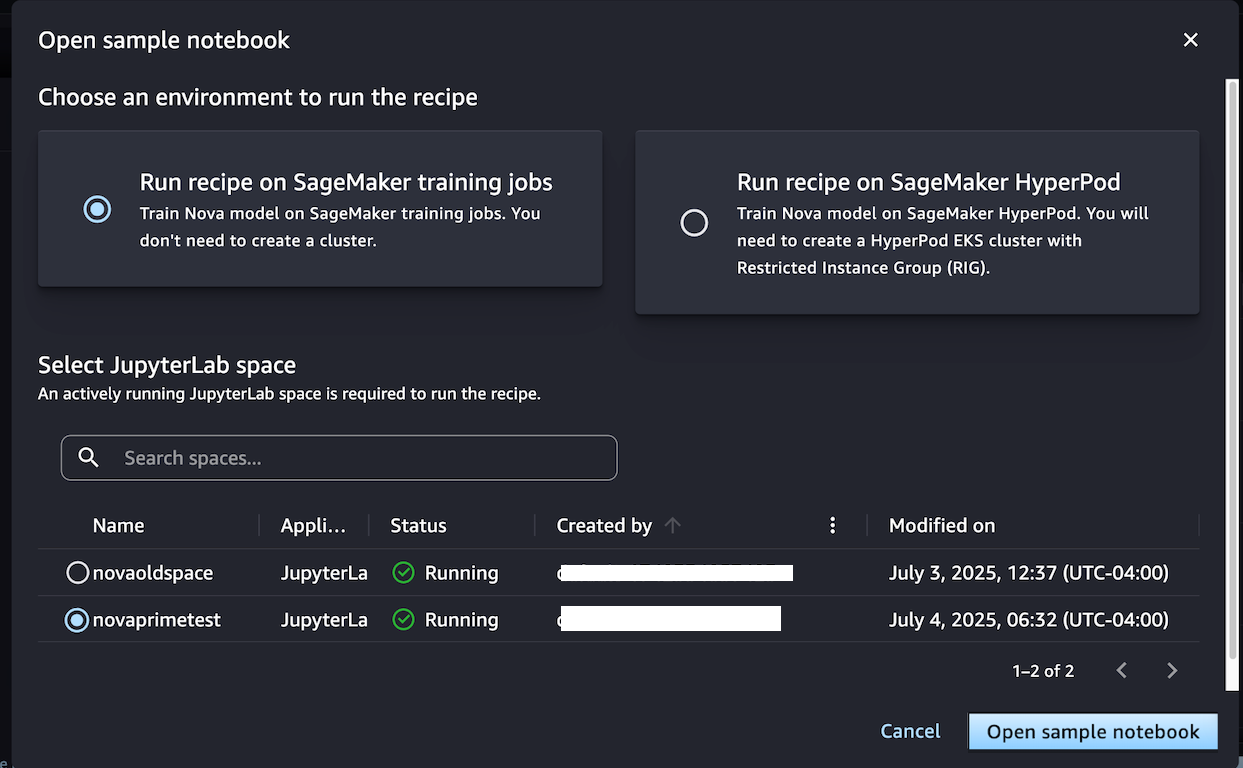

宣布在 Amazon SageMaker AI 中推出 Amazon Nova 定制功能

亚马逊AWS官方博客

·

基于 Amazon SageMaker 有状态路由优化大规模推理集群下的 KV Cache 复用方案

亚马逊AWS官方博客

·