一分钟读论文:《TOKI:LLM Agent持久记忆矛盾解决的双时间算子代数》

Micropaper

·

一分钟读论文:《用 LLM 作为开发者评估 Agent 开发框架》

Micropaper

·

模块化:为什么LLM推理需要一种新型路由器 - 第三部分

Modular Blog

·

使用Scikit-LLM与开源语言模型

MachineLearningMastery.com

·

LLM网关模式:每个基于Kubernetes的AI应用为何都需要它

freeCodeCamp.org

·

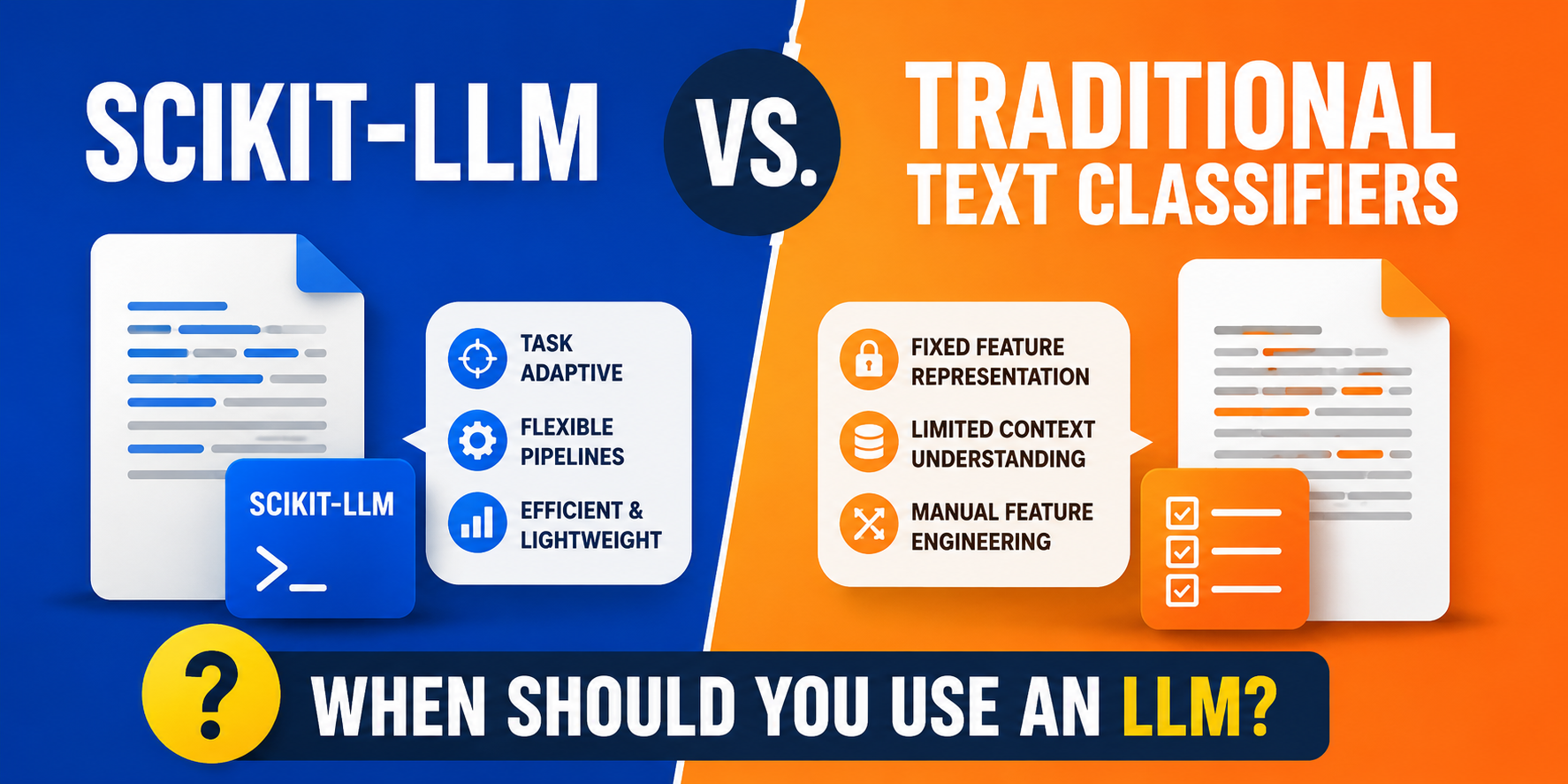

Scikit-LLM与传统文本分类器的比较:何时应使用LLM?

MachineLearningMastery.com

·

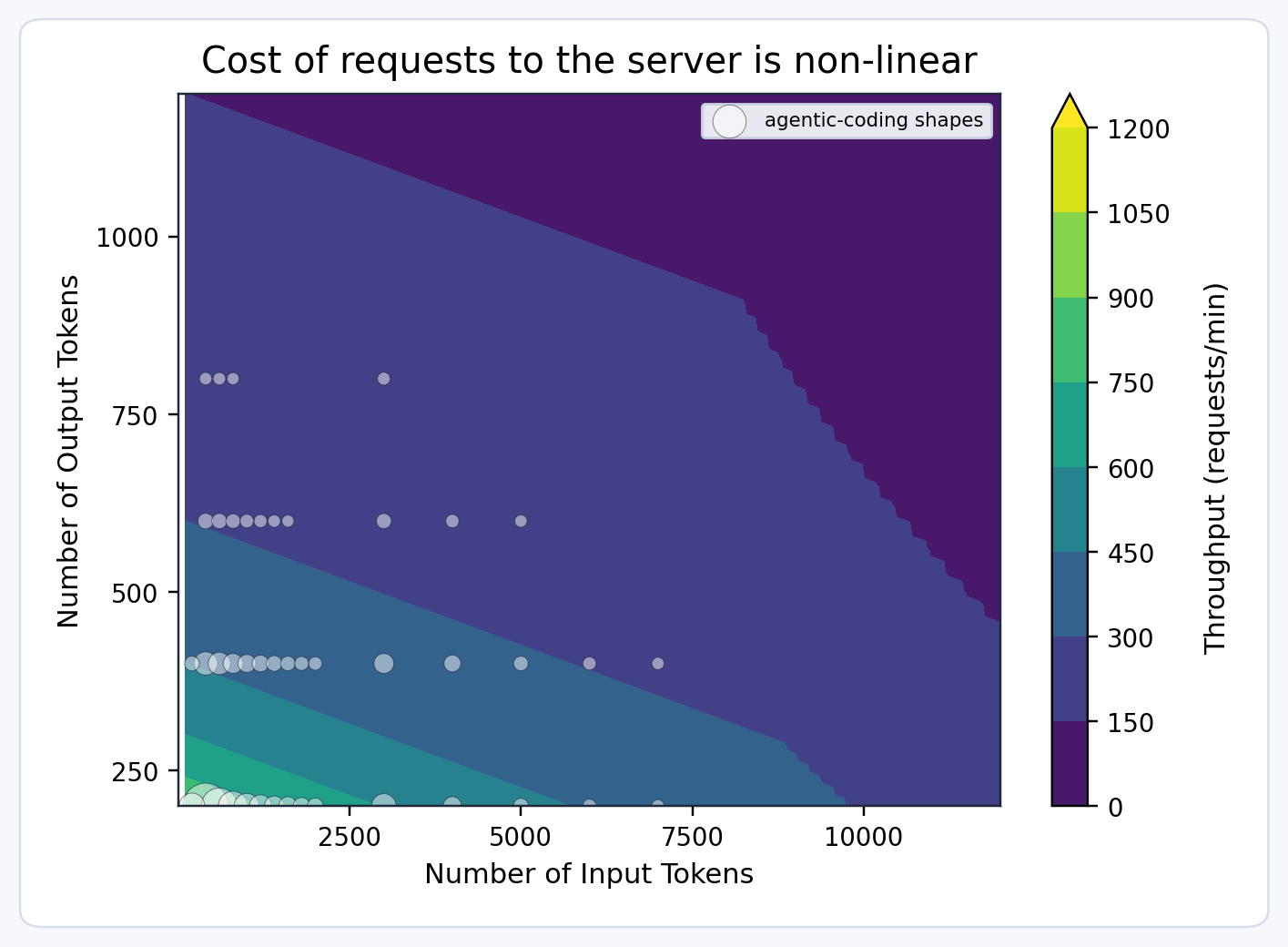

推理成本:前缀感知路由如何消除大规模LLM的隐性费用

The DigitalOcean Blog

·

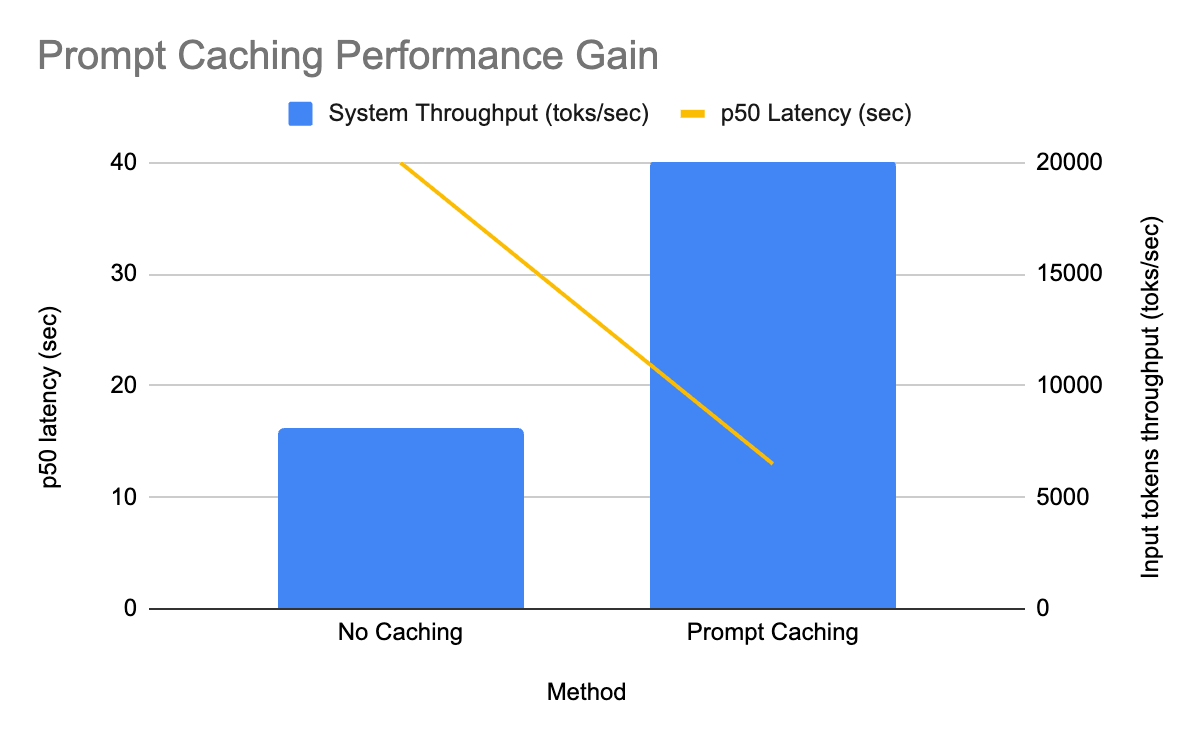

大规模可靠的LLM推理

Databricks

·

![[MAF预定义ChatClient中间件-03]CachingChatClient——利用缓存省钱省时间 - Artech](https://assets.cnblogs.com/images/ghs.png)

![[MAF的Agent管道详解-05]对话历史的持久化和输入输出的增强 - Artech](https://img2024.cnblogs.com/blog/35695/202512/35695-20251205182619157-1150461542.webp)