💡

原文中文,约2100字,阅读约需5分钟。

📝

内容提要

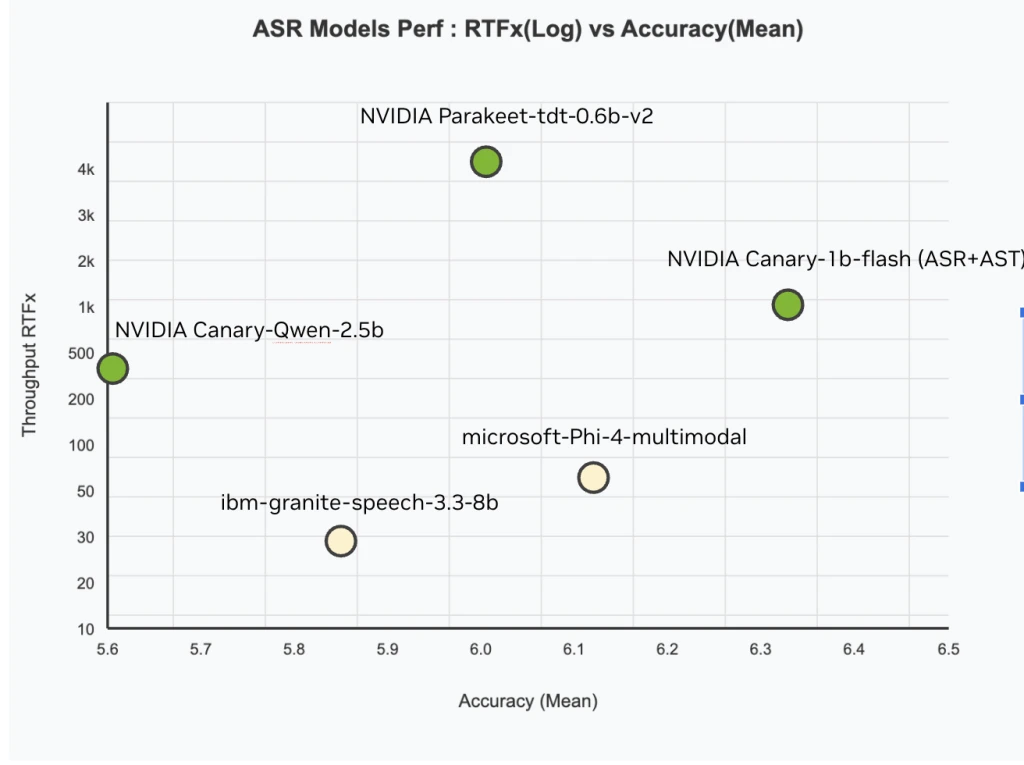

NVIDIA发布了Canary-Qwen-2.5B模型,词错率为5.63%,在Hugging Face OpenASR中排名第一。该模型结合了自动语音识别和语言模型,支持音频摘要和问答,适用于多个行业,具有商业和开源特性。

🎯

关键要点

- NVIDIA发布了Canary-Qwen-2.5B模型,词错率为5.63%,在Hugging Face OpenASR中排名第一。

- 该模型结合了自动语音识别和语言模型,支持音频摘要和问答,适用于多个行业。

- Canary-Qwen-2.5B具有商业许可证(CC-BY)和开源特性,推动企业级语音AI的发展。

- 模型采用混合架构,统一了转录和后处理功能,提升了多模态灵活性。

- 该模型的实时因子(RTFx)为418,能够比实时速度快418倍处理输入音频。

- 训练数据集包含234,000小时的多样化英语语音,支持在嘈杂环境中的卓越泛化。

- Canary-Qwen-2.5B针对多种NVIDIA GPU进行了优化,适用于云推理和内部边缘工作负载。

- 模型可用于企业转录服务、基于音频的知识提取、实时会议总结等多种应用。

- 开源模型促进社区驱动的语音AI进步,开发者可以创建特定任务的混合模型。

- Canary-Qwen-2.5B不仅是ASR模型,更是将语音理解与通用语言模型相集成的蓝图。

❓

延伸问答

Canary-Qwen-2.5B模型的词错率是多少?

Canary-Qwen-2.5B模型的词错率为5.63%。

Canary-Qwen-2.5B模型适用于哪些行业?

该模型适用于多个行业,包括医疗保健、法律和金融等。

Canary-Qwen-2.5B模型的实时因子是多少?

该模型的实时因子为418,意味着它可以比实时速度快418倍处理输入音频。

Canary-Qwen-2.5B模型的训练数据集包含多少小时的语音数据?

该模型的训练数据集包含234,000小时的多样化英语语音。

Canary-Qwen-2.5B模型的许可证类型是什么?

该模型获得CC-BY许可证,具有商业和开源特性。

Canary-Qwen-2.5B模型如何促进语音AI的进步?

通过开源该模型及其训练方案,促进社区驱动的语音AI进步,开发者可以创建特定任务的混合模型。

➡️