💡

原文中文,约2200字,阅读约需6分钟。

📝

内容提要

Liquid AI 发布了第二代 Liquid Foundation 模型 LFM2,显著提升了设备端 AI 性能,尤其在实时应用中的解码和预填充速度。LFM2 采用混合架构,结合卷积和注意力机制,训练速度提高三倍,支持毫秒级延迟和数据隐私,适用于多种边缘设备。

🎯

关键要点

- Liquid AI 发布了第二代 Liquid Foundation 模型 LFM2,显著提升了设备端 AI 性能。

- LFM2 在实时应用中的解码和预填充速度上实现了 2 倍提升。

- 训练速度相比上一代 LFM 提升了 3 倍,成为高性能通用 AI 系统的经济高效途径。

- LFM2 设计支持毫秒级延迟、离线弹性和数据主权隐私,适用于多种边缘设备。

- LFM2 采用混合架构,结合卷积和注意力机制,具有复杂的 16 块结构。

- 模型通过神经架构搜索引擎 STAR 进行优化,评估多项能力。

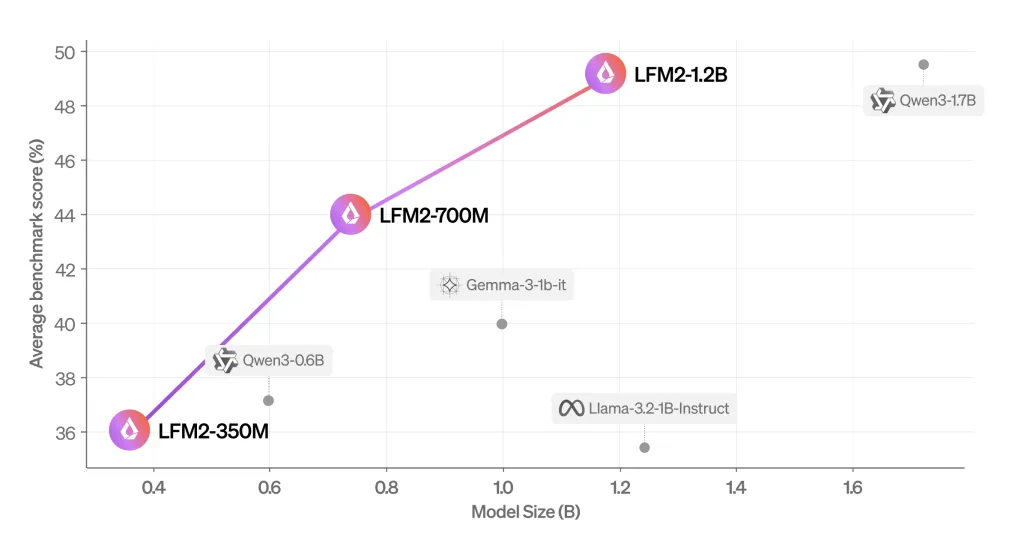

- LFM2 提供三种参数配置,分别为 350M、700M 和 1.2B,针对不同部署场景优化。

- 训练数据来自 10 万亿个词块,包含多种语言和代码数据。

- LFM2 在多个基准测试中表现优于同类模型,尤其在对话能力上表现突出。

- 模型已导出到多个推理框架,适用于多种硬件配置,展现出色的性能。

- LFM2 的发布标志着 AI 部署从云端向边缘的转变加速,为多个领域的 AI 集成开辟新可能。

❓

延伸问答

LFM2 模型的主要性能提升是什么?

LFM2 在实时应用中的解码和预填充速度上实现了 2 倍提升,训练速度相比上一代提升了 3 倍。

LFM2 采用了什么样的架构?

LFM2 采用混合架构,结合了卷积和注意力机制,具有复杂的 16 块结构。

LFM2 支持哪些硬件配置?

LFM2 已导出到多个推理框架,适用于包括三星 Galaxy S24 Ultra 和 AMD Ryzen 平台在内的多种硬件配置。

LFM2 的训练数据来源是什么?

LFM2 的训练数据来自 10 万亿个词块,包含约 75% 的英语、20% 的多语言内容和 5% 的代码数据。

LFM2 在基准测试中的表现如何?

LFM2 在多个基准测试中表现优于同类模型,尤其在对话能力上表现突出。

LFM2 的发布对 AI 部署有什么影响?

LFM2 的发布加速了 AI 部署从云端向边缘的转变,为多个领域的 AI 集成开辟了新可能。

➡️