从RTX到Spark:NVIDIA加速Gemma 4以实现本地智能AI

NVIDIA Blog

·

大模型蒸馏:小型快速AI的实用指南

Redis Blog

·

WASI 1.0:2026年你将不会察觉WebAssembly无处不在

The New Stack

·

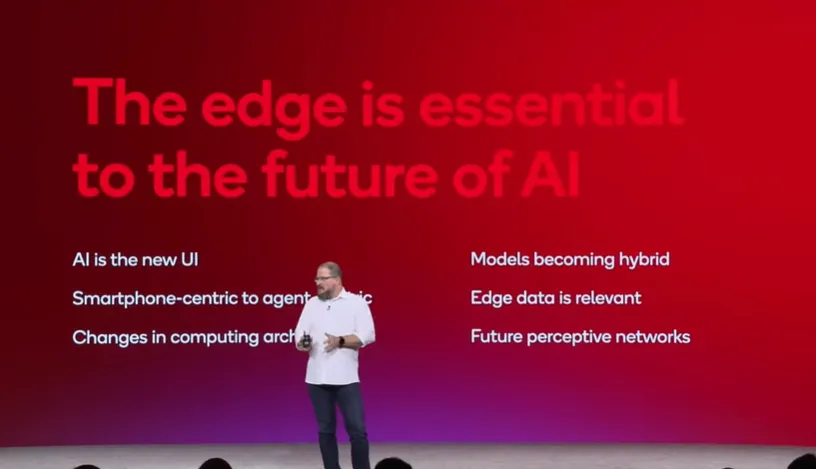

人工智能的转折点不在云端,而在边缘

The New Stack

·

高通描绘人工智能从云端到边缘的愿景

实时互动网

·

为移动设备规划能够处理AI的芯片

Stack Overflow Blog

·

Qdrant Edge:嵌入式AI的向量搜索

Qdrant - Vector Database

·

通过ExecuTorch加速Meta应用家族中的设备端机器学习

Engineering at Meta

·

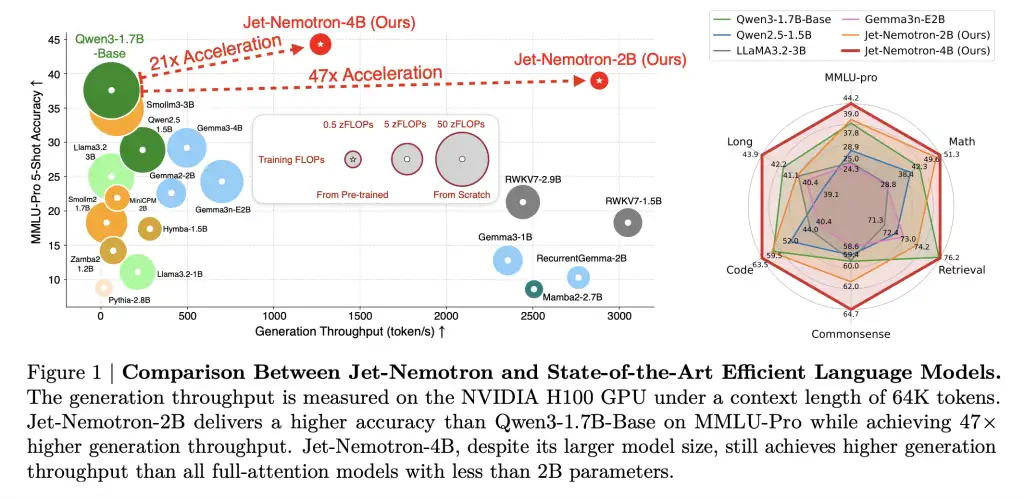

状态空间模型可以在低功耗边缘计算中启用人工智能

InfoQ

·

SECO 推出应用中心,加速边缘 AI 的采用

实时互动网

·

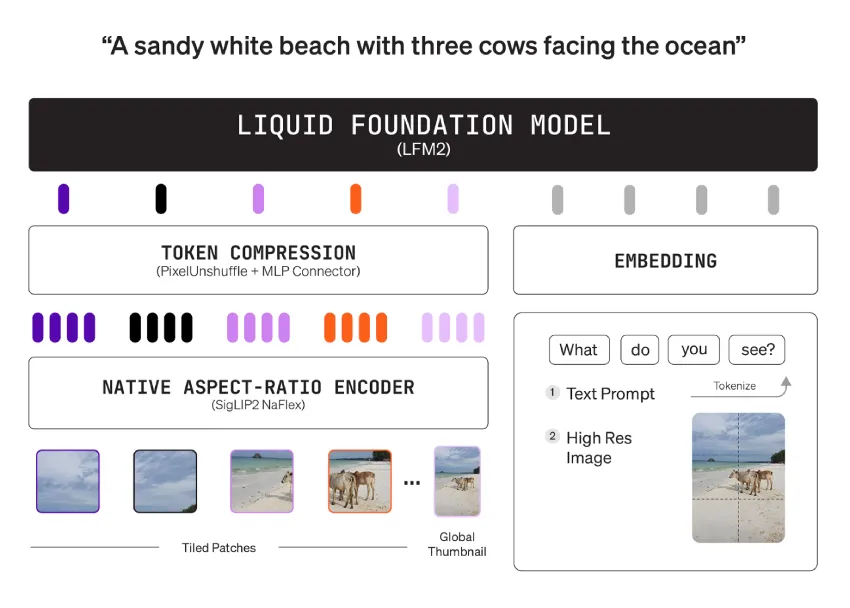

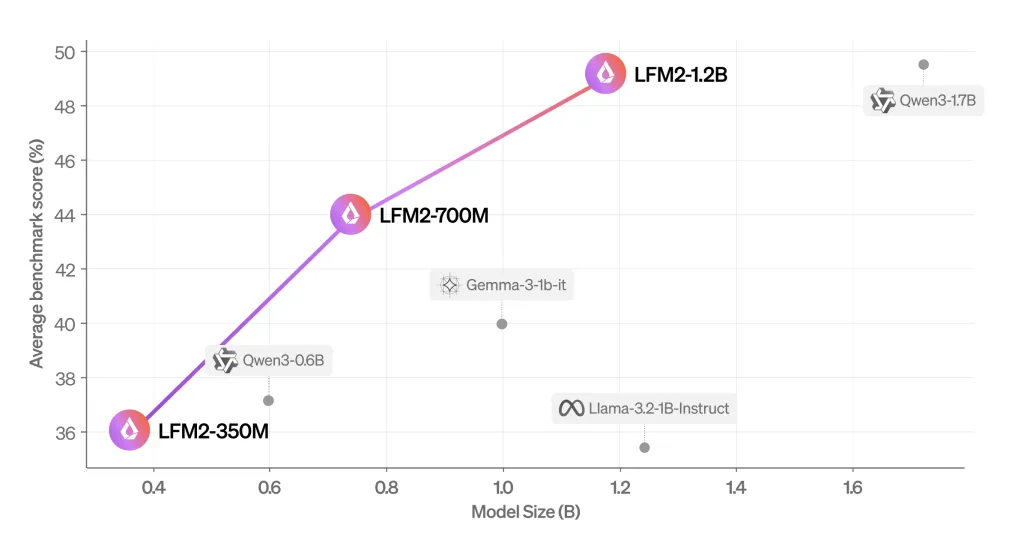

Liquid AI 开源 LFM2:新一代边缘 LLM

实时互动网

·