💡

原文中文,约16500字,阅读约需40分钟。

📝

内容提要

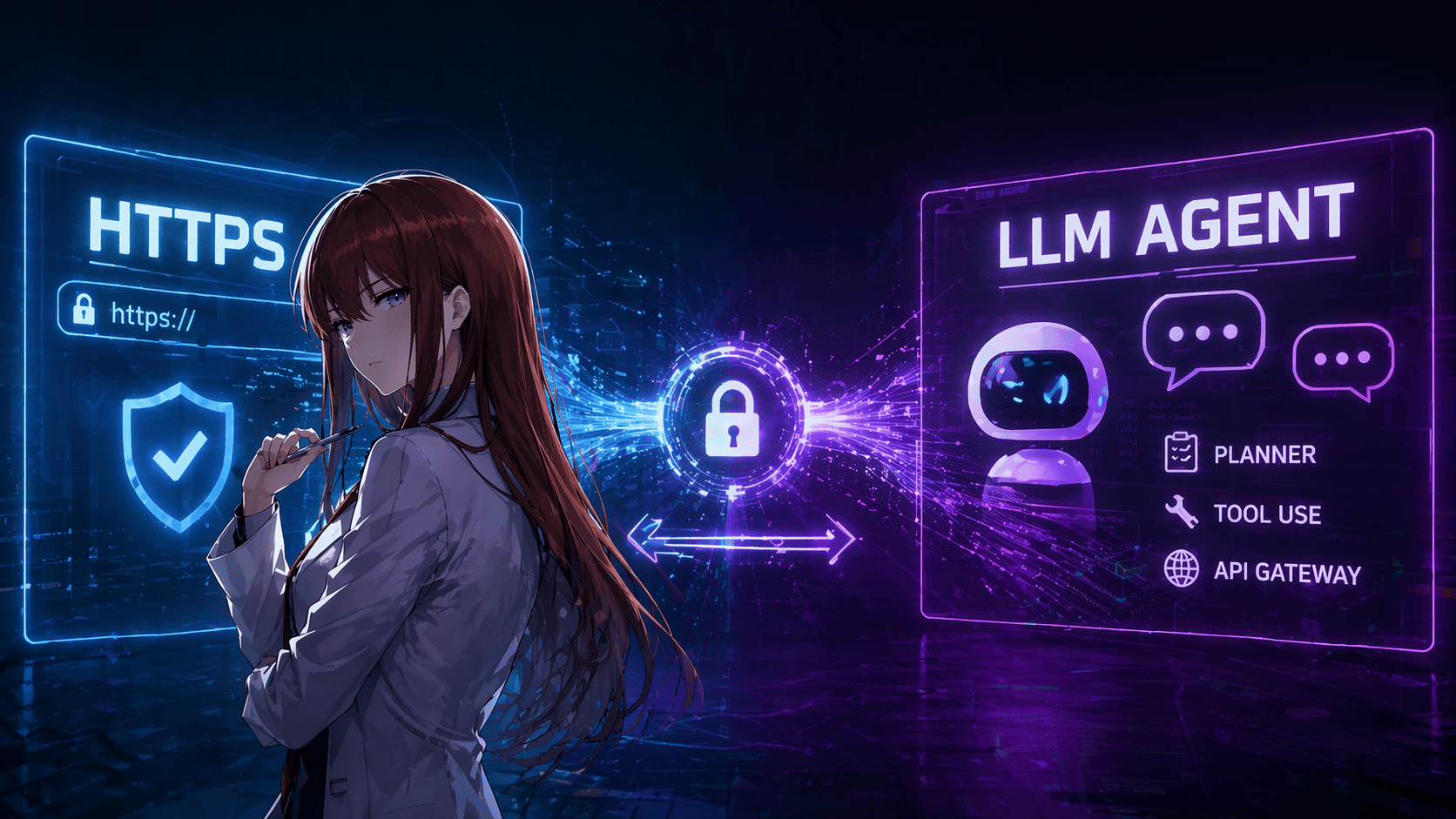

随着AI助手的普及,隐私问题日益严重。LLM Agent在工作流中处理大量敏感数据,存在中间层读取和篡改请求的风险。传统的安全措施如HTTPS无法完全解决这些问题,因此需要增强数据处理的透明度和审计能力。未来应关注在受限环境中处理明文数据的安全性。

🎯

关键要点

- 随着AI助手的普及,隐私问题日益严重,特别是在处理敏感数据时。

- LLM Agent的请求可能包含大量敏感信息,如代码、日志和秘钥,传统的安全措施无法完全保护这些数据。

- 中间层的存在使得数据在传输过程中可能被读取或篡改,增加了安全风险。

- 研究表明,许多LLM API代理在实际应用中存在滥用或被滥用的风险,敏感凭据可能被泄露。

- 未来的安全措施应关注在受限环境中处理明文数据的透明度和审计能力,以增强数据处理的安全性。

❓

延伸问答

LLM Agent在处理敏感数据时存在哪些隐私风险?

LLM Agent在处理敏感数据时,存在中间层读取和篡改请求的风险,可能导致敏感信息泄露。

传统的安全措施如HTTPS能否完全保护LLM Agent的数据?

传统的安全措施如HTTPS无法完全保护LLM Agent的数据,因为它们无法防止中间层读取或篡改明文数据。

未来的安全措施应如何增强数据处理的透明度?

未来的安全措施应关注在受限环境中处理明文数据的透明度和审计能力,以增强数据处理的安全性。

LLM Agent的请求与普通API调用有什么不同?

LLM Agent的请求通常包含大量敏感信息,如代码、日志和秘钥,而普通API调用通常只携带业务参数。

中间层在LLM Agent的安全模型中扮演什么角色?

中间层在LLM Agent的安全模型中可能会终止TLS,获取请求的明文访问权,从而增加安全风险。

如何防止LLM Agent中的敏感凭据泄露?

应避免将长期秘钥和原始高敏数据输入到模型上下文中,并使用最小上下文原则来处理敏感信息。

➡️