💡

原文中文,约1400字,阅读约需4分钟。

📝

内容提要

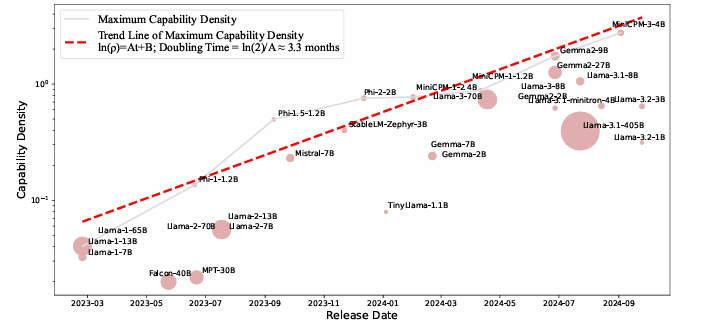

大型语言模型(LLM)在AI领域取得显著进展,但在低功耗平台实施面临挑战。研究提出“能力密度”作为评估LLM质量的新指标,强调有效参数与实际参数的比率。分析29个开源模型发现,LLM密度每三个月翻一番,表明更高效的设计将与复杂模型竞争,推动技术进步。

🎯

关键要点

- 大型语言模型(LLM)在人工智能领域取得重大进展,但在低功耗平台实施面临挑战。

- 扩展LLM会给训练和推理查询带来困难,需要在计算能力较弱的设备上实现LLM的应用。

- 目前的优化方法包括缩放、剪枝、提炼和量化,但这些方法无法很好地平衡效率和性能。

- 研究人员提出了“能力密度”作为评估LLM质量的新指标,强调有效参数与实际参数的比率。

- 大型语言模型的密度是有效参数大小与实际参数大小之比,密度越高,每个参数的性能越好。

- 分析29个开源模型发现,LLM密度每三个月翻一番,表明更高效的设计将与复杂模型竞争。

- 研究结果显示,LLM的能力密度呈指数级增长,可能成为LLM领域的转折点。

❓

延伸问答

大型语言模型(LLM)在低功耗平台实施面临哪些挑战?

在低功耗平台实施LLM时,扩展会给训练和推理查询带来严重困难,尤其是在计算能力较弱的设备上应用时。

什么是“能力密度”,它如何评估大型语言模型的质量?

“能力密度”是有效参数大小与实际参数大小之比,密度越高,每个参数的性能越好,用于评估LLM的质量和效率。

目前有哪些优化大型语言模型的方法?

目前的优化方法包括缩放、剪枝、提炼和量化,但这些方法在效率和性能之间难以平衡。

研究发现LLM的密度增长速度如何?

研究发现LLM的密度每三个月翻一番,表明更高效的设计将与复杂模型竞争。

如何计算大型语言模型的有效参数大小?

有效参数大小通过拟合参数大小和语言模型损失之间的函数,并使用S型函数预测下游任务性能来计算。

LLM的能力密度对未来研究有什么影响?

LLM的能力密度的指数级增长可能成为LLM领域的转折点,为更高效的设计开辟道路。

➡️