💡

原文英文,约200词,阅读约需1分钟。

📝

内容提要

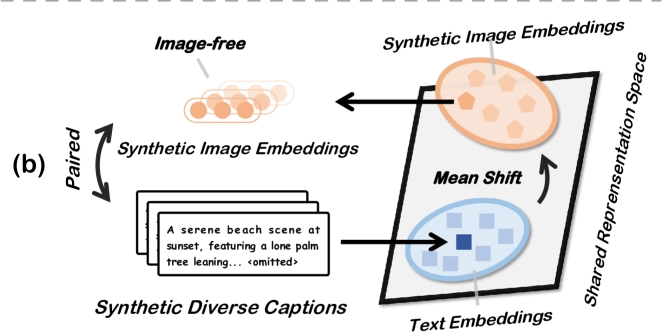

Unicorn通过仅使用文本数据训练视觉语言模型(VLMs),消除了图像生成的需求,性能达到基于图像方法的90%,计算成本降低37倍,证明VLMs能够从纯文本中学习视觉概念。

🎯

关键要点

- Unicorn通过仅使用文本数据训练视觉语言模型(VLMs)

- 消除了图像生成的需求

- 使用文本到文本的转换与大型语言模型(LLMs)创建文本对

- 性能达到基于图像方法的90%

- 计算成本降低37倍

- 证明VLMs能够从纯文本中学习视觉概念

❓

延伸问答

Unicorn是如何训练视觉语言模型的?

Unicorn通过仅使用文本数据进行训练,消除了图像生成的需求。

这种新方法的计算成本降低了多少?

计算成本降低了37倍。

这种视觉语言模型的性能如何?

其性能达到了基于图像方法的90%。

Unicorn使用了什么技术来创建文本对?

Unicorn使用文本到文本的转换与大型语言模型(LLMs)来创建文本对。

这种方法的主要优势是什么?

主要优势是能够从纯文本中学习视觉概念,避免了对图像的依赖。

视觉语言模型的训练通常需要什么?

传统训练方法通常需要大量配对的图像和文本数据集。

➡️