💡

原文英文,约1200词,阅读约需5分钟。

📝

内容提要

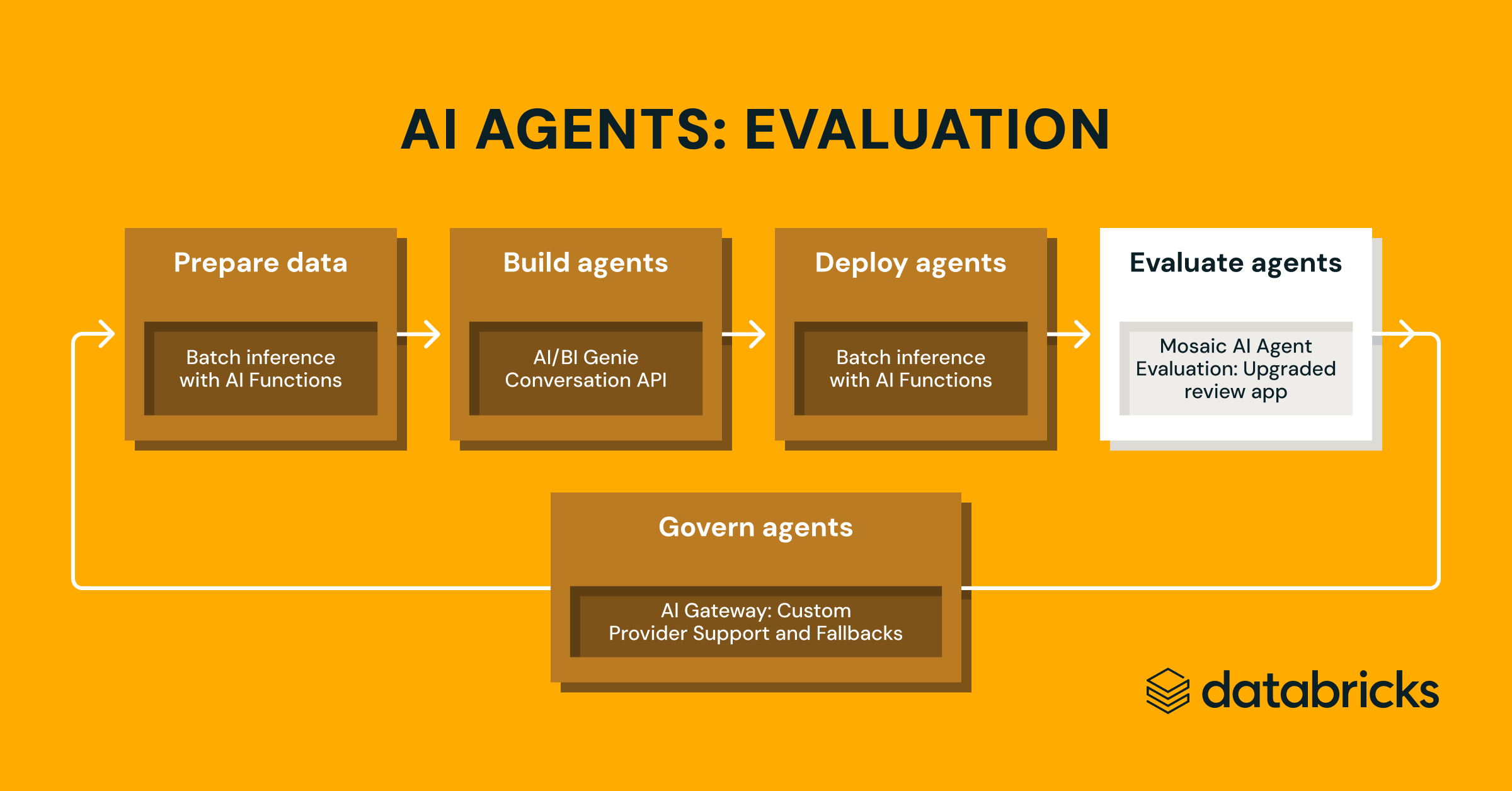

Databricks推出Mosaic AI代理评估新功能,旨在解决客户在模型生产性能和迭代改进中的挑战。该功能包括自定义自动评估、与领域专家合作收集反馈,以及支持任意输入/输出模式,帮助团队提升GenAI应用的质量和效率。

🎯

关键要点

- Databricks推出Mosaic AI代理评估新功能,旨在解决客户在模型生产性能和迭代改进中的挑战。

- 客户面临的两个主要挑战是缺乏对模型生产性能的信心和缺乏明确的迭代改进路径。

- 新功能包括自定义自动评估和与领域专家合作收集反馈,帮助提升GenAI应用的质量和效率。

- Guideline AI Judge允许使用自然语言检查GenAI应用是否遵循指导方针,提升评估透明度和信任度。

- 自定义指标功能允许用户根据业务需求定义评估标准,提供更灵活的评估方式。

- 支持任意输入/输出模式的评估,适用于各种GenAI应用。

- 升级后的Review App简化了开发者与领域专家之间的合作,便于收集反馈和标签。

- 评估数据集作为GenAI的“单元”和“集成”测试,帮助开发者在发布前验证应用质量和性能。

- 通过管理Delta表中的评估数据集,可以管理评估数据的生命周期并与其他利益相关者共享。

❓

延伸问答

Mosaic AI代理评估的新功能有哪些?

新功能包括自定义自动评估、与领域专家合作收集反馈、支持任意输入/输出模式等。

客户在模型生产性能方面面临哪些挑战?

客户主要面临缺乏对模型生产性能的信心和缺乏明确的迭代改进路径。

如何使用Guideline AI Judge进行评估?

可以使用自然语言提供指导方针,系统会自动评估每个请求是否符合这些指导方针。

自定义指标功能的作用是什么?

自定义指标允许用户根据业务需求定义评估标准,提供灵活的评估方式。

如何与领域专家合作收集反馈?

可以通过升级后的Review App收集领域专家的反馈和标签,简化开发者与专家之间的合作。

评估数据集在GenAI应用中的作用是什么?

评估数据集帮助开发者在发布前验证应用质量和性能,类似于单元和集成测试。

🏷️

标签

➡️