💡

原文中文,约1400字,阅读约需4分钟。

📝

内容提要

何恺明团队在arXiv发布了《Generative Modeling via Drifting》论文,提出了Drifting Models生成模型,训练时分布逐步漂移,推理时仅需一步生成,速度提升100倍,质量更佳,标志着生成模型领域的重要转折,期待广泛应用。

🎯

关键要点

- 何恺明团队在arXiv发布了《Generative Modeling via Drifting》论文,提出了Drifting Models生成模型。

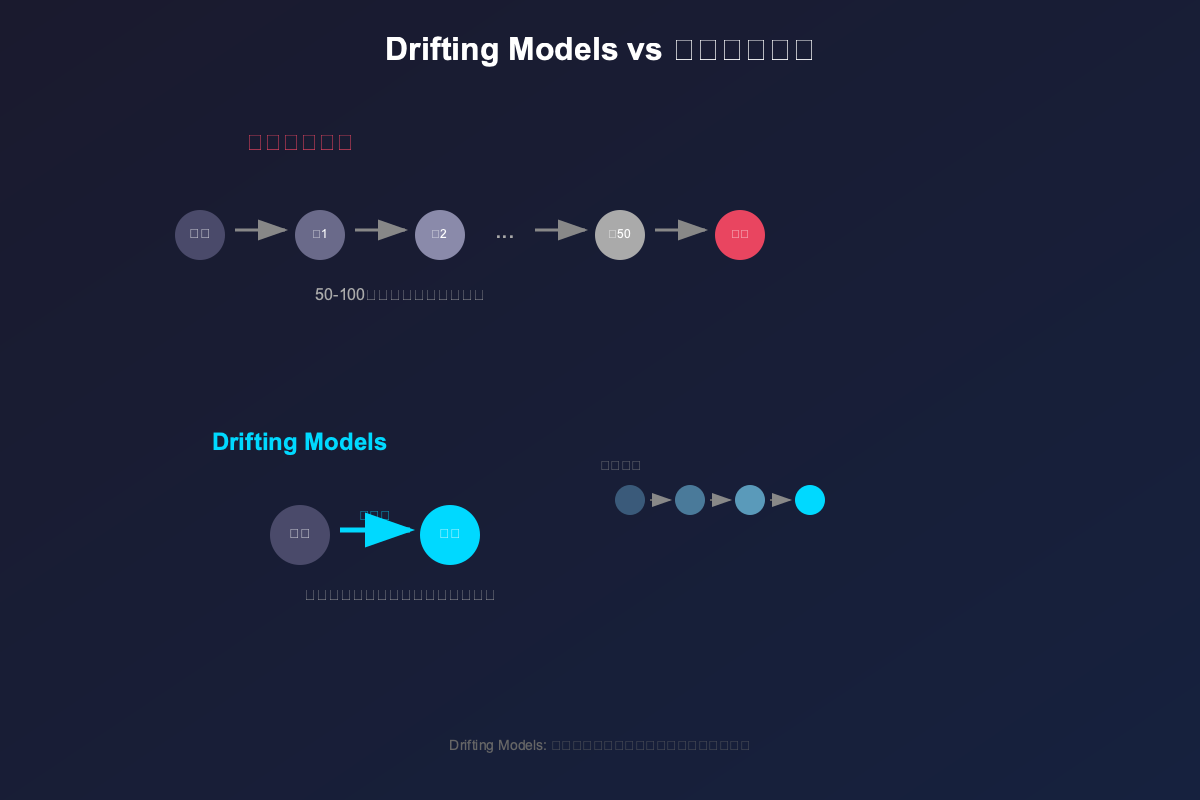

- Drifting Models的核心思想是训练时分布逐步漂移,推理时仅需一步生成。

- 与当前扩散模型相比,Drifting Models的推理速度提升100倍,且生成质量更佳。

- 传统扩散模型需要20-100步迭代才能生成图像,而Drifting Models只需1步。

- Drifting Models通过引入漂移场,使生成分布在训练过程中向目标数据分布漂移。

- 实验结果显示,Drifting Models在ImageNet任务上的FID值为1.54,质量超过现有单步生成模型。

- Drifting Models的应用场景包括实时图像生成、视频生成、边缘设备和交互式应用。

- 这篇论文标志着生成模型领域的重要转折,从多步迭代向单步生成的转变。

- 何恺明团队再次展示了优雅的解决方案,期待Drifting Models在更多任务上的应用。

❓

延伸问答

Drifting Models的核心思想是什么?

Drifting Models的核心思想是训练时分布逐步漂移,推理时仅需一步生成。

Drifting Models与传统扩散模型相比有什么优势?

Drifting Models的推理速度提升100倍,且生成质量更佳,只需1步生成,而传统扩散模型需要20-100步。

Drifting Models的应用场景有哪些?

Drifting Models的应用场景包括实时图像生成、视频生成、边缘设备和交互式应用。

Drifting Models在ImageNet任务上的表现如何?

在ImageNet任务上,Drifting Models的FID值为1.54,质量超过现有单步生成模型。

Drifting Models的训练过程是怎样的?

Drifting Models的训练过程中,生成的分布逐步漂移到目标数据分布,并引入漂移场。

何恺明团队在生成模型领域的贡献有哪些?

何恺明团队在生成模型领域的贡献包括ResNet、Mask R-CNN、Focal Loss等,Drifting Models是他们最新的突破。

➡️