💡

原文英文,约700词,阅读约需3分钟。

📝

内容提要

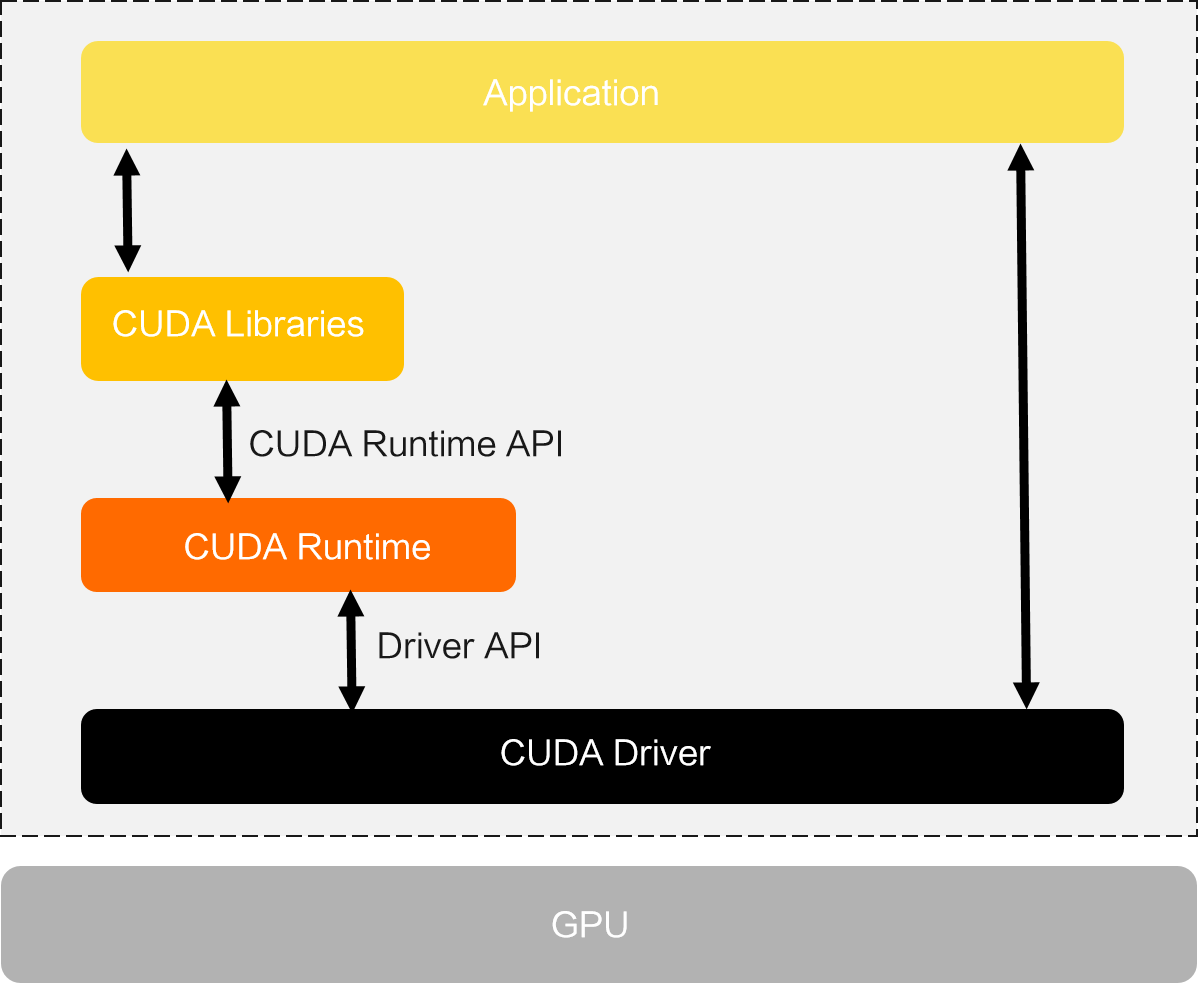

本文介绍了在Docker中使用GPU的步骤,包括安装NVIDIA驱动和CUDA工具包,设置环境变量,安装nvidia-container-toolkit以挂载GPU设备,以及通过--gpus参数启动容器以进行计算。

🎯

关键要点

- 在Docker中使用GPU的步骤包括安装NVIDIA驱动和CUDA工具包。

- 安装NVIDIA驱动后,需要设置环境变量,包括将CUDA的bin和lib64路径添加到PATH和LD_LIBRARY_PATH中。

- 安装nvidia-container-toolkit以挂载GPU设备,并重启Docker服务。

- 通过--gpus参数启动容器,可以分配所有GPU或特定GPU给容器。

- 使用nvidia/cuda镜像时,无需在主机上安装CUDA。

❓

延伸问答

如何在Docker中安装NVIDIA驱动和CUDA工具包?

首先下载对应的NVIDIA驱动并运行安装文件,然后下载CUDA工具包并安装,确保将CUDA的bin和lib64路径添加到环境变量中。

在Docker中如何设置GPU环境变量?

需要将CUDA的bin路径添加到PATH中,将lib64路径添加到LD_LIBRARY_PATH中,具体命令为:export PATH=/usr/local/cuda-12.2/bin:$PATH 和 export LD_LIBRARY_PATH=/usr/local/cuda-12.2/lib64:$LD_LIBRARY_PATH。

如何安装nvidia-container-toolkit以挂载GPU设备?

可以通过运行命令安装nvidia-container-toolkit,并重启Docker服务以使更改生效。

如何使用--gpus参数启动Docker容器?

使用命令docker run --rm --gpus all nvidia/cuda:12.0.1-runtime-ubuntu22.04 nvidia-smi来启动容器,可以分配所有GPU或特定GPU。

使用nvidia/cuda镜像时需要在主机上安装CUDA吗?

不需要,使用nvidia/cuda镜像时,CUDA已经包含在镜像中,无需在主机上单独安装。

如何检查PyTorch的CUDA环境是否正常工作?

可以通过运行一个简单的Python程序,使用torch库检查CUDA设备是否可用,并输出CUDA版本和设备信息。

➡️