💡

原文英文,约1500词,阅读约需6分钟。

📝

内容提要

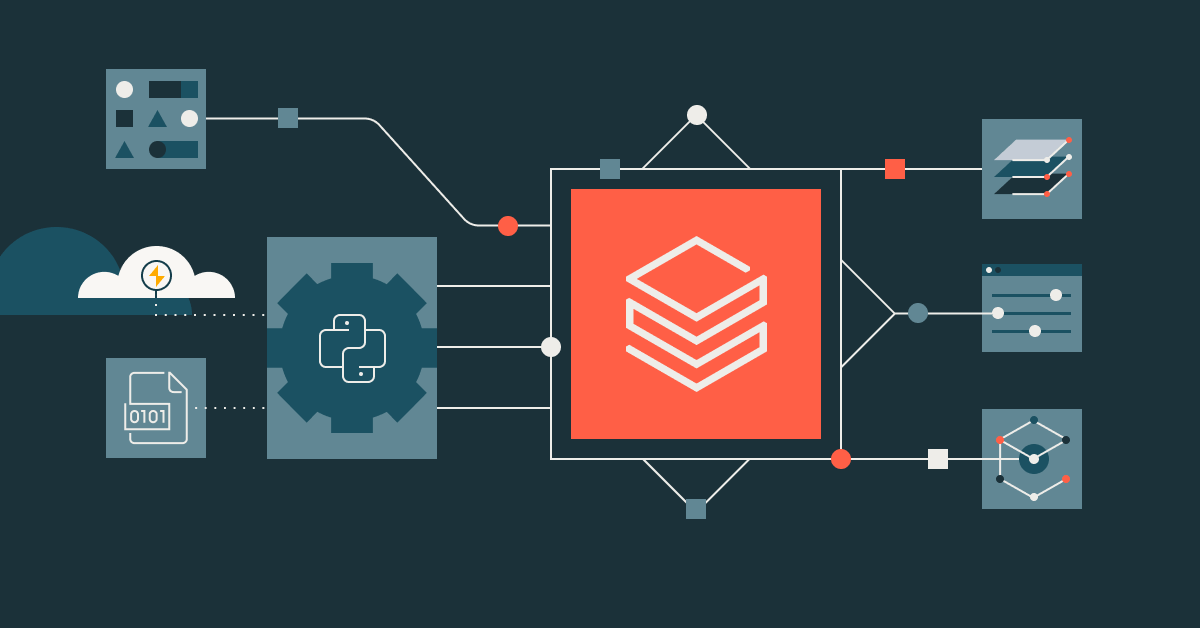

PySpark的Python数据源API已在Databricks Runtime 15.4 LTS及以上版本发布,允许开发者使用纯Python构建自定义数据连接器,简化外部数据源集成,支持批处理和流处理,提高数据处理效率。

🎯

关键要点

- PySpark的Python数据源API在Databricks Runtime 15.4 LTS及以上版本发布,允许使用纯Python构建自定义数据连接器。

- 该API简化了与外部和非Spark原生数据源的集成,支持批处理和流处理。

- Python数据源API使得开发者可以轻松构建自定义读取器和写入器,消除了对复杂DSv1和DSv2开发的需求。

- 该API支持批量和流式操作,允许处理多种数据访问模式。

- 用户可以通过Spark SQL轻松访问自定义Python数据源,并将其纳入SQL分析中。

- Python数据源API支持与外部服务的简化集成,用户可以通过DataFrame API传递自定义选项。

- 社区已经开始构建有价值的连接器,提供REST API、CSV变体等的参考实现。

- Python数据源API基于Apache Arrow构建,优化了数据处理速度。

- 自定义API集成可以直接从REST API读取数据到Spark DataFrame,省去中间存储步骤。

- 与Unity Catalog的集成确保数据资产的治理和安全性。

- 数据科学家可以直接连接到机器学习数据集,使用HuggingFace连接器获取数据。

- 支持流处理的自定义数据源可以持续摄取数据,适用于ETL管道。

- Declarative Pipeline集成允许用户轻松地将Python数据源与声明式管道结合使用。

- 构建自定义连接器的步骤包括确保使用Spark 4.0或Databricks Runtime 15.4 LTS及以上版本,使用实现模板,注册连接器,并使用连接器。

❓

延伸问答

Python数据源API的主要功能是什么?

Python数据源API允许开发者使用纯Python构建自定义数据连接器,简化与外部数据源的集成,支持批处理和流处理。

如何构建自定义连接器?

构建自定义连接器的步骤包括确保使用Spark 4.0或Databricks Runtime 15.4 LTS及以上版本,使用实现模板,注册连接器,并使用连接器。

Python数据源API支持哪些数据处理模式?

该API支持批处理和流处理,允许处理多种数据访问模式。

Python数据源API如何与Spark SQL集成?

用户可以通过Spark SQL轻松访问自定义Python数据源,并将其纳入SQL分析中。

Python数据源API的社区支持情况如何?

社区已经开始构建有价值的连接器,提供REST API、CSV变体等的参考实现。

Python数据源API的性能优势是什么?

该API基于Apache Arrow构建,优化了数据处理速度,减少了数据传输的开销。

🏷️

标签

➡️