💡

原文英文,约1800词,阅读约需7分钟。

📝

内容提要

麻省理工学院的研究人员开发了一种新型机器学习模型,能够同时处理音频和视觉数据,提升机器人与现实世界的互动能力。该模型通过优化视频帧与音频的对应关系,提高了视频检索和音视频场景分类的准确性,未来有望应用于新闻和电影制作等领域。

🎯

关键要点

- 麻省理工学院的研究人员开发了一种新型机器学习模型,能够同时处理音频和视觉数据,提升机器人与现实世界的互动能力。

- 该模型通过优化视频帧与音频的对应关系,提高了视频检索和音视频场景分类的准确性。

- 研究人员在训练过程中将音频分割成更小的窗口,以生成与每个音频窗口对应的独立表示。

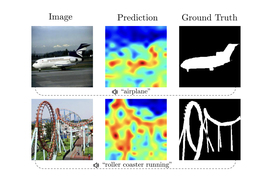

- 新模型CAV-MAE Sync能够在没有人工标签的情况下对视频片段中的音频和视觉数据进行对齐。

- 该模型的改进使其在基于音频查询检索视频和预测音视频场景类别方面表现更为准确。

- 未来,该技术有望应用于新闻和电影制作等领域,帮助自动化多模态内容的策划。

❓

延伸问答

CAV-MAE Sync模型的主要功能是什么?

CAV-MAE Sync模型能够在没有人工标签的情况下对视频片段中的音频和视觉数据进行对齐,提升视频检索和音视频场景分类的准确性。

该研究如何提高机器学习模型的性能?

研究通过优化视频帧与音频的对应关系和引入新的数据表示,改善了模型在音频查询检索视频和预测音视频场景类别方面的表现。

CAV-MAE Sync模型与之前的模型有什么不同?

CAV-MAE Sync模型通过将音频分割成更小的窗口,生成独立的表示,从而实现更精细的音频与视频帧的对应关系。

该技术未来可能应用于哪些领域?

该技术有望应用于新闻和电影制作等领域,帮助自动化多模态内容的策划。

研究人员如何训练CAV-MAE Sync模型?

研究人员通过将音频分割成小窗口,并在训练过程中学习每个视频帧与相应音频的关系来训练模型。

CAV-MAE Sync模型的创新之处在哪里?

模型的创新在于引入了对比目标和重建目标,使其能够更独立地处理音频和视觉数据,从而提升整体性能。

➡️