💡

原文中文,约5100字,阅读约需12分钟。

📝

内容提要

本文讨论了使用Azure OpenAI服务的代理实现,推荐使用Python的Sanic框架而非Blacksheep。通过代码示例展示了如何处理非流式和流式请求,并指出Blacksheep在处理SSE时的局限性。最后建议根据需求扩展功能,如配置文件和内容审查。

🎯

关键要点

- Azure OpenAI服务与OpenAI服务基本一致,主要区别在于请求路径和更新速度。

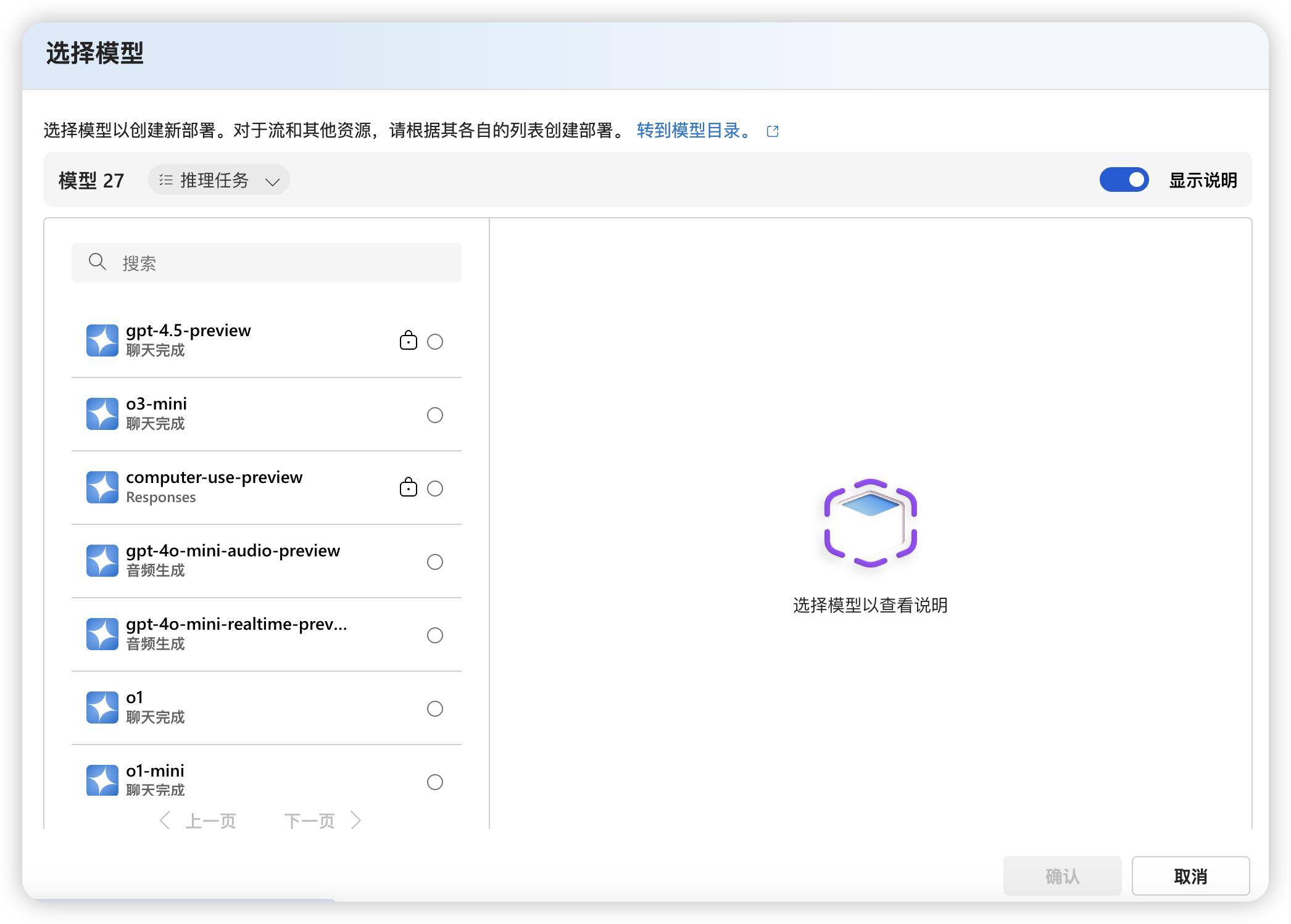

- 在Azure AI Foundry中创建部署,部署名称是请求URL的一部分。

- 建议使用Python的Sanic框架而非Blacksheep,因其文档好、语法相似且支持asyncio。

- 非流式请求可以使用httpx直接发请求并返回响应,代码实现简单。

- 流式请求使用httpx的stream方法,需注意处理错误响应。

- 可以根据需求扩展功能,如配置文件、内容审查和选择最佳区域。

- Blacksheep在处理SSE时存在局限性,无法正确返回特定格式的响应。

- 使用Blacksheep时,异步生成器的限制导致无法灵活处理错误响应。

- 建议避免使用Blacksheep,以免遇到不必要的麻烦。

❓

延伸问答

如何使用Python实现Azure OpenAI的代理服务?

可以使用Sanic框架和httpx库,通过编写简单的代码来处理非流式和流式请求。

为什么推荐使用Sanic而不是Blacksheep?

Sanic文档完善,语法类似Flask,并且原生支持asyncio,避免了Blacksheep在处理SSE时的局限性。

在Azure OpenAI中如何创建部署?

需要在Azure AI Foundry中创建部署,部署名称将作为请求URL的一部分。

流式请求和非流式请求的处理有什么不同?

非流式请求使用httpx直接发送请求并返回响应,而流式请求需要使用httpx的stream方法并处理错误响应。

如何扩展Azure OpenAI代理服务的功能?

可以通过创建配置文件、内容审查和选择最佳区域等方式来扩展功能。

Blacksheep在处理SSE时存在哪些问题?

Blacksheep无法正确返回特定格式的响应,且异步生成器的限制导致无法灵活处理错误响应。

➡️