💡

原文中文,约6000字,阅读约需15分钟。

📝

内容提要

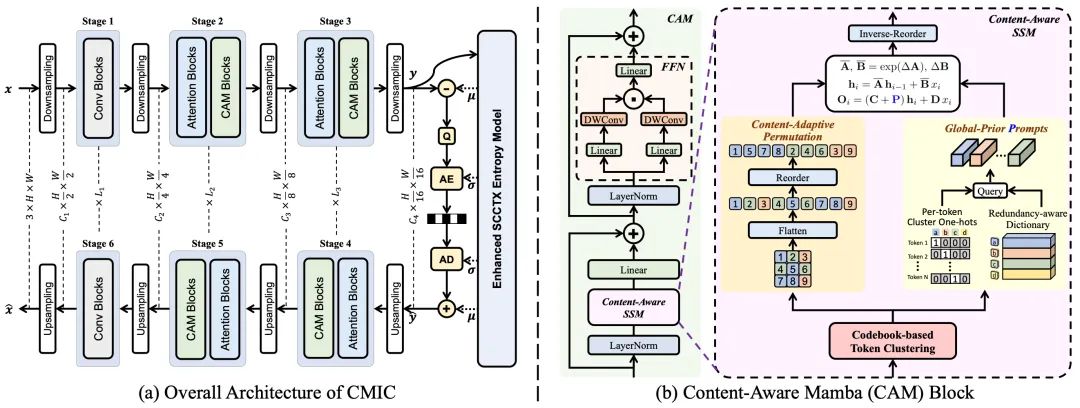

本文提出了一种动态状态空间模型Content-Aware Mamba(CAM),并基于此构建了图像压缩模型CMIC。CMIC通过内容自适应token重排和全局先验提示,增强了长距离冗余建模能力,在多个数据集上实现了SOTA性能。

🎯

关键要点

- 提出了一种动态状态空间模型Content-Aware Mamba(CAM)

- 基于CAM构建了图像压缩模型CMIC

- CMIC通过内容自适应token重排和全局先验提示增强长距离冗余建模能力

- CMIC在Kodak、Tecnick和CLIC数据集上实现了SOTA性能

- 标准Mamba在图像压缩中存在固定raster scan和严格因果建模的瓶颈

- CMIC引入内容自适应token重排(CTP)以优化扫描顺序

- CMIC使用全局先验提示(GPP)来缓解严格因果约束

- CMIC的设计兼顾局部细节和全局压缩效率

- CMIC在多个数据集上相对VTM-21.0取得显著的码率节省

- CMIC的参数量和计算复杂度相对较低,具有较高的效率

- CMIC通过有效感受野(ERF)展示了对冗余分布的感知能力

- CMIC的核心在于优化扫描顺序和信息流方式以提升图像压缩性能

❓

延伸问答

CMIC模型的核心创新是什么?

CMIC模型的核心创新在于引入了内容自适应token重排和全局先验提示,以优化扫描顺序和信息流,从而提升图像压缩性能。

CMIC在图像压缩中相较于标准Mamba有哪些优势?

CMIC相较于标准Mamba,能够更有效地建模长距离冗余,避免了固定的raster scan和严格因果建模的瓶颈,提升了压缩效率。

CMIC在Kodak、Tecnick和CLIC数据集上的表现如何?

CMIC在Kodak、Tecnick和CLIC数据集上分别实现了15.91%、21.34%和17.58%的码率节省,达到了SOTA性能。

什么是内容自适应token重排(CTP)?

内容自适应token重排(CTP)是CMIC中的一个模块,它将相似内容的token聚集在一起,以优化扫描顺序,提高冗余建模能力。

全局先验提示(GPP)在CMIC中起什么作用?

全局先验提示(GPP)在CMIC中用于注入样本级的全局统计信息,帮助模型在扫描过程中打破严格的因果约束,提升信息流的有效性。

CMIC的计算复杂度和参数量如何?

CMIC的参数量为69.11M,FLOPs为2.39T,解码延迟约为0.405秒,峰值显存约为4.44GB,显示出较高的效率。

➡️