内容提要

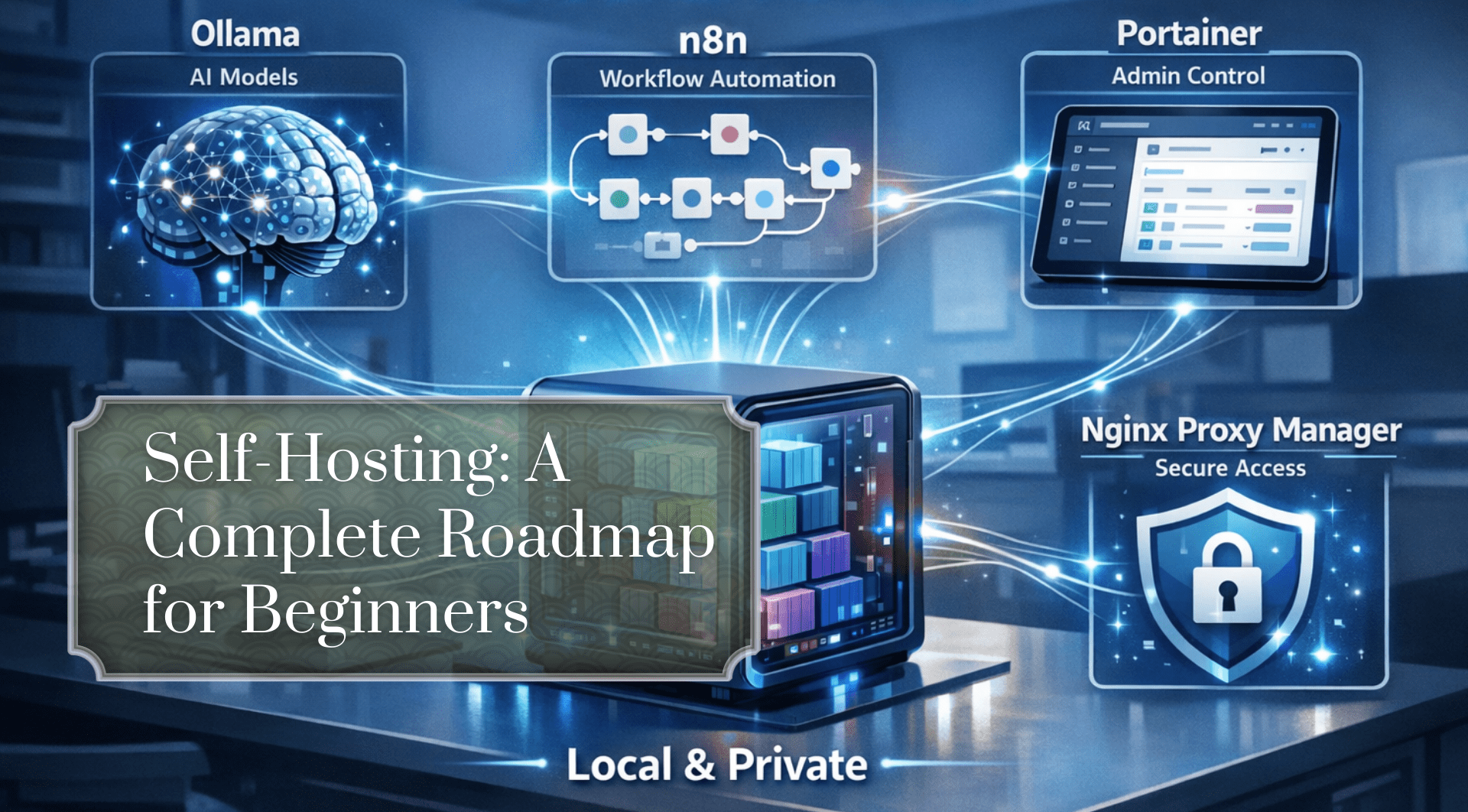

本文介绍如何在本地使用Docker、Ollama和n8n构建私有AI中心。通过自托管,用户可以自动化任务、处理私密数据,避免云服务费用。文章详细说明了安装步骤及创建自动化工作流,以确保数据隐私和安全。

关键要点

-

本文介绍如何在本地使用Docker、Ollama和n8n构建私有AI中心。

-

自托管可以自动化任务、处理私密数据,避免云服务费用。

-

使用Docker打包软件,Ollama运行本地机器学习模型,n8n创建可视化自动化。

-

本地AI中心的优势包括数据隐私、成本效益和完全自定义。

-

核心组件包括Docker/Portainer、Ollama、n8n和Nginx Proxy Manager。

-

准备服务器时,建议使用Ubuntu Server LTS或类似Linux发行版。

-

安装Docker和Docker Compose是关键步骤,确保可以管理多个容器。

-

使用Portainer提供图形用户界面,简化Docker管理。

-

Ollama作为本地AI引擎,支持运行开源大型语言模型。

-

n8n是可视化工作流自动化工具,可以创建智能自动化流程。

-

使用Nginx Proxy Manager为不同服务提供安全访问和路由。

-

完成后,用户可以扩展Ollama,实验不同模型,或连接外部API。

-

此设置将普通硬件转变为强大的私有数字大脑,用户控制软件和数据。

延伸问答

如何在本地构建私有AI中心?

可以使用Docker、Ollama和n8n等工具,通过安装和配置这些软件来构建私有AI中心。

自托管AI的优势是什么?

自托管AI可以确保数据隐私、降低成本,并提供完全的自定义能力。

Docker在私有AI中心中起什么作用?

Docker用于将软件打包成独立的容器,简化管理和部署过程。

Ollama是什么,它如何工作?

Ollama是一个本地大型语言模型服务器,可以运行开源模型并提供API供其他工具使用。

如何使用n8n创建自动化工作流?

可以通过拖放节点在n8n中创建工作流,例如将Ollama生成的文本发送到笔记应用。

如何确保私有AI中心的安全性?

可以使用Nginx Proxy Manager为不同服务提供安全访问和SSL加密,确保数据安全。