💡

原文英文,约1800词,阅读约需7分钟。

📝

内容提要

本文比较了四种增强大型语言模型(LLM)可靠性的方法:RAG、SKILL、MCP和RLM。RAG通过外部知识库动态注入信息,适合静态知识查询;SKILL根据上下文加载所需能力,适合复杂任务;MCP标准化LLM与外部系统的交互,适用于复杂环境;RLM通过递归方法处理长提示,绕过上下文窗口限制。每种方法都有其优缺点和适用场景。

🎯

关键要点

- RAG(检索增强生成)通过外部知识库动态注入信息,适合静态知识查询。

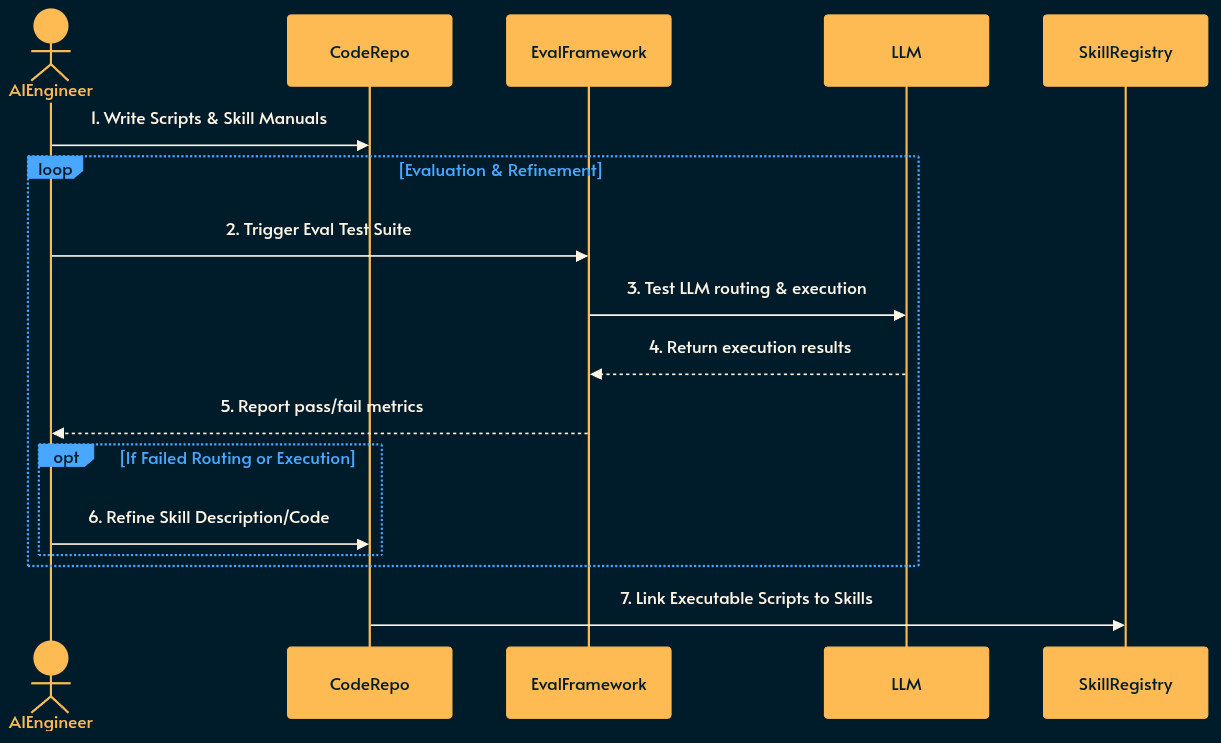

- SKILL(动态能力加载)根据上下文加载所需能力,适合复杂任务,减少了对嵌入模型的依赖。

- MCP(模型上下文协议)标准化LLM与外部系统的交互,适用于复杂环境,提供了可重用的提示和工具。

- RLM(递归语言模型)通过递归方法处理长提示,绕过上下文窗口限制,适合处理长文本。

❓

延伸问答

RAG方法的主要优点是什么?

RAG的主要优点是概念简单,能够严格限制LLM的输出在提供的事实范围内,减少幻觉现象,并且不需要对模型进行微调。

SKILL方法适合什么样的任务?

SKILL方法适合需要动态加载能力的复杂任务,特别是在处理数学或确定性逻辑时表现优秀。

MCP的主要功能是什么?

MCP的主要功能是标准化LLM与外部系统的交互,提供可重用的提示、工具和资源。

RLM如何处理长提示?

RLM通过递归方法将长提示视为外部环境变量,从而绕过LLM的上下文窗口限制。

使用RAG时需要注意哪些事项?

使用RAG时需要确保嵌入模型和分块策略的质量,因为词汇或语义不匹配可能导致检索失败。

SKILL与RAG的主要区别是什么?

SKILL允许LLM根据上下文动态加载所需能力,而RAG则是通过外部知识库静态注入信息。

➡️