内容提要

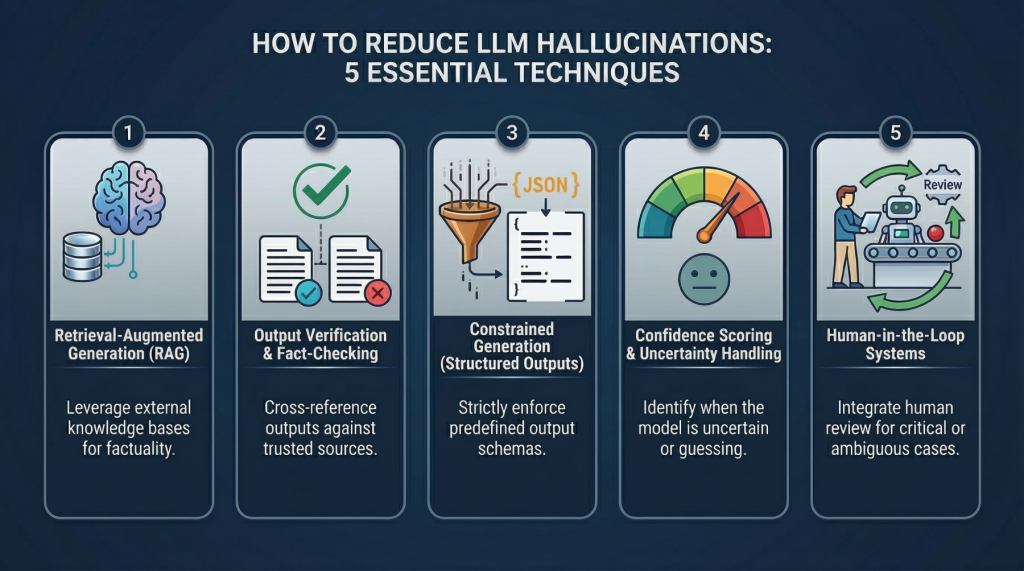

大型语言模型(LLM)产生幻觉的原因包括缺乏实时数据、过度概括和生成压力。为减少幻觉,可以采用五种技术:1. 检索增强生成(RAG),提供实时数据;2. 输出验证,使用二次模型检查答案;3. 结构化输出,限制模型生成自由度;4. 置信评分,评估答案可靠性;5. 人工干预,确保关键决策由人类审核。这些方法能有效降低幻觉的发生。

关键要点

-

大型语言模型(LLM)产生幻觉的原因包括缺乏实时数据、过度概括和生成压力。

-

为减少幻觉,可以采用五种技术:1. 检索增强生成(RAG),提供实时数据;2. 输出验证,使用二次模型检查答案;3. 结构化输出,限制模型生成自由度;4. 置信评分,评估答案可靠性;5. 人工干预,确保关键决策由人类审核。

-

检索增强生成(RAG)通过提供外部数据来减少幻觉,模型生成的答案基于检索到的信息,而不是仅依赖内部记忆。

-

输出验证和事实检查层通过引入额外的验证步骤,确保生成的答案经过检查和验证,降低错误的可能性。

-

结构化输出通过限制模型的回答格式,减少了生成错误信息的可能性。

-

置信评分和不确定性处理通过评估模型答案的可靠性,帮助识别可能的错误。

-

人机协作系统在关键决策中引入人类审核,确保在高风险情况下的输出得到适当的检查。

延伸问答

大型语言模型产生幻觉的主要原因是什么?

主要原因包括缺乏实时数据、过度概括和生成压力。

如何通过检索增强生成技术减少幻觉?

检索增强生成(RAG)通过提供实时数据,允许模型基于外部信息生成答案,从而减少幻觉。

输出验证和事实检查层的作用是什么?

它们通过引入额外的验证步骤,确保生成的答案经过检查和验证,从而降低错误的可能性。

什么是结构化输出,它如何帮助减少幻觉?

结构化输出通过限制模型的回答格式,减少了生成错误信息的可能性。

置信评分在减少幻觉中起什么作用?

置信评分通过评估模型答案的可靠性,帮助识别可能的错误,从而降低幻觉的风险。

人机协作系统如何确保关键决策的准确性?

人机协作系统通过确保关键决策由人类审核,降低了高风险情况下的错误输出。