💡

原文中文,约8500字,阅读约需21分钟。

📝

内容提要

本文综述了自然语言处理中提示学习的应用及相关研究,包括获取离散和连续提示语的方式、预训练+提示学习和样本级/统一提示学习的方法、以及在少样本学习中的应用。同时,文章提出了开放性问题,如数据对模型训练的影响、能力涌现的原因、大模型能力蒸馏等。相关研究包括Proximal policy optimization algorithms、Informed Machine Learning、Prefix-tuning、Finetuned language models are zero-shot learners、Training language models to follow instructions with human feedback、Instance-aware prompt learning和Unified prompt learning等。

🎯

关键要点

- 提示学习在自然语言处理中的应用及研究综述。

- ChatGPT是一个通用语言处理平台,具有意图理解、对话能力、交互修正和逻辑推理等关键能力。

- ChatGPT的技术组成包括生成式解码器、指令学习和基于人类反馈的强化学习。

- 预训练大模型的两种方向为预训练+参数微调和预训练+提示学习。

- 预训练+参数微调适合特定任务,但通用性较弱,资源占用高。

- 预训练+提示学习通过提示语激活模型,适应多种下游任务。

- 提示语是预训练+提示学习中的重要元素,分为离散和连续两种形式。

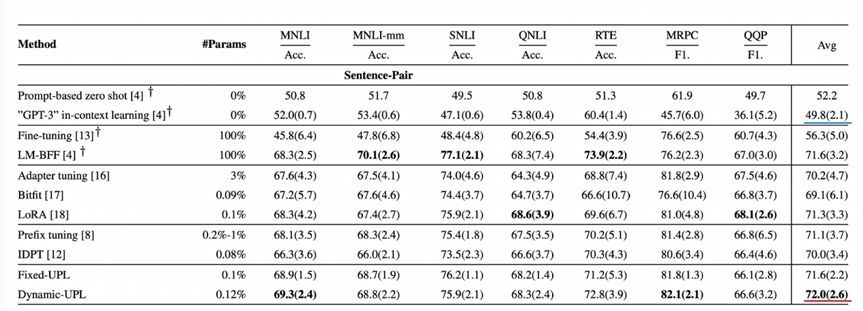

- 样本级提示学习方法为每个样本学习最合适的提示语,统一提示学习方法结合任务和样本信息。

- 实验结果表明,统一提示学习方法在少样本学习中表现优异。

- 开放性问题包括数据对模型训练的影响、能力涌现的原因和大模型能力的蒸馏等。

➡️