💡

原文中文,约6700字,阅读约需16分钟。

📝

内容提要

微软提出了一种新的文本编码方法,通过分别计算文本的语义编码和位置编码来优化注意力机制。在实现DeBERTa时,使用Paddle框架面临复杂的disentangled attention问题。研究发现,在layer normalization后添加扰动可以提高模型的鲁棒性。

🎯

关键要点

- 微软提出了一种新的文本编码方法,通过分别计算文本的语义编码和位置编码来优化注意力机制。

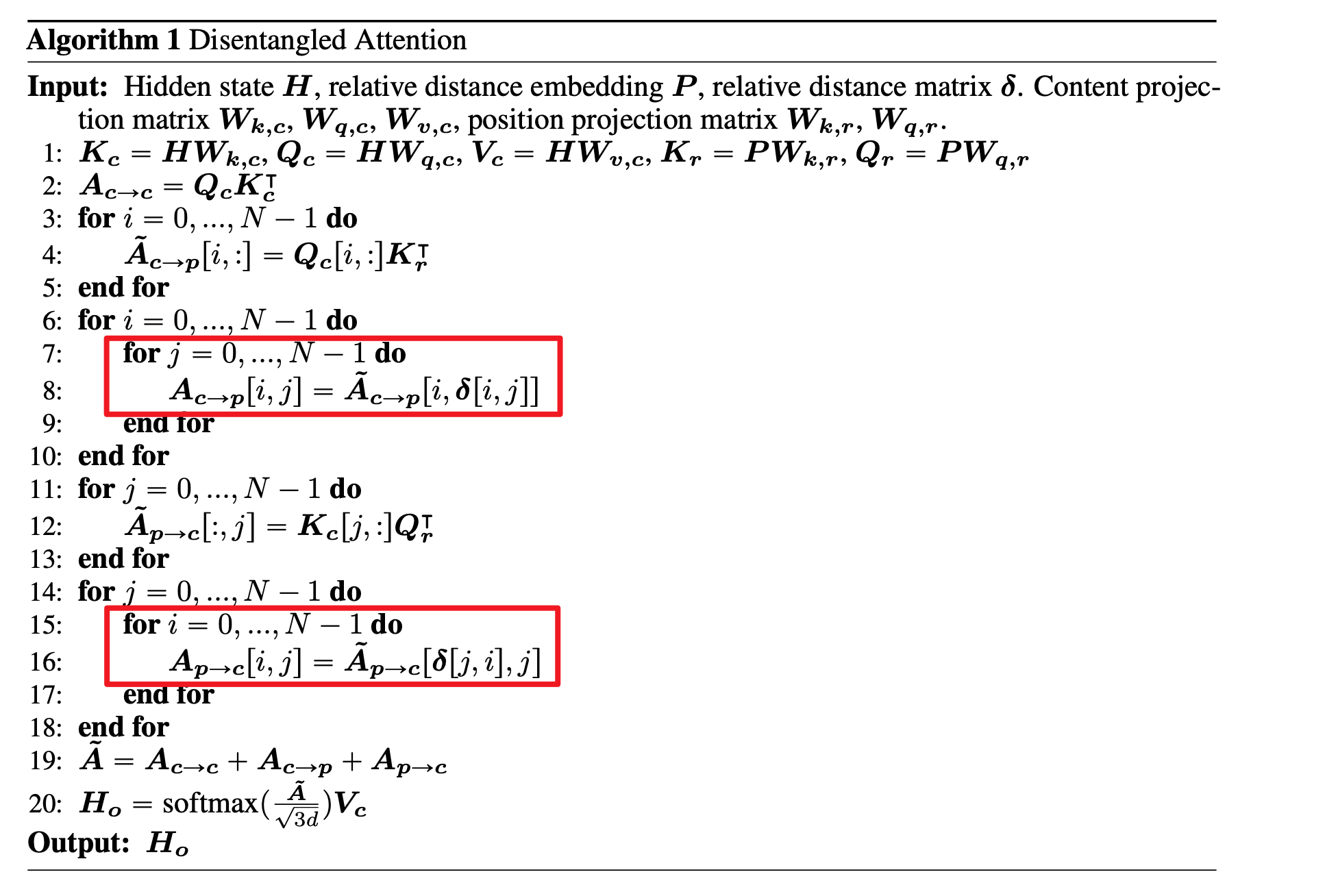

- 在实现DeBERTa时,使用Paddle框架面临复杂的disentangled attention问题。

- 研究发现,在layer normalization后添加扰动可以提高模型的鲁棒性。

❓

延伸问答

DeBERTa的主要创新点是什么?

DeBERTa通过分别计算文本的语义编码和位置编码来优化注意力机制。

在实现DeBERTa时遇到了哪些技术挑战?

实现DeBERTa时,使用Paddle框架面临复杂的disentangled attention问题。

如何提高DeBERTa模型的鲁棒性?

研究发现,在layer normalization后添加扰动可以提高模型的鲁棒性。

DeBERTa的注意力机制与传统方法有什么不同?

DeBERTa的注意力机制通过分开计算语义和位置编码,优化了传统的计算方式。

在使用Paddle实现DeBERTa时,有哪些具体的实现步骤?

实现步骤包括处理QKV的重塑和转置,以及多头注意力的计算。

DeBERTa在训练过程中如何处理大数据集?

可以逐行读入数据集,使用缓存池来管理数据。

➡️