大模型架构的下半场

量子位

·

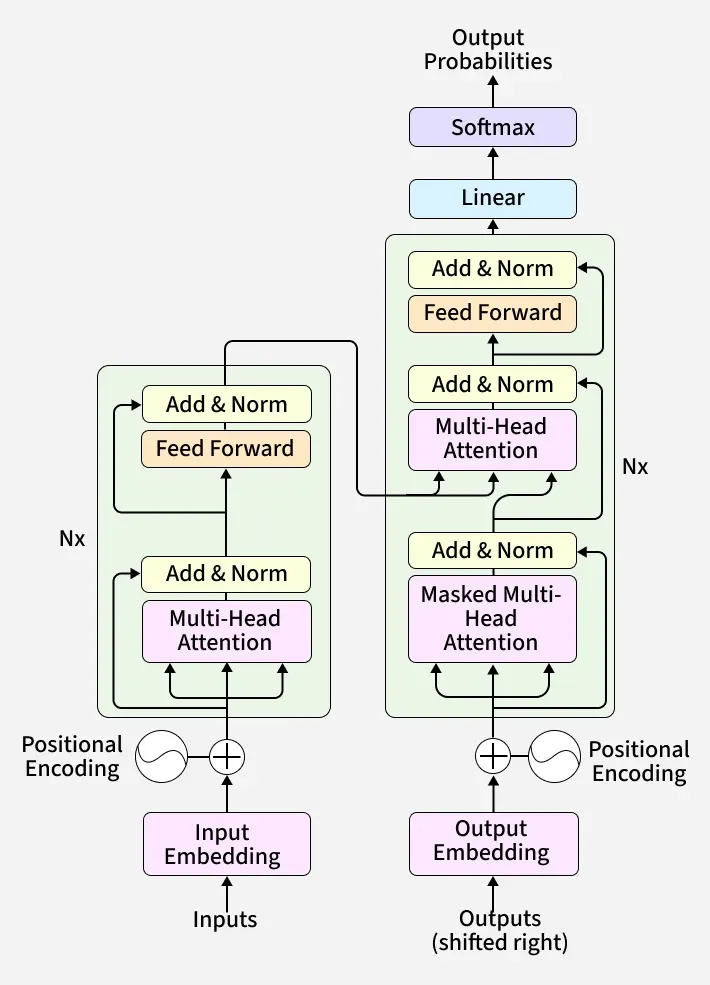

从递归神经网络到变换器

Louis Aeilot's Blog

·

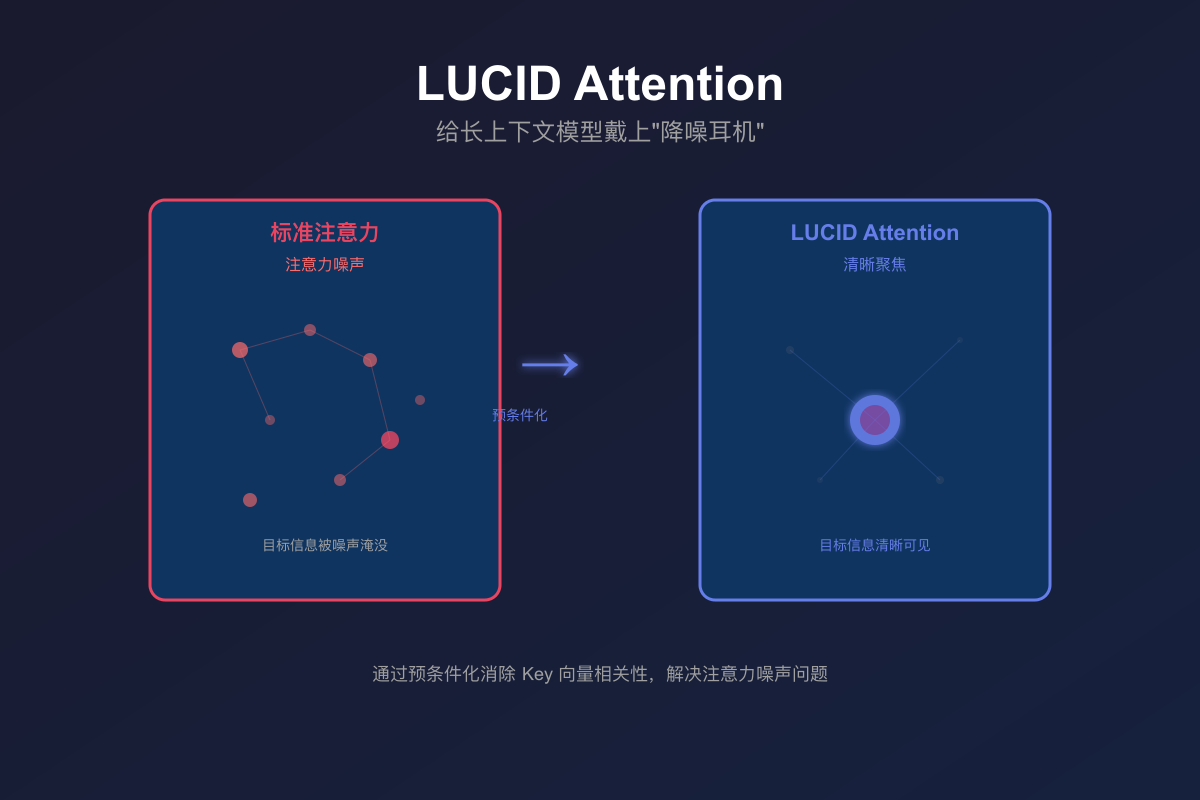

LUCID Attention:给长上下文模型戴上降噪耳机

Micropaper

·

Google Titans + MIRAS:终结 AI 健忘症,让模型拥有真正的长期记忆

Micropaper

·

2025年及以后:人工智能创新

InfoQ

·

nanobot-gpt

plus studio

·

推理的物理学 – 深入探讨KV缓存和提示缓存

Shadow Walker 松烟阁

·

小猫都能懂的大模型原理 4 - 大语言模型架构

UsubeniFantasy

·

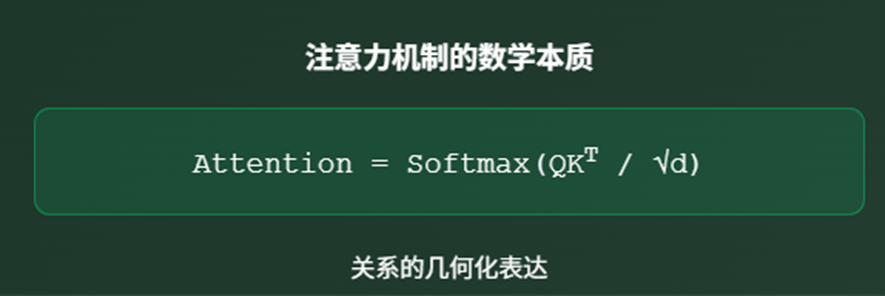

如果你这篇注意力机制的文章都看不懂,就...可以重新读小学了

dotNET跨平台

·

使用PyTorch从零开始构建变换器模型(10天迷你课程)

MachineLearningMastery.com

·

大型语言模型的历史

De Moivre–Laplace Theorem

·