💡

原文英文,约1900词,阅读约需7分钟。

📝

内容提要

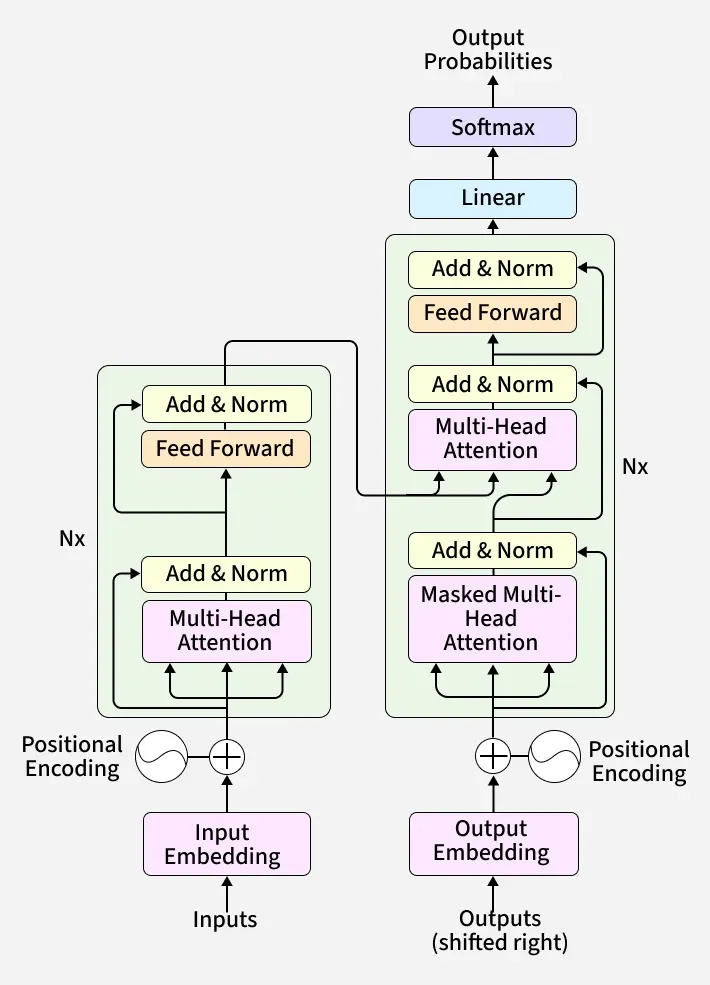

自然语言处理经历了巨大的演变,传统的序列到序列模型依赖递归神经网络(RNN),但在处理长序列时存在信息瓶颈。为了解决这一问题,引入了注意力机制,使解码器能够动态关注输入序列的不同部分。现代的Transformer模型通过堆叠注意力层,能够高效处理复杂的序列数据,广泛应用于文本生成和图像处理等领域。

🎯

关键要点

- 自然语言处理经历了巨大的演变,传统的序列到序列模型依赖递归神经网络(RNN)。

- 传统的Seq2Seq模型由编码器RNN和解码器RNN组成,编码器处理输入序列并生成隐藏状态,解码器逐步生成输出序列。

- 在处理长输入序列时,固定大小的上下文向量难以捕捉所有相关细节,导致信息丢失。

- 为了解决上下文瓶颈,引入了注意力机制,使解码器能够动态关注输入序列的不同部分。

- 注意力机制的关键优势包括动态聚焦、无固定瓶颈和完全可微分性。

- 现代Transformer模型通过堆叠注意力层,能够高效处理复杂的序列数据,广泛应用于文本生成和图像处理等领域。

- Transformer模型的架构允许并行处理,显著提高了计算效率。

- 现代Transformer模型在架构上进行了多项改进,如预归一化、RMSNorm和SwiGLU激活函数,以提高训练稳定性和性能。

- 混合专家(MoE)架构通过稀疏激活技术,允许模型在不显著增加计算成本的情况下扩展参数数量。

❓

延伸问答

递归神经网络(RNN)在自然语言处理中的作用是什么?

递归神经网络(RNN)用于传统的序列到序列模型,负责处理输入序列并生成隐藏状态,帮助生成输出序列。

注意力机制是如何解决上下文瓶颈问题的?

注意力机制允许解码器在每个解码步骤动态关注输入序列的不同部分,从而避免依赖单一的固定上下文向量,减少信息丢失。

现代Transformer模型相比于传统RNN有什么优势?

现代Transformer模型通过堆叠注意力层实现高效的并行处理,显著提高计算效率,并能处理复杂的序列数据。

Transformer模型的架构有哪些关键改进?

现代Transformer模型引入了预归一化、RMSNorm和SwiGLU激活函数等改进,以提高训练稳定性和性能。

混合专家(MoE)架构的主要优势是什么?

混合专家架构通过稀疏激活技术,允许模型在不显著增加计算成本的情况下扩展参数数量,从而提高模型的能力和效率。

Transformer模型在图像处理中的应用是什么?

Transformer模型可以用于图像处理,通过将图像分割为固定大小的补丁并使用自注意力机制来理解全局上下文。

➡️