ParaRNN:大规模非线性递归神经网络,可并行训练

Apple Machine Learning Research

·

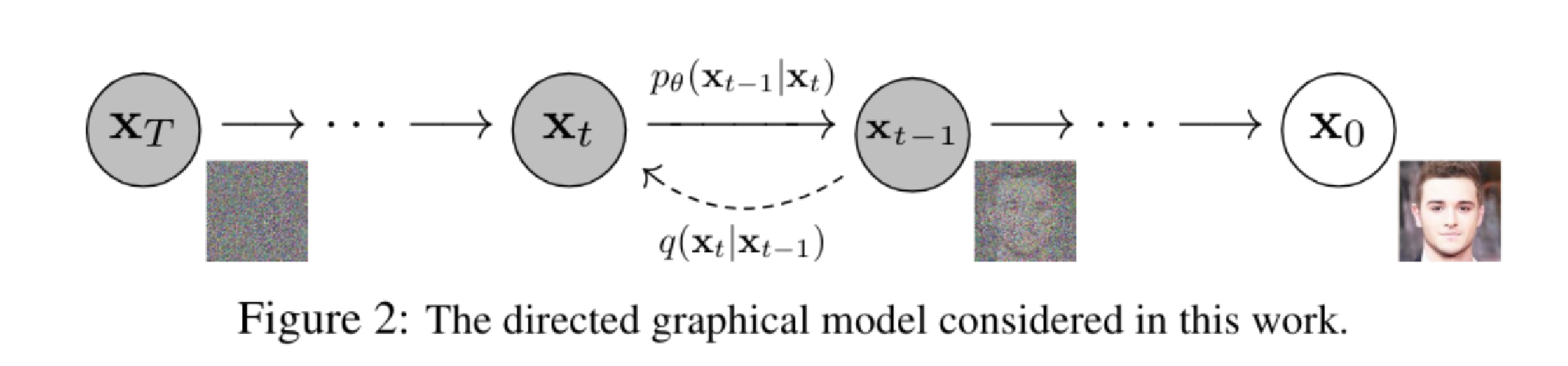

DDPM笔记

plus studio

·

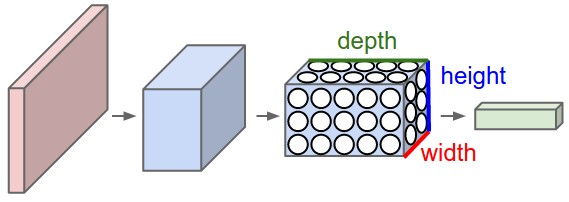

CS231n 讲义 V:卷积神经网络基础

Louis Aeilot's Blog

·

解决简街的“掉落的神经网络”难题

Yi's blog

·

U-Net 解析:初学者的视觉指南

Yi's blog

·

提升你的机器学习技能:安德鲁·吴课程后的行动指南

MachineLearningMastery.com

·

![[实验性] 有开发者破解苹果ANE神经网络引擎 原来M4芯片也能直接训练小模型](https://img.lancdn.com/landian/2026/03/111996.png)