💡

原文中文,约1300字,阅读约需4分钟。

📝

内容提要

本文通过图书馆找书的例子解释了注意力机制:用户提出查询(Q),匹配书籍标签(K),进行快速评分(QKᵀ),调整分数(/√d),最后通过Softmax确定关注重点。该机制也应用于人工智能的语言理解。

🎯

关键要点

- 注意力机制通过图书馆找书的例子进行解释。

- 第一步是提出查询(Q),例如寻找关于红烧肉的书。

- 第二步是识别书籍标签(K),如书名和简介。

- 第三步是快速匹配(QKᵀ),评估书籍与查询的相关性。

- 第四步是调整分数(/√d),避免极端评分影响判断。

- 第五步是通过Softmax确定关注重点,分配注意力比例。

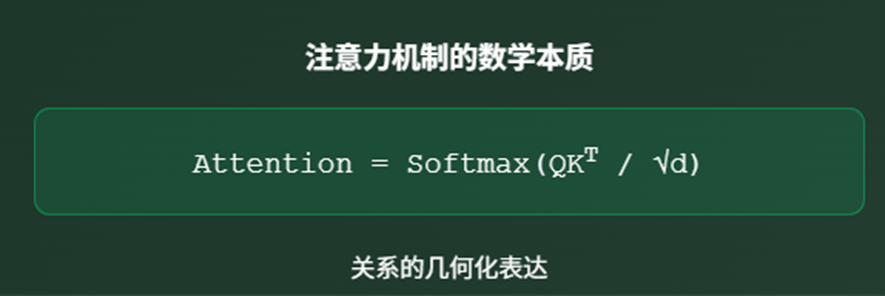

- 总结公式为Attention = Softmax(QKᵀ / √d),用于信息筛选和理解。

- 人工智能在语言理解中也应用了类似的注意力机制。

❓

延伸问答

注意力机制的基本步骤是什么?

注意力机制的基本步骤包括提出查询(Q)、识别书籍标签(K)、快速匹配(QKᵀ)、调整分数(/√d)和通过Softmax确定关注重点。

如何通过图书馆找书的例子理解注意力机制?

通过图书馆找书的例子,用户首先提出查询,接着识别书籍标签,然后快速匹配相关性,调整评分,最后通过Softmax确定关注的书籍。

Softmax在注意力机制中起什么作用?

Softmax在注意力机制中用于将所有评分转换为百分比,以确定用户应该将注意力重点放在哪些信息上。

注意力机制如何避免极端评分影响判断?

注意力机制通过调整分数(/√d)来避免极端评分影响判断,使得评分更加合理和稳定。

注意力机制在人工智能中有什么应用?

注意力机制在人工智能中被应用于语言理解,例如ChatGPT会根据句子中的词语判断注意力的分配。

注意力机制的公式是什么?

注意力机制的公式为Attention = Softmax(QKᵀ / √d),用于信息筛选和理解。

➡️