💡

原文英文,约800词,阅读约需3分钟。

📝

内容提要

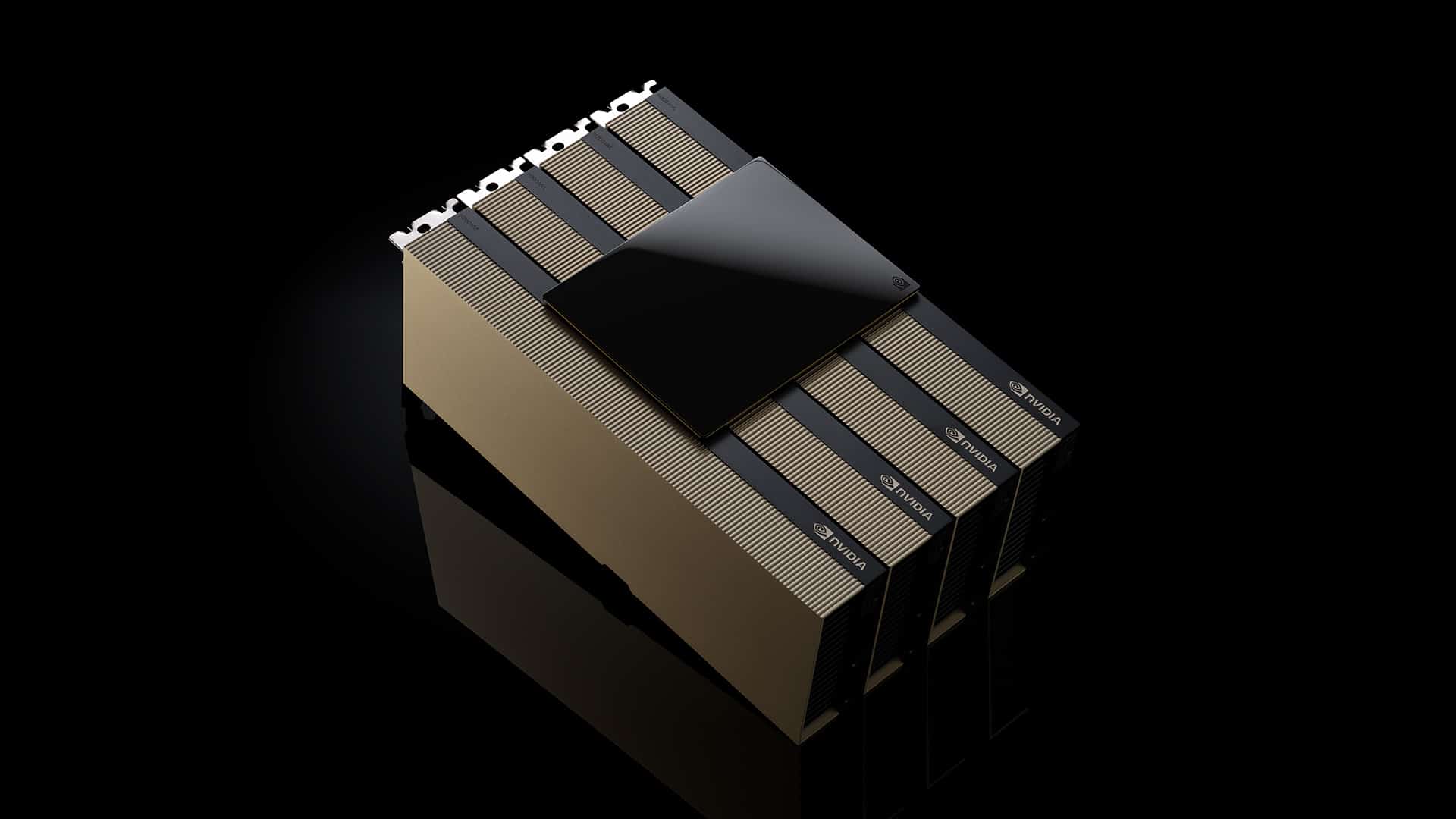

NVIDIA H200 NVL专为低功耗、空气冷却的企业机架设计,提升了语言模型推理和高性能计算的效率,支持灵活配置,适应多种工作负载。结合NVIDIA NVLink技术,显著提高GPU间通信速度,广泛应用于多个行业。多家企业和高校正在利用H200 NVL加速AI和HPC项目。

🎯

关键要点

- NVIDIA H200 NVL专为低功耗、空气冷却的企业机架设计,提升语言模型推理速度1.7倍,HPC应用性能提升1.3倍。

- NVIDIA Hopper架构改变了AI和高性能计算的格局,提高了性能和能效。

- H200 NVL适合数据中心,支持灵活配置,能够加速各种AI和HPC工作负载。

- 大约70%的企业机架功率在20kW以下,使用空气冷却,PCIe GPU在此环境中至关重要。

- H200 NVL在内存和带宽上相较于H100 NVL分别提升1.5倍和1.2倍,支持更快的推理性能。

- NVIDIA NVLink技术提供GPU间通信速度比第五代PCIe快7倍,满足HPC和大语言模型推理需求。

- H200 NVL配备强大的软件工具,包含五年NVIDIA AI Enterprise订阅,支持AI应用的开发和部署。

- 多家企业和高校正在利用H200 NVL加速AI和HPC项目,包括Dropbox和新墨西哥大学。

- H200 NVL将通过Dell、Hewlett Packard Enterprise、Lenovo等多家合作伙伴提供多种配置。

- NVIDIA还将开发H200 NVL系统的企业参考架构,提供硬件和软件的全栈建议,优化网络性能。

❓

延伸问答

NVIDIA H200 NVL的主要特点是什么?

NVIDIA H200 NVL专为低功耗、空气冷却的企业机架设计,提升语言模型推理速度1.7倍,HPC应用性能提升1.3倍。

H200 NVL如何提高AI和HPC应用的能效?

H200 NVL通过降低功耗和提升内存及带宽,帮助企业在加速AI和HPC应用的同时提高能效。

NVIDIA NVLink技术对H200 NVL有什么影响?

NVIDIA NVLink技术提供GPU间通信速度比第五代PCIe快7倍,显著提升HPC和大语言模型推理的性能。

H200 NVL适合哪些行业应用?

H200 NVL广泛应用于多个行业,包括金融的交易算法、医疗成像、制造业的模式识别等。

H200 NVL的配置和可用性如何?

H200 NVL将通过Dell、Hewlett Packard Enterprise、Lenovo等多家合作伙伴提供多种配置,预计在12月开始上市。

H200 NVL如何支持AI应用的开发和部署?

H200 NVL配备五年NVIDIA AI Enterprise订阅,提供开发和部署AI应用所需的强大软件工具。

➡️