内容提要

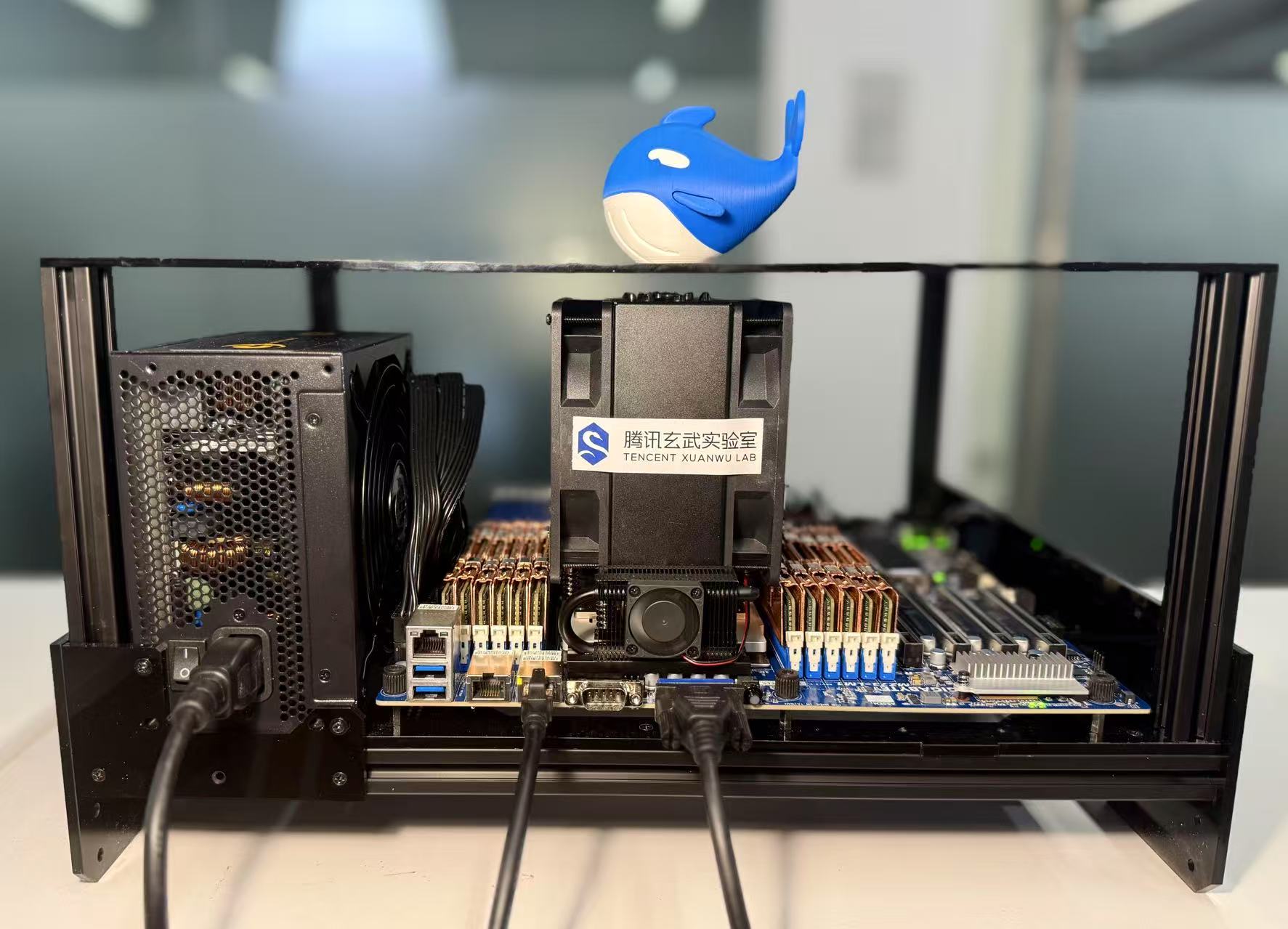

私有化部署大模型可有效保护数据隐私,本文探讨DeepSeek大模型的纯CPU部署,成本约3.8万元,使用llama.cpp框架,q8精度下实现7.17 tokens/s的输出速度。通过散热改进和系统优化,长文本生成速度提升约25%。文章包括装机选型、软硬件配置和性能测试三部分,提供详细配置建议和测试结果。

关键要点

-

私有化部署大模型可有效保护数据隐私,便于安全研究和知识蒸馏。

-

DeepSeek大模型的纯CPU部署成本约3.8万元,使用llama.cpp框架,q8精度下实现7.17 tokens/s的输出速度。

-

通过散热改进和系统优化,长文本生成速度提升约25%。

-

文章分为装机选型、软硬件配置和性能测试三部分,提供详细配置建议和测试结果。

-

DeepSeek R1模型采用高稀疏度的MoE结构,实际推理时仅激活部分专家,降低计算资源需求。

-

q8量化性能与原版fp8相近,优于q4,推荐使用q8精度以优化推理性能。

-

玄武装机方案成本显著低于纯GPU方案,适合单并发场景。

-

装机选型建议优先考虑内存带宽、CPU核心数和SSD读写速度。

-

散热优化对内存性能至关重要,避免内存过热导致降频。

-

性能测试显示q8和q4在生成速度和困惑度上存在差异,q8在某些场景下表现更优。

-

文章总结了对DeepSeek大模型的实践经验,并展望未来的性能优化方向。

延伸问答

DeepSeek大模型的纯CPU部署有什么优势?

私有化部署大模型能够有效保护数据隐私,便于安全研究和知识蒸馏。

DeepSeek大模型的部署成本是多少?

DeepSeek大模型的纯CPU部署成本约为3.8万元。

使用q8精度的DeepSeek模型在性能上有什么表现?

在q8精度下,DeepSeek模型实现了7.17 tokens/s的输出速度。

如何优化DeepSeek模型的长文本生成速度?

通过散热改进和系统优化,长文本生成速度提升约25%。

DeepSeek模型的硬件选型有哪些建议?

建议优先考虑内存带宽、CPU核心数和SSD读写速度。

q8量化与q4量化在性能上有什么区别?

q8量化的性能与原版fp8相差无几,而在实际推理性能上q8优于q4。