💡

原文中文,约5700字,阅读约需14分钟。

📝

内容提要

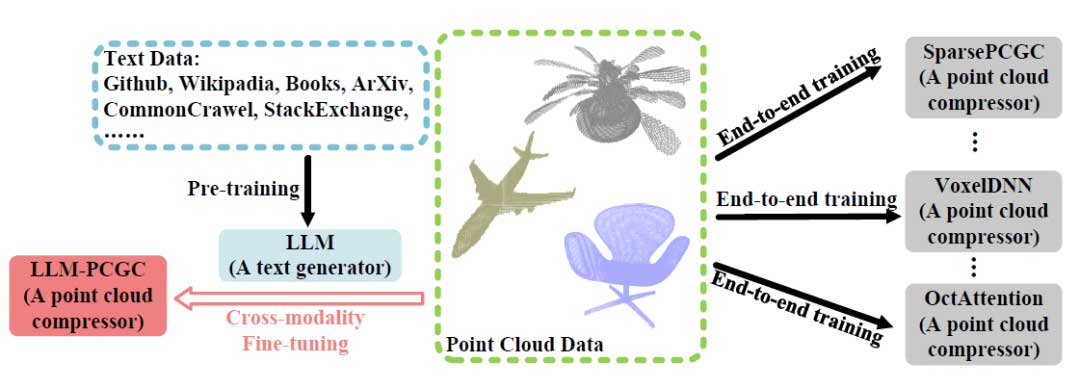

本文提出了一种基于大语言模型(LLM)的点云几何压缩方法(LLM-PCGC),旨在提升无损点云压缩性能。该方法利用聚类和K树结构等技术,直接对点云数据进行压缩,无需文本描述。实验结果表明,LLM-PCGC在比特率上优于现有标准,展示了LLM在数据压缩中的潜力。

🎯

关键要点

- 本文提出了一种基于大语言模型(LLM)的点云几何压缩方法(LLM-PCGC),旨在提升无损点云压缩性能。

- LLM-PCGC利用聚类和K树结构等技术,直接对点云数据进行压缩,无需文本描述。

- 实验结果表明,LLM-PCGC在比特率上优于现有标准,展示了LLM在数据压缩中的潜力。

- LLM的双重属性使其适合满足数据压缩的需求,但直接应用于PCGC任务面临理解不足的挑战。

- 作者提出的LLM-PCGC是首个在无需文本信息辅助的情况下理解点云结构的大模型。

- LLM-PCGC通过微调预训练的LLM实现高效的跨模态表示对齐,构建点云压缩器。

- 实验结果显示,LLM-PCGC实现了40.213%的比特率降低,优于当前最先进的学习型方法。

- 编码阶段包括聚类、归一化、K树结构化和token映射等关键步骤,解码阶段则按逆序操作重建原始点云。

- 本文的贡献在于提出了一种新颖的架构,将LLM转化为点云的压缩器/生成器。

- 未来研究可在优化LLMs的内存消耗和推理时间上继续努力。

➡️