💡

原文英文,约2300词,阅读约需9分钟。

📝

内容提要

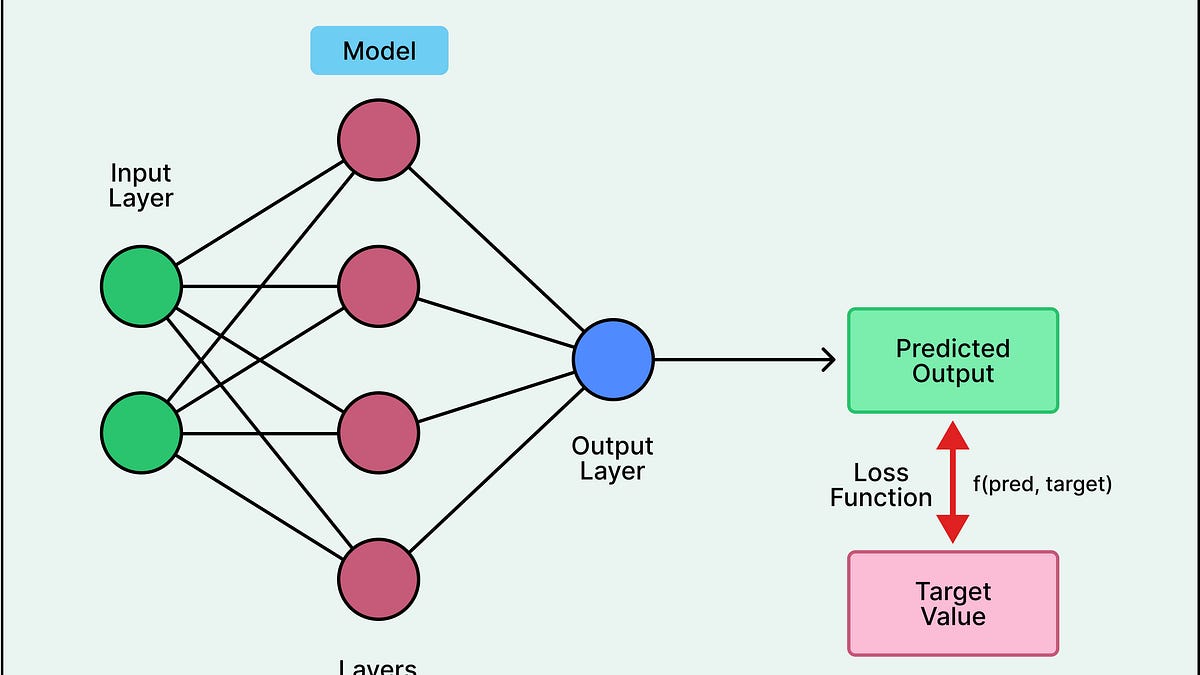

要有效监控大型语言模型(LLMs),需了解其工作原理。LLMs通过调整参数模仿文本模式,而非真正理解。训练中使用损失函数评估性能,梯度下降算法优化模型。尽管LLMs能生成流畅文本,但缺乏推理能力,容易在新问题上出错,因此使用时需谨慎,验证输出的准确性。

🎯

关键要点

-

有效监控大型语言模型(LLMs)需要了解其工作原理。

-

LLMs通过调整参数模仿文本模式,而非真正理解。

-

损失函数用于评估模型性能,目标是将其值尽可能降低。

-

良好的损失函数需具体、可计算且平滑。

-

LLMs的评分基于匹配训练数据中的模式,而非真实或正确性。

-

梯度下降算法用于调整模型参数以减少损失。

-

现代LLMs使用随机梯度下降(SGD)来处理大规模数据集。

-

LLMs的训练任务是预测序列中的下一个单词。

-

上下文信息有助于提高LLMs的预测准确性。

-

LLMs在模式匹配方面表现出色,但缺乏推理能力。

-

当面临新问题或准确性至关重要时,使用LLMs需谨慎。

-

始终验证重要用例的输出,不能仅凭自信的回答判断正确性。

-

LLMs是识别和再现文本模式的工具,理解其局限性有助于更有效地使用它们。

❓

延伸问答

大型语言模型是如何进行学习的?

大型语言模型通过调整内部参数来模仿文本模式,而不是通过理解和推理来学习。

损失函数在大型语言模型训练中有什么作用?

损失函数用于评估模型性能,目标是将其值尽可能降低,以便更好地调整模型参数。

梯度下降算法是如何优化大型语言模型的?

梯度下降算法通过计算损失函数的斜率,逐步调整模型参数,以减少损失并提高性能。

大型语言模型在处理新问题时存在哪些局限性?

大型语言模型缺乏推理能力,容易在新问题上出错,且可能生成不准确的答案。

上下文信息如何影响大型语言模型的预测准确性?

上下文信息可以帮助模型更好地缩小预测范围,从而提高预测的准确性。

使用大型语言模型时需要注意什么?

使用大型语言模型时应谨慎,特别是在处理新问题或准确性至关重要的情况下,始终验证输出的准确性。

➡️