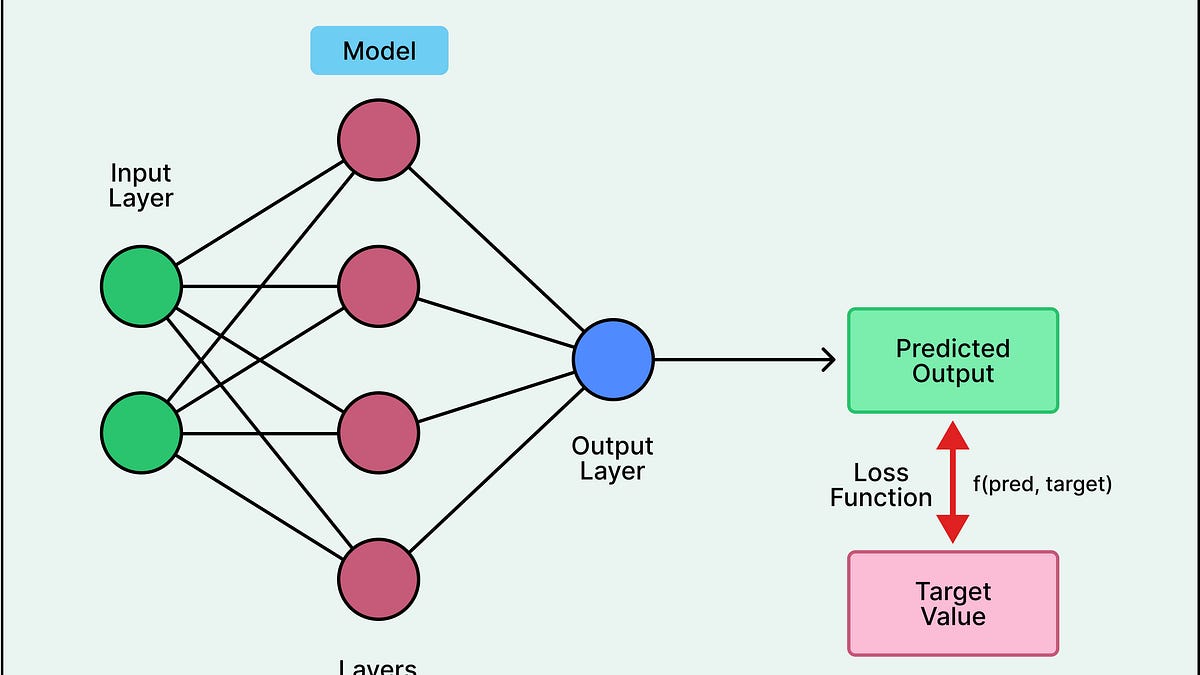

大型语言模型如何学习

ByteByteGo Newsletter

·

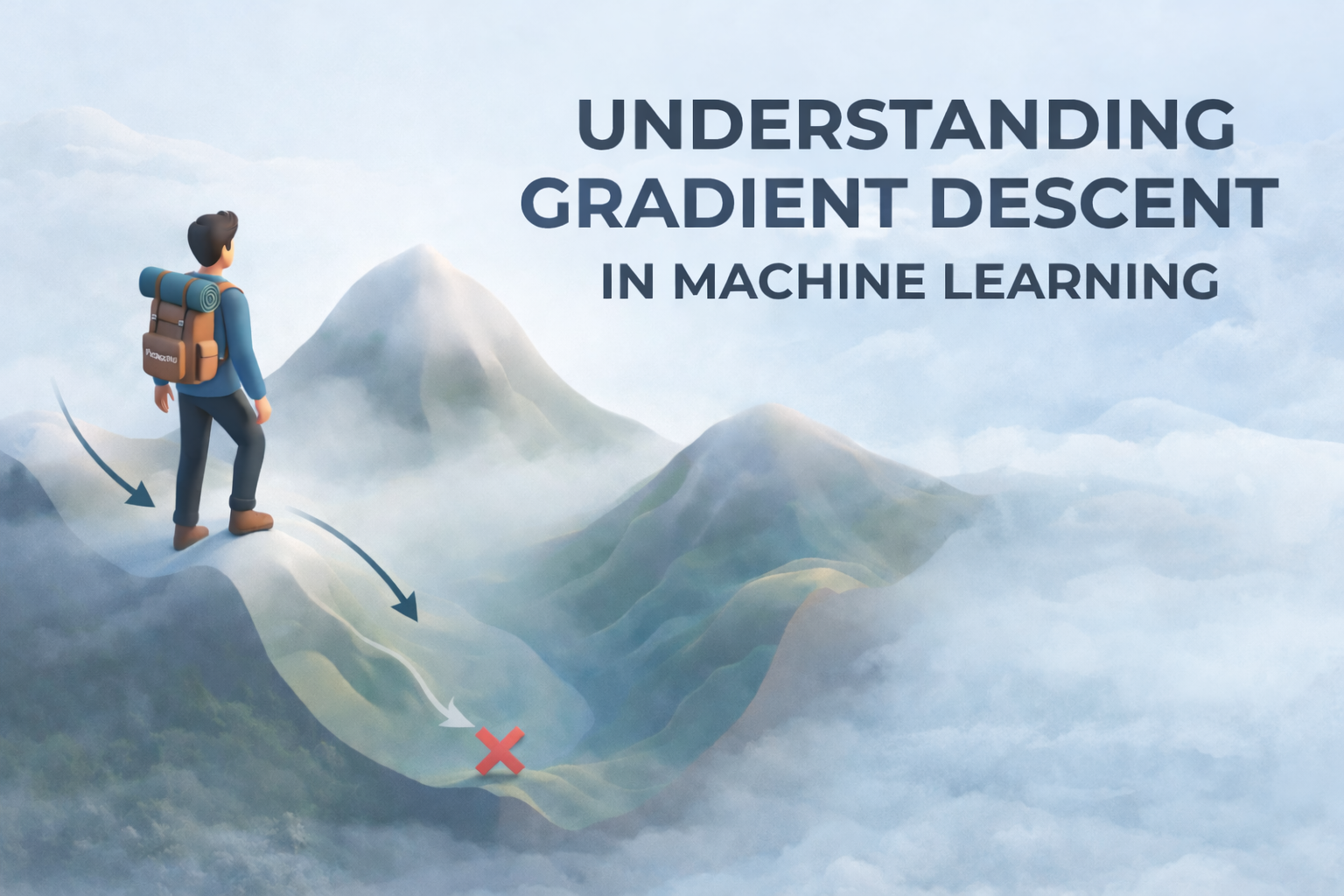

梯度下降:机器学习优化的引擎

MachineLearningMastery.com

·

小猫都能懂的大模型原理 4 - 大语言模型架构

UsubeniFantasy

·

从零开始在Rust中实现MNIST数据集的神经网络

DEV Community

·

让微梯度完美预测样本问题的答案

DEV Community

·

理解机器学习模型的学习过程:从基础到基础模型(2)

DEV Community

·

梯度下降如何推动机器学习模型

DEV Community

·

批量、小批量与随机梯度下降

DEV Community

·

逻辑回归

DEV Community

·

线性回归:从理论到实践

DEV Community

·