💡

原文中文,约7700字,阅读约需19分钟。

📝

内容提要

本文介绍了DeepSeek大模型的部署过程,包括硬件需求、驱动安装、基础环境配置、模型拉取及运行等步骤。强调显存和内存配置对模型性能的重要性,并提供了具体的命令和配置文件示例,同时讨论了可能遇到的性能问题及其解决方案。

🎯

关键要点

- DeepSeek大模型的硬件需求包括:CPU、内存、硬盘、显卡等,显存和内存配置对模型性能至关重要。

- 驱动安装需要从NVIDIA官网下载对应驱动,并检查驱动状态和内核模块。

- 基础环境配置包括安装Python、创建虚拟环境、安装huggingface和docker。

- CUDA的安装需要注意支持的版本,并将其加入环境变量。

- 模型拉取过程耗时较长,建议建立内部模型库以提高效率。

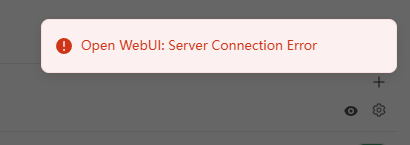

- 需要修改ollama的配置以支持跨网络访问,确保docker能够访问模型。

- 测试过程中发现模型响应速度较慢,可能需要调整上下文token和显存配置。

- 后续计划测试动态Q2.51模型速度,期望能改善使用体验。

❓

延伸问答

DeepSeek大模型的硬件需求是什么?

DeepSeek大模型需要的硬件包括:CPU、内存、硬盘和显卡,显存和内存配置对模型性能至关重要。

如何安装DeepSeek所需的驱动?

需要从NVIDIA官网下载对应驱动,并使用命令检查驱动状态和内核模块。

DeepSeek的基础环境配置包括哪些步骤?

基础环境配置包括安装Python、创建虚拟环境、安装huggingface和docker。

模型拉取过程需要注意什么?

模型拉取过程耗时较长,建议建立内部模型库以提高效率。

如何解决DeepSeek模型响应速度慢的问题?

可以通过调整上下文token和显存配置来改善模型的响应速度。

后续对DeepSeek模型的测试计划是什么?

后续计划测试动态Q2.51模型速度,期望能改善使用体验。

➡️