优化大型语言模型的性能和可扩展性

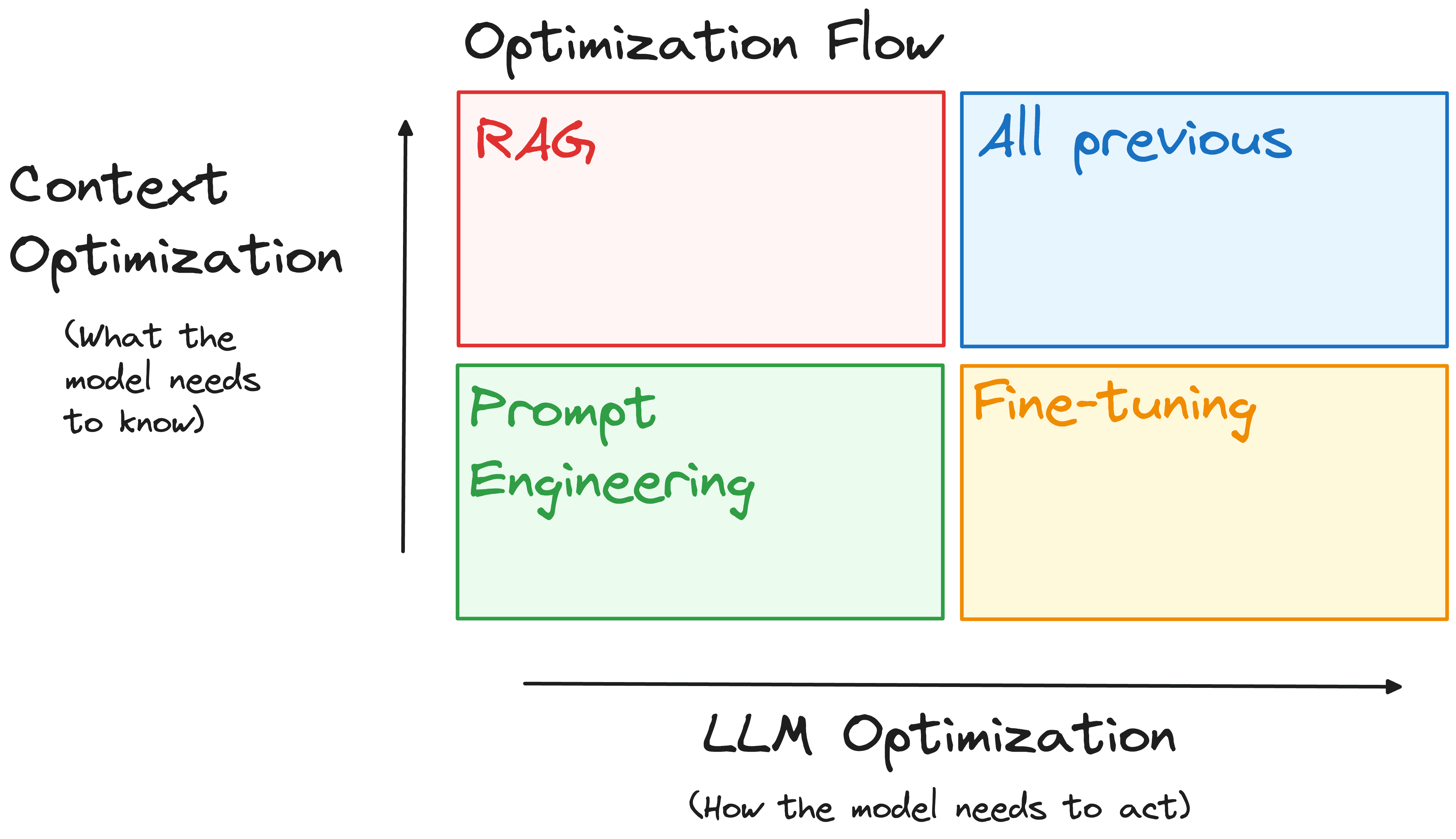

原文英文,约1400词,阅读约需6分钟。发表于:。Optimize LLM performance and scalability using techniques like prompt engineering, retrieval augmentation, fine-tuning, model pruning, quantization, distillation, load balancing, sharding, and caching.

大型语言模型(LLMs)在自然语言处理中扮演重要角色,但性能和可扩展性需要优化。优化性能可采用提示工程、检索增强生成和微调等技术。优化可扩展性可使用模型修剪、量化和蒸馏等技术。负载平衡、模型分片和缓存等技术也有助于提高性能和可扩展性。掌握这些技术可实现更准确、高效和可扩展的LLMs应用。