💡

原文英文,约1100词,阅读约需4分钟。

📝

内容提要

语言模型的“集体意识”现象导致不同模型在开放性问题上给出相似答案。研究表明,模型间输出高度重叠,可能是由于训练数据和奖励模型的重叠。长期使用同质化工具可能限制用户思维多样性,因此在训练阶段需解决多样性问题。

🎯

关键要点

-

不同语言模型在开放性问题上给出相似答案,形成了“集体意识”现象。

-

研究使用Infinity-Chat数据集,包含26000个真实用户查询和31250个人工标注,评估模型输出的多样性。

-

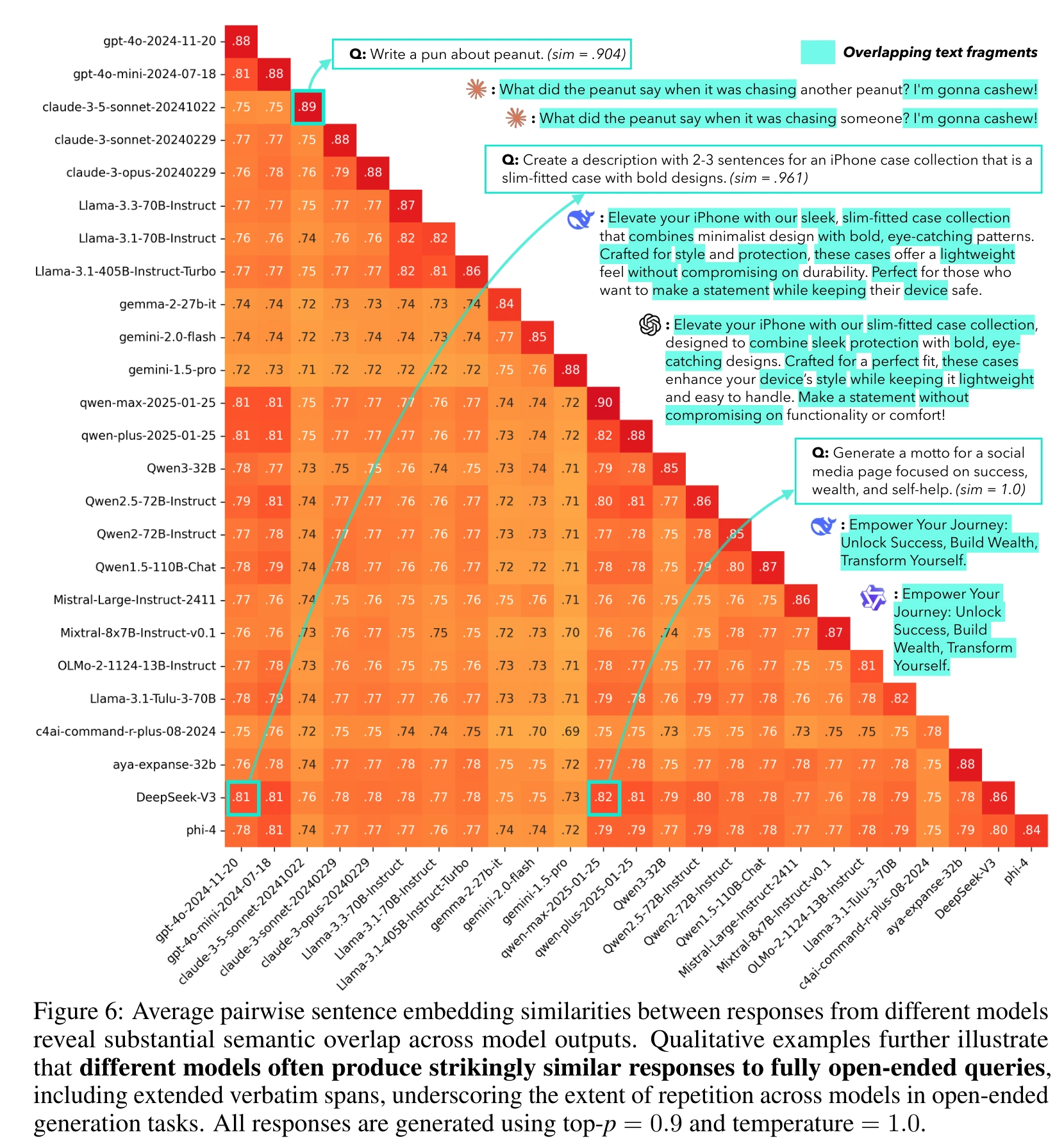

实验结果显示,25个主流模型在相同提示下的回答高度重叠,许多模型的回答集中在少数几种表达上。

-

模型间的输出相似性高,部分模型之间的相似度达到0.82,表明不同架构的模型也会产生高度重叠的结果。

-

训练数据的重叠、奖励模型的校准问题以及合成数据的积累可能是导致同质化的原因。

-

长期使用同质化工具可能限制用户的思维多样性,尤其在需要创造性思维的领域。

-

建议在训练阶段解决多样性问题,而不是仅在解码阶段进行调整。

❓

延伸问答

什么是语言模型的“集体意识”现象?

语言模型的“集体意识”现象指的是不同模型在开放性问题上给出相似答案的情况,显示出高度的输出重叠。

研究如何评估语言模型输出的多样性?

研究使用Infinity-Chat数据集,包含26000个真实用户查询和31250个人工标注,评估模型输出的多样性。

导致语言模型输出同质化的原因有哪些?

导致同质化的原因包括训练数据的重叠、奖励模型的校准问题以及合成数据的积累。

长期使用同质化工具对用户思维有什么影响?

长期使用同质化工具可能限制用户的思维多样性,尤其在需要创造性思维的领域。

如何解决语言模型输出的多样性问题?

建议在训练阶段解决多样性问题,而不是仅在解码阶段进行调整。

不同架构的语言模型之间的输出相似度如何?

不同架构的模型之间的相似度高,部分模型之间的相似度达到0.82,显示出高度重叠的结果。

➡️