💡

原文英文,约2100词,阅读约需8分钟。

📝

内容提要

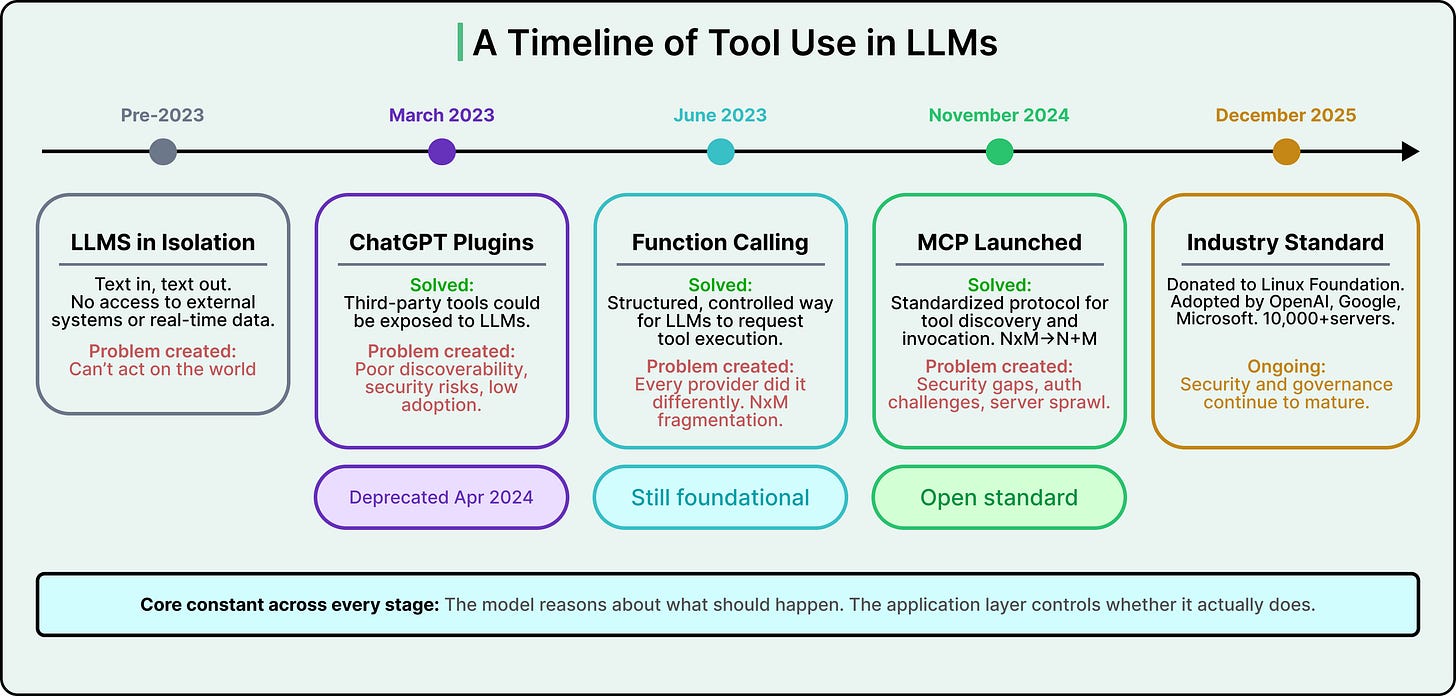

大型语言模型(LLM)最初只能生成文本,无法与外部系统直接交互。通过功能调用,LLM可以请求特定操作,执行由应用层完成。模型上下文协议(MCP)标准化了工具的描述和发现,简化了不同提供商之间的集成。尽管快速发展带来了便利,但安全性和模型的上下文限制仍需关注。

🎯

关键要点

- 大型语言模型(LLM)最初只能生成文本,无法直接与外部系统交互。

- 通过功能调用,LLM可以请求特定操作,执行由应用层完成。

- 模型上下文协议(MCP)标准化了工具的描述和发现,简化了不同提供商之间的集成。

- LLM本质上是文本预测引擎,无法直接调用API或执行现实世界的操作。

- 功能调用机制允许模型生成结构化请求,由应用层执行实际操作并返回结果。

- MCP通过客户端-服务器架构减少了集成的复杂性,促进了工具的标准化。

- 尽管快速发展带来了便利,但安全性和模型的上下文限制仍需关注。

❓

延伸问答

大型语言模型如何与外部系统交互?

大型语言模型通过功能调用请求特定操作,由应用层执行并返回结果。

什么是模型上下文协议(MCP)?

模型上下文协议(MCP)是一种标准化工具描述和发现的协议,简化了不同提供商之间的集成。

功能调用机制是如何工作的?

功能调用机制允许模型生成结构化请求,由应用层执行实际操作并返回结果。

使用大型语言模型的工具有哪些潜在风险?

潜在风险包括安全性问题和模型上下文限制,可能导致攻击面扩大和模型性能下降。

大型语言模型的上下文限制是什么?

上下文限制指的是模型只能处理有限的文本量,这会影响其对工具的使用和任务的理解。

MCP如何解决工具集成的碎片化问题?

MCP通过定义统一的协议,减少了不同提供商和工具之间的集成复杂性,从N×M降至N+M。

➡️