💡

原文中文,约4500字,阅读约需11分钟。

📝

内容提要

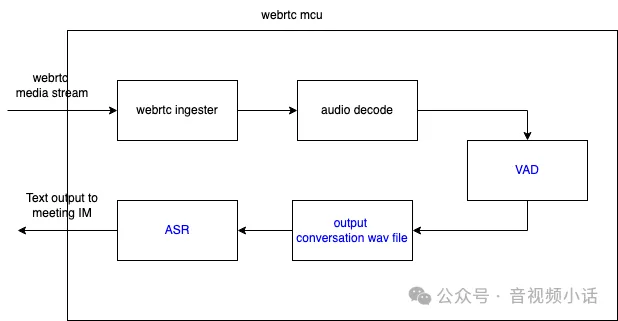

本文介绍了构建WebRTC视频会议实时语音转字幕的架构,重点在语音断句的VAD方法。推荐使用libwebrtc和fftw3两种开源VAD实现,并提供相关代码示例。

🎯

关键要点

- 本文介绍了WebRTC视频会议实时语音转字幕的架构,重点在语音断句的VAD方法。

- 推荐使用libwebrtc和fftw3两种开源VAD实现,并提供相关代码示例。

- VAD方法用于检测语音会话的开始和结束,确保语音转文字的准确性。

- OpenAI的WebRTC语音接入也使用了VAD和ASR的过程,当前ASR服务使用whisper-1模型。

- libwebrtc中的VAD模块可以独立使用,提供了简单的接口和代码示例。

- FFTW3是一个高性能的C库,用于计算快速傅里叶变换(FFT),也可用于VAD检测。

- 本文提供了使用libwebrtc和FFTW3进行VAD检测的代码示例。

- 总结部分提到后续将介绍ASR的开源实现,继续探讨语音转文字的技术。

❓

延伸问答

什么是VAD方法,它的作用是什么?

VAD方法(语音活动检测)用于检测语音会话的开始和结束,确保语音转文字的准确性。

推荐使用哪些开源VAD实现?

推荐使用libwebrtc和fftw3两种开源VAD实现。

libwebrtc中的VAD模块有什么特点?

libwebrtc中的VAD模块可以独立使用,提供了简单的接口和代码示例。

FFTW3库在VAD检测中有什么应用?

FFTW3是一个高性能的C库,用于计算快速傅里叶变换(FFT),也可用于VAD检测。

如何使用libwebrtc进行VAD检测?

可以通过创建VAD实例,设置敏感度,然后处理音频帧来进行VAD检测。

文章中提到的ASR服务使用了什么模型?

当前ASR服务使用的是whisper-1模型。

➡️