💡

原文中文,约1000字,阅读约需3分钟。

📝

内容提要

清华、剑桥与字节跳动的研究团队提出了一种新方法,使大语言模型(LLM)能够理解空间音频,具备声音源定位、远场语音识别和基于定位的语音提取能力。实验结果表明,该模型在空间音频任务中的表现显著提升,展示了LLM在复杂三维场景感知方面的潜力,为未来AI应用奠定了基础。

🎯

关键要点

- 清华、剑桥与字节跳动的研究团队提出了一种新方法,使大语言模型(LLM)理解空间音频。

- 该方法使LLM具备声音源定位、远场语音识别和基于定位的语音提取能力。

- 研究围绕三个核心任务展开:声音源定位(SSL)、远场语音识别(FSR)和基于定位的语音提取(LSE)。

- 在声音源定位方面,模型的平均角度误差从6.6度降至2.7度,显示出显著提升。

- 结合空间特征后,远场语音识别的词错误率进一步降低,证明了LLM的理解能力提升。

- 在基于定位的语音提取任务中,模型能够有效区分和提取指定方向的声音。

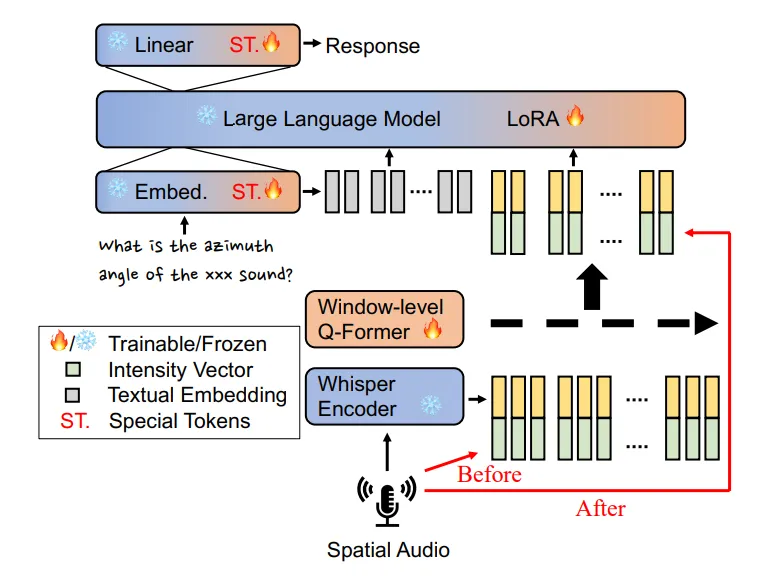

- 研究团队选择冻结主流Whisper语音编码器和LLM,仅微调对齐模块和特定层。

- 空间信息的注入点选择在模型的中间层,效果优于末端融合。

- 研究合成了大量复杂空间音频数据,支持LLM学习空间感知和多声源分离。

- 整体实验展示了LLM在空间听觉理解和复杂三维场景感知上的潜力,为AI未来的应用奠定基础。

❓

延伸问答

大语言模型如何理解空间音频?

研究团队提出了一种新方法,使大语言模型具备声音源定位、远场语音识别和基于定位的语音提取能力。

声音源定位的实验结果如何?

模型在声音源定位任务中的平均角度误差从6.6度降至2.7度,显示出显著提升。

远场语音识别的表现如何?

结合空间特征后,远场语音识别的词错误率进一步降低,证明了LLM的理解能力提升。

基于定位的语音提取任务的能力是什么?

模型能够根据指令有效区分和提取指定方向的声音,即使在多个说话者同时存在的情况下。

研究团队在模型训练中采取了什么方法?

团队选择冻结主流Whisper语音编码器和LLM,仅微调对齐模块和特定层。

这项研究对未来AI应用有什么意义?

研究展示了LLM在空间听觉理解和复杂三维场景感知上的潜力,为AI未来的应用奠定基础。

➡️