💡

原文英文,约5600词,阅读约需21分钟。

📝

内容提要

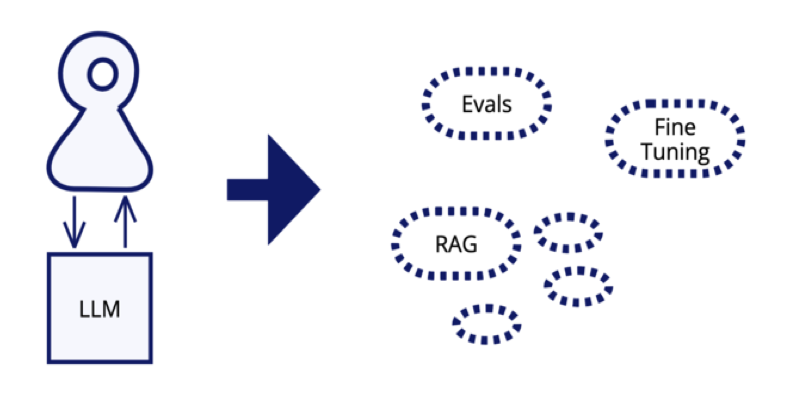

本文探讨了生成式人工智能在软件开发中的应用,强调评估和嵌入技术的重要性。作者分享了在实际项目中遇到的挑战,如模型非确定性和数据访问问题,并提出了解决方案,包括直接提示、评估和检索增强生成(RAG),以帮助开发者更有效地利用大型语言模型,提升系统性能和准确性。

🎯

关键要点

- 生成式人工智能在软件开发中的应用正在从概念验证转向生产系统。

- 评估(Evals)在确保非确定性系统的合理运行中起着核心作用。

- 大型语言模型(LLM)需要增强以提供超出静态训练集的信息。

- 检索增强生成(RAG)是提高系统性能的有效方法。

- 软件工程师在将生成式AI产品投入生产时面临重大挑战。

- 生成式AI引入了新的问题,如幻觉、无限制的数据访问和非确定性。

- 本文总结了在实际项目中观察到的模式和解决方案。

- 直接提示是使用LLM的基本方法,但存在数据限制和安全隐患。

- 评估模型响应的有效性是确保系统符合预期的重要步骤。

- 自我评估和人类评估是评估LLM输出的有效方法。

- 嵌入(Embeddings)将大数据块转换为数值向量,以便进行语义相似性比较。

- RAG通过检索相关文档片段来增强LLM的回答能力。

- 混合检索器结合了嵌入搜索和其他搜索技术,以提高检索效率。

- 查询重写利用LLM生成多个查询变体,以改善检索结果。

- 评估和基准测试是确保LLM性能的重要工具。

- 在使用生成式AI时,建立系统的评估机制至关重要。

❓

延伸问答

生成式人工智能在软件开发中有哪些应用?

生成式人工智能在软件开发中的应用包括从概念验证转向生产系统,提升系统性能和准确性,特别是在处理非确定性系统时。

什么是检索增强生成(RAG),它如何提高系统性能?

检索增强生成(RAG)是一种通过检索相关文档片段并将其包含在提示中来增强大型语言模型回答能力的方法,从而提高系统性能。

在使用生成式人工智能时,软件工程师面临哪些挑战?

软件工程师面临的挑战包括模型的非确定性、数据访问问题、幻觉现象以及如何有效评估模型的输出。

如何评估大型语言模型(LLM)的输出有效性?

评估LLM输出有效性的方法包括自我评估、使用其他模型进行评估以及人类评估,以确保输出符合预期标准。

什么是查询重写,它在检索中有什么作用?

查询重写是利用LLM生成多个查询变体,以改善检索结果,特别是在复杂搜索中能提高找到相关文档的机会。

生成式人工智能的评估机制为何重要?

评估机制对于生成式人工智能至关重要,因为它确保系统的输出符合预期,帮助开发者识别和解决潜在问题。

➡️