💡

原文中文,约3900字,阅读约需10分钟。

📝

内容提要

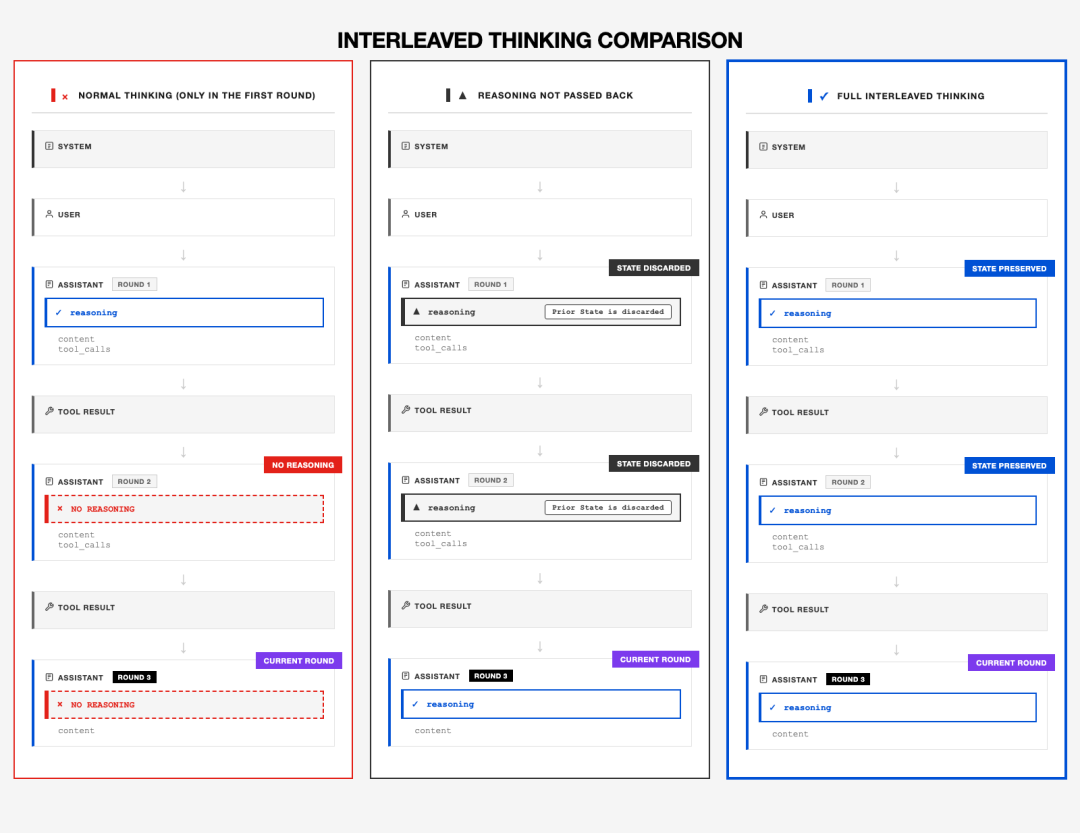

大模型开发者面临“交错思考”挑战,需要回传思维链以防止模型“失忆”。各厂商API协议分散,Anthropic设计优雅,DeepSeek V3.2兼容性强。开发者需统一接入多模型,以提升用户体验。

🎯

关键要点

-

大模型开发者面临“交错思考”挑战,需要回传思维链以防止模型“失忆”。

-

各厂商API协议分散,Anthropic设计优雅,率先支持交错思考。

-

DeepSeek V3.2兼容性强,允许输入端包含reasoning_content字段。

-

开发者需统一接入多模型,以提升用户体验,避免协议复杂性。

-

Prompt Cache机制可以降低成本,回传思维链反而提高推理速度。

-

OpenAI和Google在协议响应上显得迟缓,面临竞争压力。

-

Sdcb Chats项目旨在统一接入不同模型,提供一致的交错思考体验。

❓

延伸问答

什么是大模型的交错思考挑战?

交错思考挑战是指在多轮对话中,如何有效回传模型的思维链,以防止模型“失忆”,确保其能够记住决策路径。

Anthropic的Messages API有什么特点?

Anthropic的Messages API率先支持交错思考,强制要求回传思维链,并引入防篡改签名,设计优雅且易于兼容。

DeepSeek V3.2如何改善API兼容性?

DeepSeek V3.2允许在输入端直接包含reasoning_content字段,增强了与现有Chat Completions API的兼容性,降低了集成复杂性。

Prompt Cache机制如何影响推理速度和成本?

Prompt Cache机制可以提高缓存命中率,虽然回传思维链增加了Token数量,但实际推理速度更快,综合成本更低。

OpenAI和Google在API协议上面临什么挑战?

OpenAI和Google在协议响应上显得迟缓,面临来自Anthropic的竞争压力,导致开发者需要为不同模型编写适配逻辑。

Sdcb Chats项目的目标是什么?

Sdcb Chats项目旨在统一接入不同模型,提供一致的交错思考体验,简化开发者的集成过程。

➡️