原文中文,约4800字,阅读约需12分钟。

📝

内容提要

本文介绍了数据处理的不同系统和方法,包括Unix管道、GFS和MapReduce、Spark和关系型数据库。这些系统都遵循了统一的数据集和可组合的算子的抽象。

🎯

关键要点

-

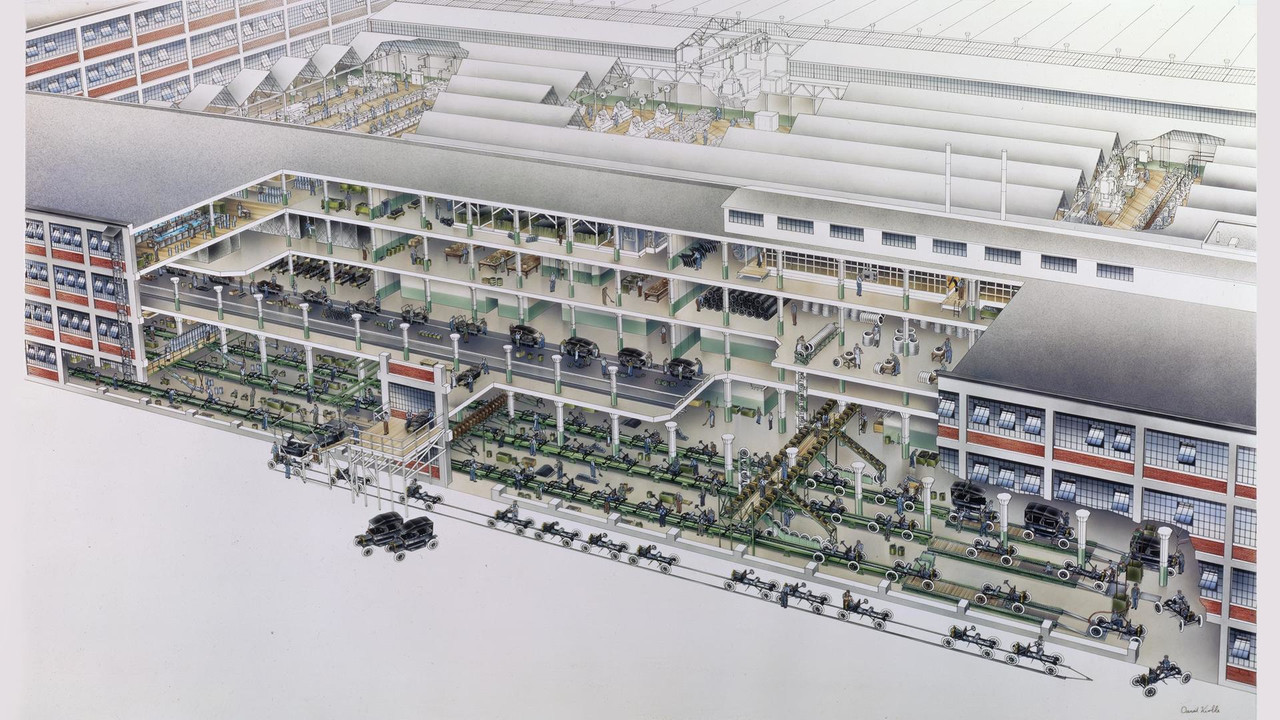

福特T型汽车的电机装配通过流水线思想提升了效率。

-

数据处理的核心概念是标准化的数据集合和可组合的数据变换。

-

Unix管道允许程序通过标准输入输出进行协同工作,体现了高内聚和低耦合的特点。

-

Unix管道的流式处理使得多个程序可以并行执行,但限制了表达能力。

-

MapReduce是谷歌提出的用于大规模集群并行数据处理的算法,GFS是其配套的分布式文件系统。

-

MapReduce的三个阶段是Map、Shuffle和Reduce,支持复杂的数据处理需求。

-

Spark通过引入RDD(弹性分布式数据集)解决了MapReduce中每次数据集都要落盘的问题。

-

关系型数据库提供强大的SQL查询语言,支持高效的数据查询和灵活的数据处理。

-

关系型数据库的基本单位是关系(表),用户可以施加各种关系代数算子。

-

数据处理系统的统一性体现在标准化的数据集和可组合的算子上。

🏷️