💡

原文中文,约2000字,阅读约需5分钟。

📝

内容提要

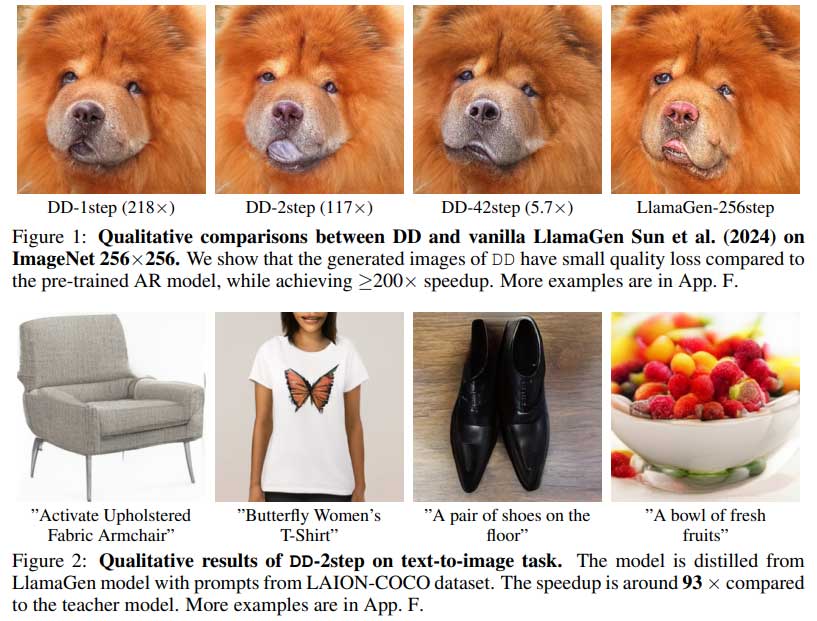

自回归(AR)模型在图像生成中取得了显著进展,但生成速度慢限制了应用。清华大学和微软研究院提出的Distilled Decoding(DD)方法,通过流匹配技术,将生成步骤从数百步减少到一两步,显著提升了速度,同时保持图像质量。这一创新为AR模型的实时应用开辟了新领域。

🎯

关键要点

- 自回归(AR)模型在图像生成领域取得显著进展,但生成速度慢限制了应用。

- 清华大学和微软研究院提出的Distilled Decoding(DD)方法,通过流匹配技术,将生成步骤从数百步减少到一两步。

- DD方法显著提升了生成速度,同时保持图像质量,为AR模型的实时应用开辟了新领域。

- AR模型的生成过程是逐个标记生成,导致高延迟,限制了可扩展性。

- 传统方法如多token生成和掩码策略虽然尝试加速,但通常会损害生成图像的质量。

- DD方法不需要访问AR模型的原始训练数据,更适合部署。

- 实验表明,DD可以将生成速度提高至217.8倍,同时保持可接受的图像质量。

- DD在不同的AR模型中表现出一致的性能,允许用户根据需求选择生成路径。

- DD的高效提炼方法可能影响其他领域,如文本到图像合成和语言建模。

- Distilled Decoding成功解决了AR生成过程中的速度与质量之间的权衡问题。

❓

延伸问答

Distilled Decoding(DD)方法的主要优势是什么?

DD方法通过流匹配技术将生成步骤从数百步减少到一两步,显著提升了生成速度,同时保持图像质量。

自回归(AR)模型在图像生成中面临哪些主要问题?

AR模型的主要问题是生成速度慢,逐个标记生成导致高延迟,限制了实时应用的可扩展性。

Distilled Decoding如何解决速度与质量之间的权衡?

DD通过确定性映射和流匹配技术,消除了速度和保真度之间的权衡,实现了快速生成而不显著降低质量。

DD方法在不同AR模型中的表现如何?

DD在不同AR模型中表现出一致的性能,允许用户根据需求选择生成路径,平衡质量和速度。

使用DD方法生成图像的速度提升有多大?

实验表明,DD可以将生成速度提高至217.8倍,同时保持可接受的图像质量。

Distilled Decoding的应用前景如何?

DD的高效提炼方法可能影响其他领域,如文本到图像合成和语言建模,开辟了新应用领域。

➡️