💡

原文英文,约1200词,阅读约需5分钟。

📝

内容提要

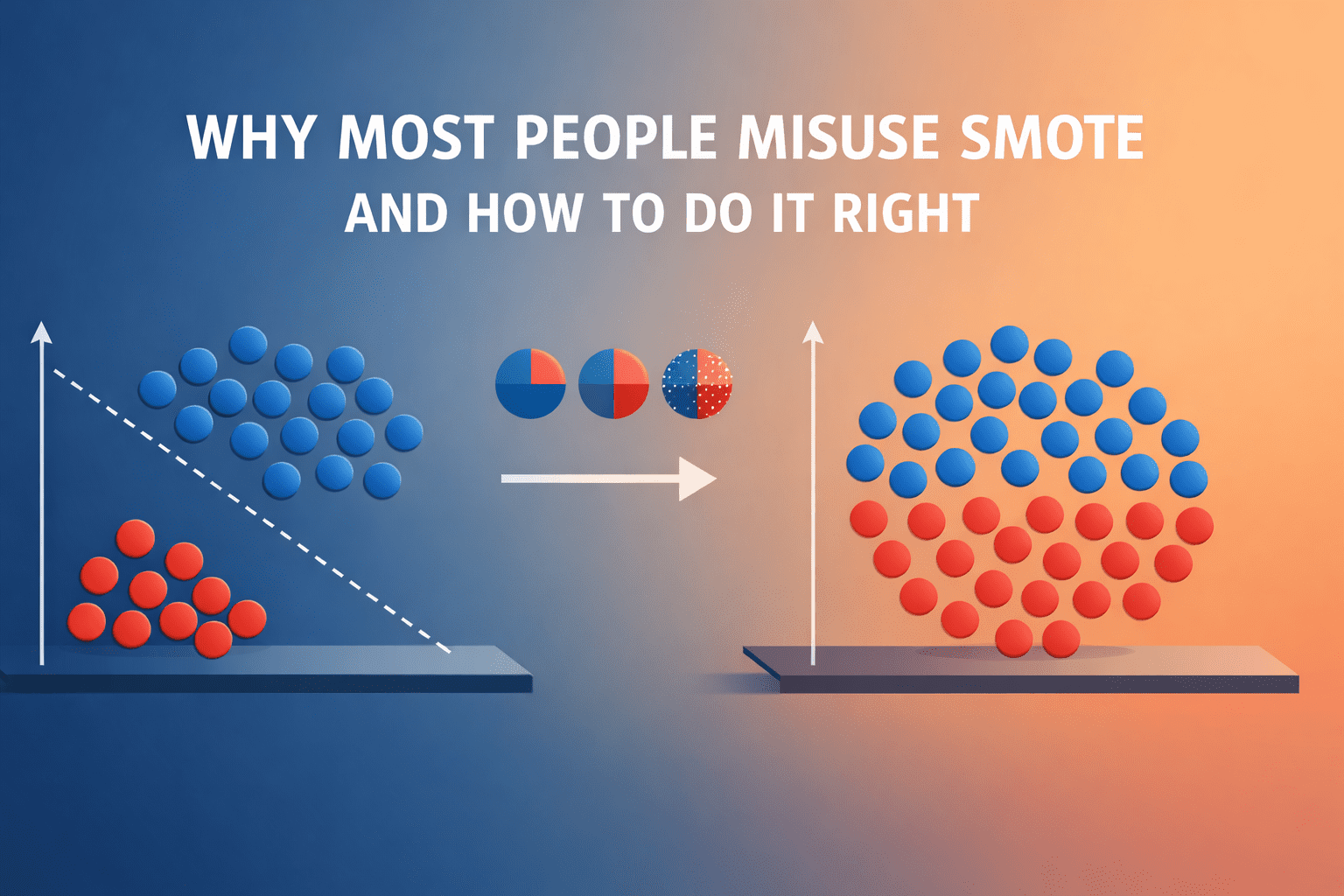

SMOTE是一种解决机器学习类别不平衡问题的数据增强技术,通过在少数类样本间插值生成合成样本,帮助平衡数据集。使用时需先划分训练和测试集,以防数据泄漏。常见误用包括过度平衡和忽视评估指标的上下文。

🎯

关键要点

- SMOTE是一种解决机器学习类别不平衡问题的数据增强技术。

- 类别不平衡是指标记数据集中某些类别的样本数量差异很大,导致模型偏向于多数类。

- SMOTE通过在少数类样本之间插值生成合成样本,帮助平衡数据集。

- 使用SMOTE时,需先划分训练集和测试集,以防数据泄漏。

- 常见的SMOTE误用包括:在划分数据集前应用SMOTE、过度平衡样本、忽视评估指标的上下文。

- 评估模型时应关注召回率、F1分数等指标,而不仅仅是整体准确率。

- 在实现SMOTE时,使用管道可以确保只对训练数据应用SMOTE,避免合成信息泄漏到测试集中。

❓

延伸问答

SMOTE是什么,它是如何解决类别不平衡问题的?

SMOTE是一种数据增强技术,通过在少数类样本之间插值生成合成样本,帮助平衡机器学习中的类别不平衡问题。

使用SMOTE时需要注意哪些常见误用?

常见误用包括在划分数据集前应用SMOTE、过度平衡样本和忽视评估指标的上下文。

如何正确实施SMOTE以避免数据泄漏?

应先划分训练集和测试集,然后在训练集上应用SMOTE,使用管道可以确保只对训练数据应用SMOTE。

评估模型时应该关注哪些指标?

应关注召回率、F1分数等指标,而不仅仅是整体准确率,以更全面地评估模型性能。

SMOTE如何影响模型的性能?

SMOTE可以提高模型对少数类的召回率,但可能会降低精确率,因为合成样本可能引入噪声。

在什么情况下使用SMOTE可能会导致过度平衡?

在试图达到完美的类别比例时,特别是在多类数据集中,SMOTE可能会创建不必要的合成样本,导致模型过拟合。

➡️